Technologia

informacyjna

Informatyka

Komunikacja

Technologia informacyjna

IT ang. Information Technology

Dziedzina wiedzy, która stanowi połączenie

zastosowań informatyki z technikami komunikacji.

Dostarcza narzędzi, za pomocą których moŜna

pozyskiwać informacje, selekcjonować je,

analizować, przetwarzać, zarządzać i przekazywać.

Obszary zastosowań:

Posługiwanie się środkami i metodami informatyki w celu rozwiązywania problemów z Ŝycia codziennego

UmoŜliwienie człowiekowi aktywnego funkcjonowania w

społeczeństwie informacyjnym

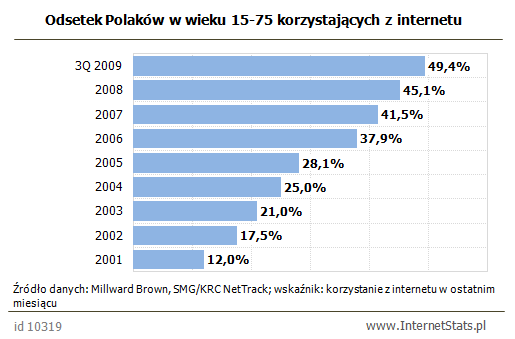

Wzrost liczby internautów

Rosnąca rola informacji

Informacja i wiedza są obecnie uwaŜane za

nowy "towar" na rynku, podobny do dóbr

materialnych czy energii. Ze względu na ten

fakt, Internet i inne zalewające ludzi potoki

informacji, obecne społeczeństwo globalne

nazywane jest społeczeństwem

informacyjnym (Information Society).

Społeczeństwo informacyjne

Ogół ludzi mających powszechne i łatwe moŜliwości

komunikowania się oraz dostęp do potrzebnych im

informacji, poprawiających warunki Ŝycia,

wykonywanie pracy, wypełnianie obowiązków

obywatelskich

Społeczeństwo, w którym towarem staje się informacja traktowana jako szczególne dobro niematerialne,

równowaŜne lub cenniejsze nawet od dóbr

materialnych.

W społeczeństwie informacyjnym zarządzanie

informacją oraz jej jakość i szybkość przepływu są

zasadniczymi czynnikami decydującymi o

konkurencyjności przedsiębiorstw.

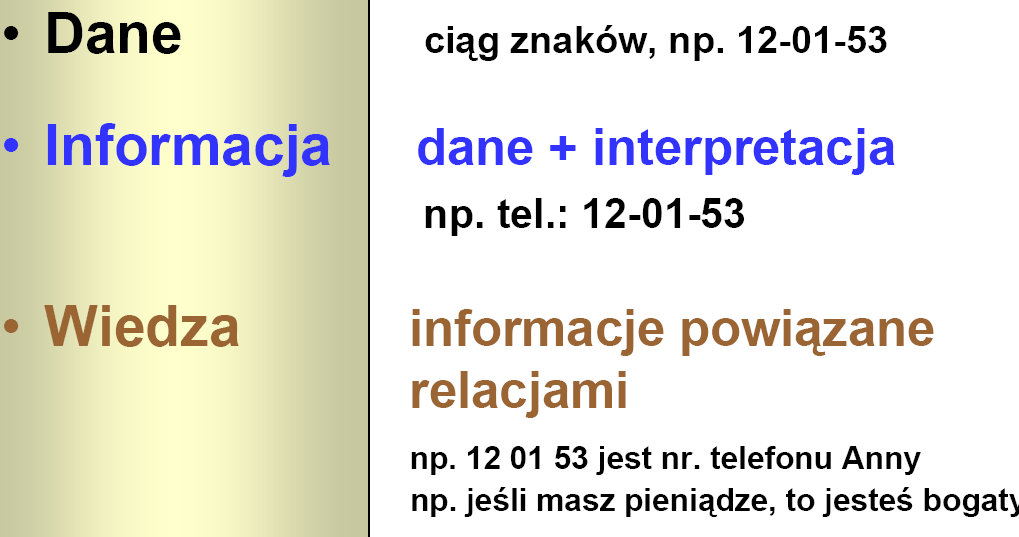

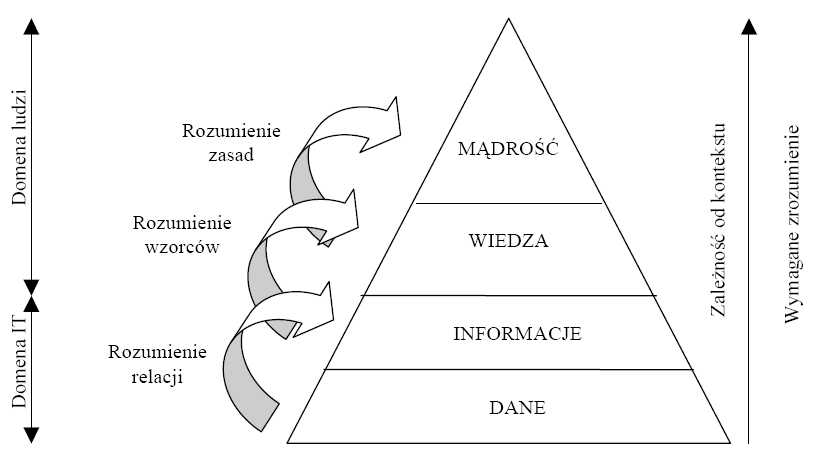

Dane, informacja, wiedza

Piramida wiedzy

Jednostka informacji

Bit (z ang. binary digit)

najmniejsza ilość informacji potrzebna do określenia, który z dwóch równie prawdopodobnych stanów

przyjął układ.

oznaczana jest za pomocą „b”

Bit odpowiada ilości informacji zawartej w odpowiedzi na pytanie, na które moŜna odpowiedzieć tak lub nie.

Bit przyjmuje jedną z dwóch wartości, które zwykle

określa się jako 0 (zero) i 1 (jeden), choć moŜna

przyjąć dowolną inną parę wartości, np. prawda i fałsz, tak lub nie czy -1 i +1. W pierwszym przypadku bit jest toŜsamy z cyfrą w systemie dwójkowym

Ilość informacji

W teorii informacji Shannona informacja jest mierzona jako prawdopodobieństwo zajścia zdarzenia.

I - liczba bitów informacji (ilość informacji),

p - prawdopodobieństwo zajścia zdarzenia.

Zdarzenia mniej prawdopodobne dają więcej informacji.

Mogą istnieć ułamkowe ilości informacji - np. w informacji o zajściu zdarzenia, którego szansa wynosiła 90% zawiera się 0.152 bitów.