Badanie zależności statystycznych z wykorzystaniem opcji Statystyki|Regresja|Liniowa

Interesuje nas identyfikacja zależności o postaci

![]()

lub, ogólnie, o postaci

![]()

gdzie Y jest zmienną zależną (objaśnianą), zmienne x1,..,xk są zmiennymi niezależnymi (objaśniającymi), zaś jest zmienną losową zakłócającą o rozkładzie normalnym.

Na podstawie analizy danych należy oszacować parametry tego modelu.

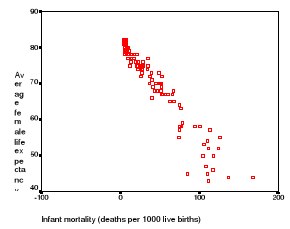

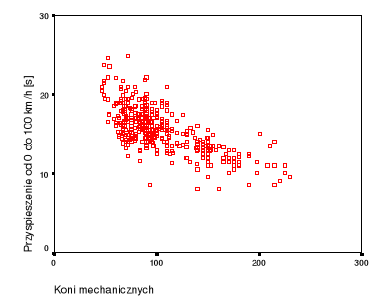

Wstępna analiza: pole rozrzutu (Wykresy|Rozrzutu..)

Punkty na polu rozrzutu powinny układać się na linii prostej.

Jest to warunek wystarczający, by wyznaczyć parametry prostej regresji.

Warunki poprawności wnioskowania statystycznego:

składnik błędu ma rozkład normalny o wartości oczekiwanej równej 0;

błędy mają stałą wariancję (niezależną od wartości zmiennych objaśniających);

błędy są wzajemnie niezależne.

Istotne przypadki zakłóceń:

wartość odstająca (punkty układają się wzdłuż linii prostej za wyjątkiem np. jednego, który jest „z boku”);

punkt „dźwigniowy” ( punkty tworzą symetryczną „chmurę” za wyjątkiem jednego, który jest od niej oddalony);

zmienna wariancja błędu (pionowe „przekroje” mają różną długość - patrz rysunek powyżej);

występuje zależność nieliniowa.

Uwaga: Ta sama funkcja regresji może być wyznaczona dla różnych układów punktów (przykład: tzw. „kwartet Anscombe'a”).

Wykresy: Wykresy|Interaktywne|Rozrzutu...

W powyższych przypadkach równanie regresji wynosi:

![]()

,

zaś współczynnik korelacji wynosi 0,816.

Analiza funkcji regresji

2.1 Ustalanie zmiennych

Ustala się zmienną zależną

Ustala się zmienne niezależne (blokami)

Można (opcja) ustalić sposób wprowadzania zmiennych do modelu

Można (opcja) ustalić zmienną filtrującą pozwalającą ograniczyć analizę do przypadków spełniających pewien warunek

Można (opcja) ustalić zmienną do opisu przypadków

Obliczane statystyki: współczynniki regresji (oszacowania, przedziały ufności, macierz kowariancji), statystyki dopasowania modelu, statystyki opisowe, statystyki do analizy reszt

Wykresy: histogram zmiennej zależnej, wykresy rozrzutu

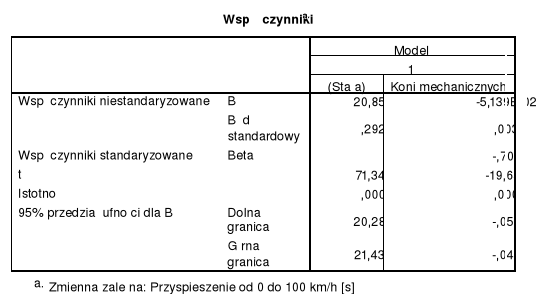

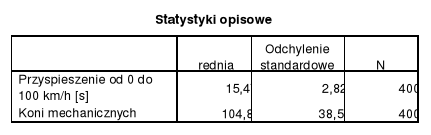

Estymacja parametrów równania regresji

Parametry równania regresji

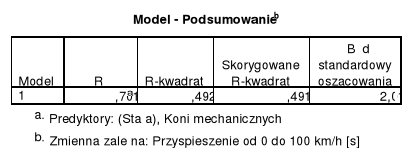

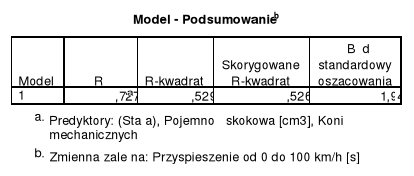

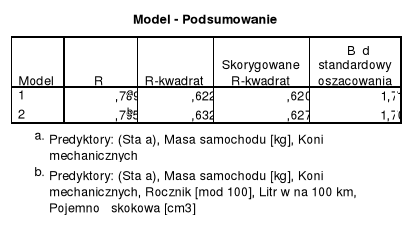

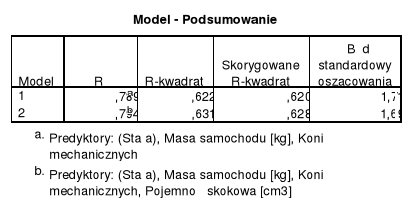

Analiza dopasowania modelu

R - współczynnik korelacji (wielokrotnej).

R-kwadrat (R2) - proporcja zmienności zmiennej zależnej „wyjaśniana” przez zmienność zmiennych niezależnych (współczynnik determinacji).

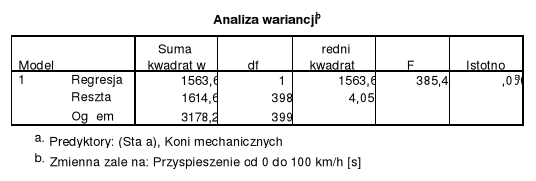

Analiza wariancji: weryfikacja hipotezy o istotności regresji

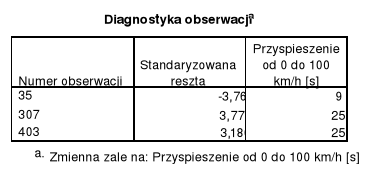

Diagnostyka: wskazanie obserwacji, które w znacznym stopniu odbiegają od swoich „przewidywanych” wartości.

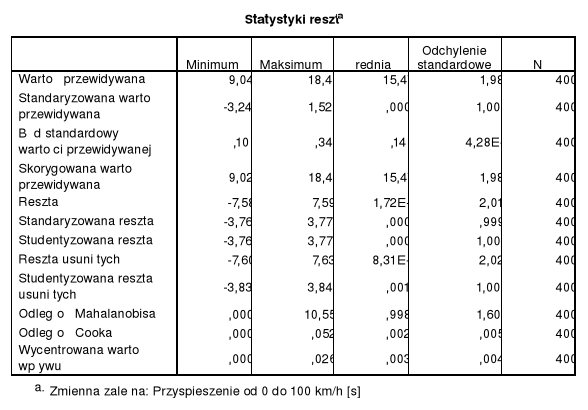

Statystyki reszt: do analizy zgodności obserwacji z założeniami modelu regresji liniowej

Przypadek wielu zmiennych niezależnych

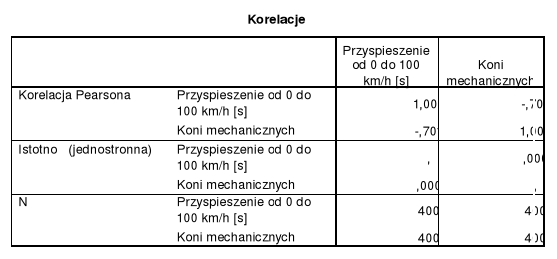

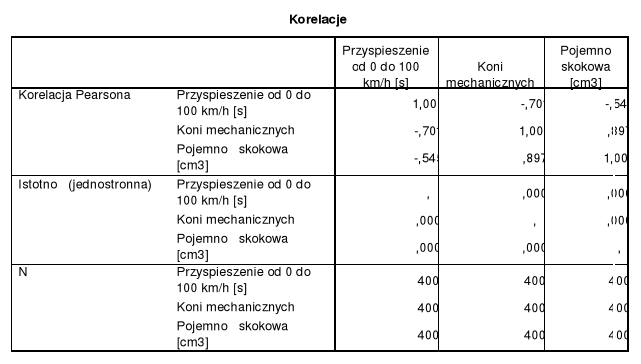

Badanie korelacji:

Uwaga: Zmienne niezależne są skorelowane - występuje efekt współliniowości. Model może być niestabilny! Powoduje to wzrost wariancji oszacowań parametrów.

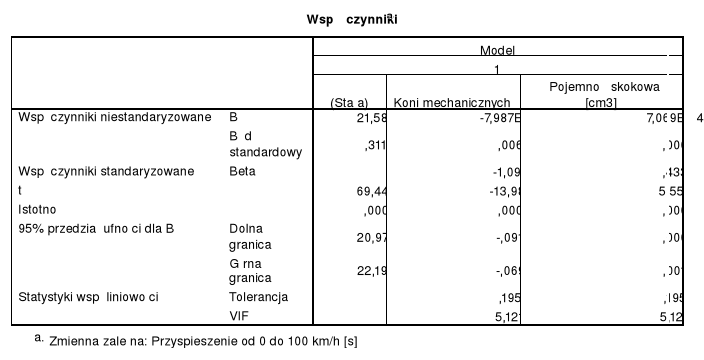

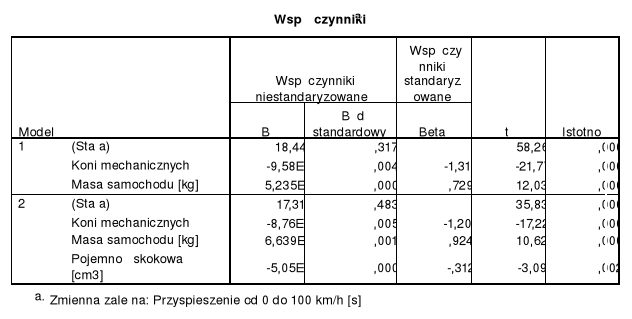

Estymacja parametrów:

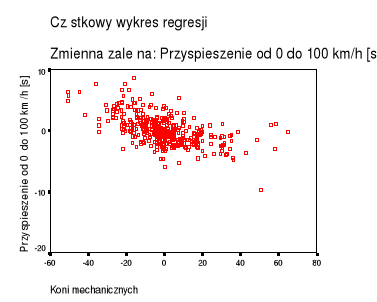

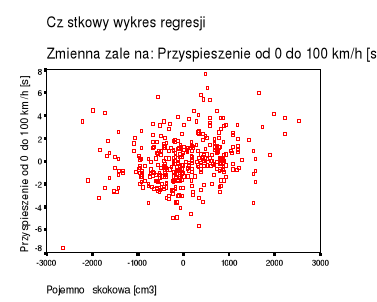

Cząstkowe wykresy regresji (zmienne są standaryzowane).

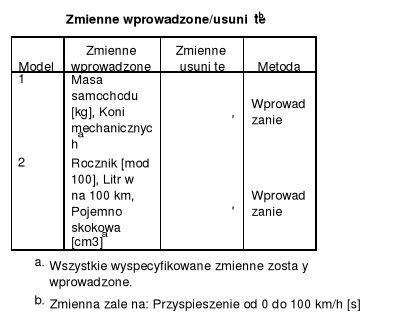

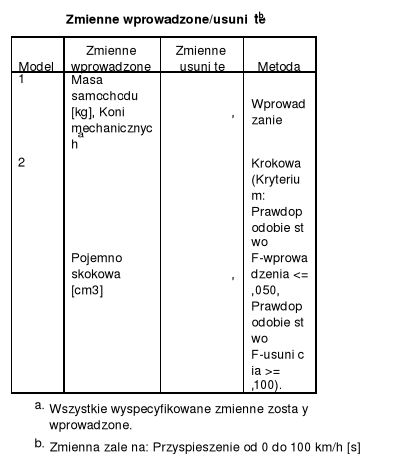

Dobór zmiennych w przypadku wielu zmiennych niezależnych (więcej niż dwie zmienne niezależne)

Metody:

wprowadzania (blokami);

selekcji postępującej: wprowadzane są kolejno zgodnie z rosnącymi wartościami współczynników korelacji ze zmienną zależną;

usuwania (blokami);

eliminacji wstecznej: najpierw wprowadzane są wszystkie zmienne, a następnie kolejno usuwane są te, które są najgorszymi predyktorami;

krokowa: wprowadza się kolejno z możliwością usuwania zmiennych już wprowadzonych.

Jeżeli zmienne niezależne są skorelowane, to stosowanie różnych metod może prowadzić do różnych zestawów użytych zmiennych niezależnych.

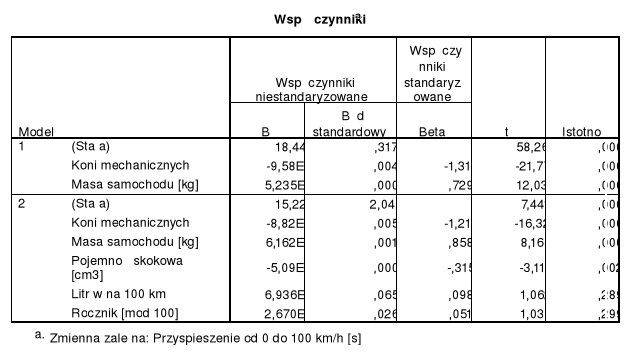

Przykład 1: zastosowanie metody wprowadzania (dane wprowadzane blokami)

Estymacja parametrów

Przykład 2: zastosowanie metody krokowej (dane wprowadzane blokami)

Nieparametryczne metody statystyczne - opcja

Statystyki|Testy nieparametryczne

3.1 Test chi-kwadrat

Służy do weryfikacji hipotez o zgodności danych (pogrupowanych) z założonym rozkładem prawdopodobieństwa. Należy podać „teoretyczne” wartości oczekiwane liczby obserwacji dla każdej grupy.

Test dwumianowy

Stosowany dla danych dychotomicznych. Podaje się „teoretyczne” prawdopodobieństwo obserwacji danych o zadanej wartości, a następnie sprawdza, czy zaobserwowane dane odpowiadają takiemu prawdopodobieństwu.

Test serii

Stosowany dla danych dychotomicznych. Sprawdza losowość serii danych, tzn. czy sekwencja kolejnych danych jest przypadkowa.

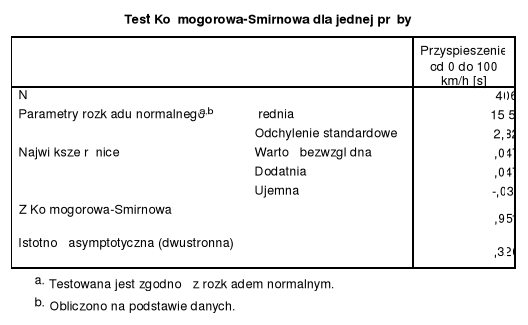

Test Kołmogorowa-Smirnowa dla jednej próby.

Służy do weryfikacji hipotezy czy dane można opisać następującymi rozkładami:

normalnym

wykładniczym

jednostajnym

Poissona

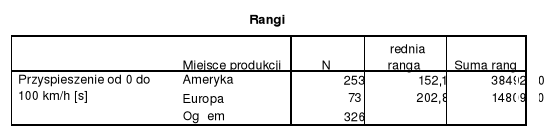

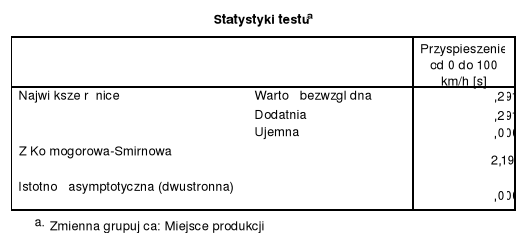

Testy dla dwu prób niezależnych

Weryfikuje się hipotezę, że dane należące do dwu grup opisane są tym samym rozkładem prawdopodobieństwa.

Należy podać zmienną testowaną oraz zmienną grupującą. Dla zmiennej grupującej należy określić dwie jej wartości, które określą porównywane grupy danych.

Wykorzystuje się nieparametryczne testy:

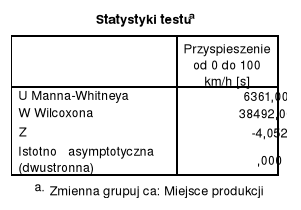

U Manna-Whitneya (domyślnie)

Z Kołmogorowa-Smirnowa

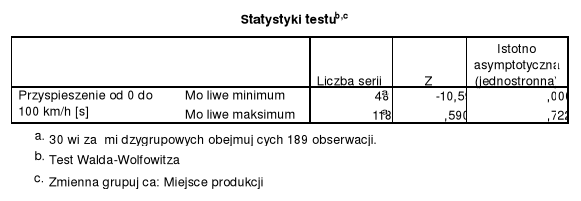

Test serii Walda-Wolfowitza

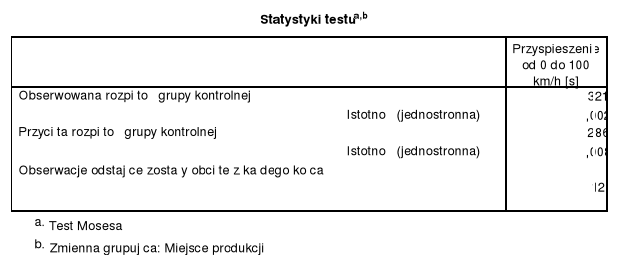

Test skrajnych reakcji Mosesa

Test rang Manna-Whitneya

Test Mosesa

Test Kołmogorowa-Smirnowa dla dwu prób

Test serii Walda-Wolfowitza

Dużo wiązań! Trudno ocenić, czy rozkłady są takie same.

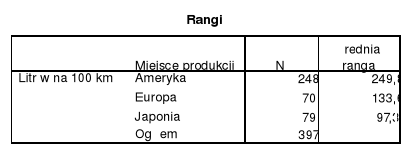

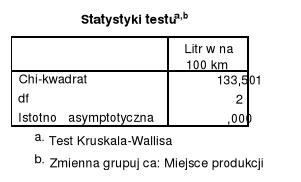

Testy dla K prób niezależnych

Weryfikuje się hipotezę, że dane należące do K grup opisane są tym samym rozkładem prawdopodobieństwa.

Należy podać zmienną testowaną oraz zmienną grupującą.

Wykorzystuje się nieparametryczne testy:

H Kruskala-Wallisa

Jonckheere-Terpstry

Mediany

Test Kruskala-Wallisa

Testy dla dwu prób zależnych

Test Wilcoxona

Test McNemara (zmienne dychotomiczne)

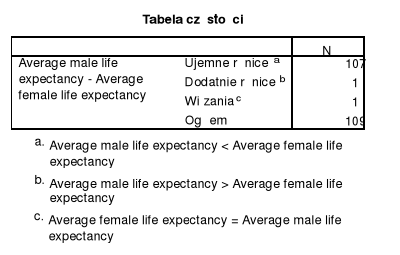

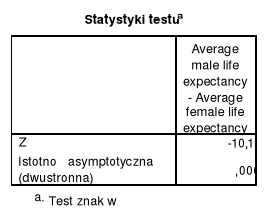

Test znaków

Testy dla K prób zależnych

Test Friedmana

Test Kendalla

Test Cochrana

O.Hryniewicz: Analiza statystyczna - komputery (8 godz.) 94

Wyszukiwarka