img031 (51)

lie do techniki sieci neuronowych 25

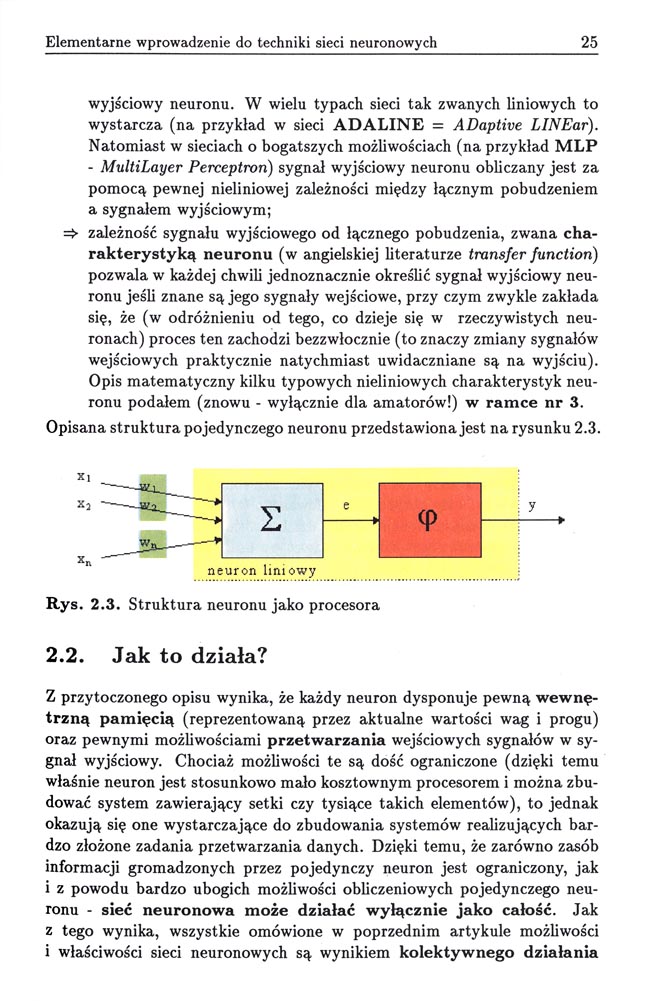

wyjściowy neuronu. W wielu typach sieci tak zwanych liniowych to wystarcza (na przykład w sieci ADALINE = ADaptive LINEar). Natomiast w sieciach o bogatszych możliwościach (na przykład MLP - MultiLayer Perceptron) sygnał wyjściowy neuronu obliczany jest za pomocą pewnej nieliniowej zależności między łącznym pobudzeniem a sygnałem wyjściowym;

=> zależność sygnału wyjściowego od łącznego pobudzenia, zwana charakterystyką neuronu (w angielskiej literaturze transfer function) pozwala w każdej chwili jednoznacznie określić sygnał wyjściowy neuronu jeśli znane są jego sygnały wejściowe, przy czym zwykle zakłada się, że (w odróżnieniu od tego, co dzieje się w rzeczywistych neuronach) proces ten zachodzi bezzwłocznie (to znaczy zmiany sygnałów wejściowych praktycznie natychmiast uwidaczniane są na wyjściu). Opis matematyczny kilku typowych nieliniowych charakterystyk neuronu podałem (znowu - wyłącznie dla amatorów!) w ramce nr 3.

Opisana struktura pojedynczego neuronu przedstawiona jest na rysunku 2.3.

Rys. 2.3. Struktura neuronu jako procesora

2.2. Jak to działa?

Z przytoczonego opisu wynika, że każdy neuron dysponuje pewną wewnętrzną pamięcią (reprezentowaną przez aktualne wartości wag i progu) oraz pewnymi możliwościami przetwarzania wejściowych sygnałów w sygnał wyjściowy. Chociaż możliwości te są dość ograniczone (dzięki temu właśnie neuron jest stosunkowo mało kosztownym procesorem i można zbudować system zawierający setki czy tysiące takich elementów), to jednak okazują się one wystarczające do zbudowania systemów realizujących bardzo złożone zadania przetwarzania danych. Dzięki temu, że zarówno zasób informacji gromadzonych przez pojedynczy neuron jest ograniczony, jak i z powodu bardzo ubogich możliwości obliczeniowych pojedynczego neuronu - sieć neuronowa może działać wyłącznie jako całość. Jak z tego wynika, wszystkie omówione w poprzednim artykule możliwości i właściwości sieci neuronowych są wynikiem kolektywnego działania

Wyszukiwarka

Podobne podstrony:

img077 (25) Elementarr lie do techniki sieci neuronowych !Czy chcesz przystąpić do eksperynento

img033 (49) Elementa lie do techniki sieci neuronowych 27 które elementy należy ze sobą połączy

64807 img217 (5) lie do techniki sieci neuronowych

img027 (50) lie do techniki sieci neuronowych 21 Pierwsza klasa zadań, przy rozwiązywaniu których tr

img235 (9) lie do techniki sieci neuronowych 229 - jedne będą jasne i ciche, inne

więcej podobnych podstron