img309 (3)

Elc-mi- techniki sieci neuronowych 303

Ramka 8.

Uczenie sieci wielowarstwowych metodą wstecznej propagacji błędu

Algorytm opisany w ramce 8 nie daje się zastosować dla sieci wielowarstwowej, gdyż w przypadku sieci wielowarstwowych nie można bezpośrednio określić wymaganych odpowiedzi sygnałów wyjściowych *0) dla warstw ukrytych sieci, a tym samym określić błąd Dlatego w odniesieniu do neuronów tzw. warstw ukrytych także stosuje się wzór

(gdzie m jest numerem rozważanego neuronu) ale zamiast prostego wzoru: g(j) — 2U) — ytj)

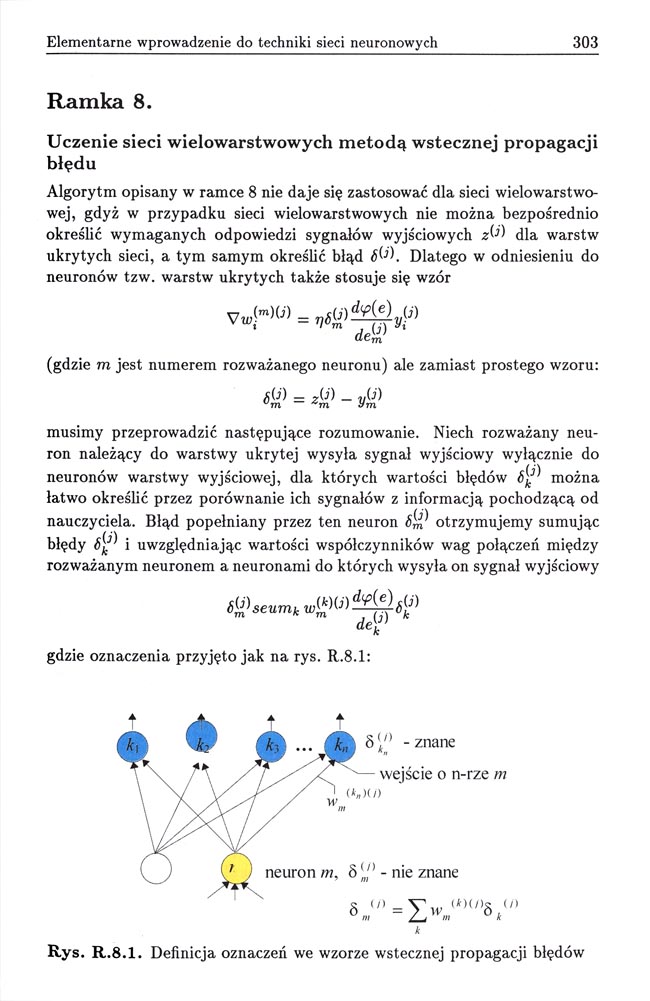

musimy przeprowadzić następujące rozumowanie. Niech rozważany neuron należący do warstwy ukrytej wysyła sygnał wyjściowy wyłącznie do neuronów warstwy wyjściowej, dla których wartości błędów można łatwo określić przez porównanie ich sygnałów z informacją pochodzącą od nauczyciela. Błąd popełniany przez ten neuron 6$ otrzymujemy sumując błędy fff) i uwzględniając wartości współczynników wag połączeń między rozważanym neuronem a neuronami do których wysyła on sygnał wyjściowy

gdzie oznaczenia przyjęto jak na rys. R.8.1:

Rys. R.8.1. Definicja oznaczeń we wzorze wstecznej propagacji błędów

Wyszukiwarka

Podobne podstrony:

img295 (3) wprowadzenie do techniki sieci neuronowych Up Periodically pozwalającą zachować efekt ucz

45435 img307 (3) Elementarne wprowadzenie do techniki sieci neuronowych 301Ramka 6. Technika uczenia

20248 img047 (40) 41 Elementarne wprowadzenie do techniki sieci neuronowych Hebba stanowiącą najpros

img049 (41) oprowadzenie do techniki sieci neuronowych 43 Rys. 3.1. Zmiany współczynników wag w siec

img119 (14) 113 Elementarne wprowadzenie do techniki sieci neuronowych uważyć, że linie po 1668 i po

img161 (8) 155 Elementarne wprowadzenie do techniki sieci neuronowych Rys. 8.20. Początkowy etap ucz

img311 (2) oprowadzenie do techniki sieci neuronowych 305Ramka 9.Uczenie sieci jako minimalizacja fu

img005 (82) Elementarne wprowadzenie do techniki sieci neuronowych 8 Formy uczenia

img091 (20) oprowadzenie do techniki sieci uczenia - pojedynczego neuronu, albo i całej sieci (rys.

więcej podobnych podstron