dscf2654

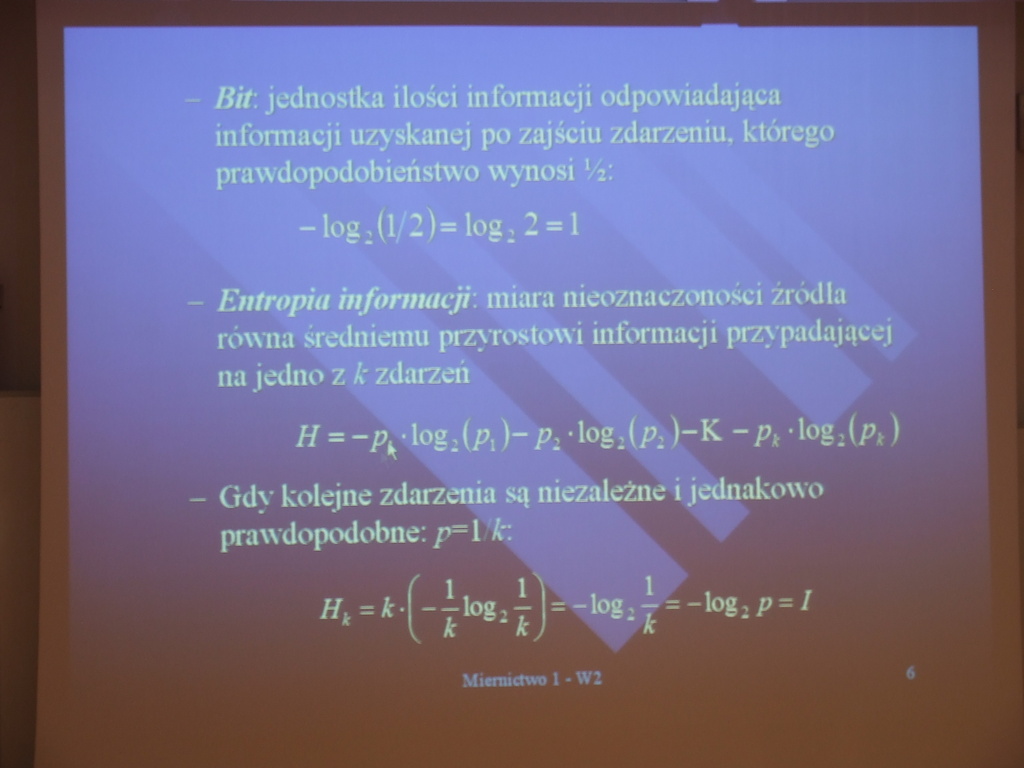

- Bit. jednostka ilości informacji odpowiadająca informacji uzyskanej po zajściu zdarzeniu, którego prawdopodobieństwo wynosi Vi\

-log:(l/2)*log: 2 = 1

- Entropia informacji: miara nieoznaczoności źródła równa średniemu przyrostowi informacji przypadającej na jedno z k zdarzeń

# = -/ylogi(P\)~Pi ,lotóW“K ~Pk ’l°2'.(Pk)

- Gdy kolejne zdarzenia są niezależne i jednakowo prawdopodobne: p=lk:

Wyszukiwarka

Podobne podstrony:

P2283578 Zadanie 2 Kilokalona i BTU (British Terma! Unit) są jednostkami ilości ciepła odpowiednio w

Jednoski pomiaru ilości informacji 1 JEDNOSTKI POMIARU ILOŚCI INFORMACJI W jakich jednostkach wyraża

Jednoski pomiaru ilości informacji 2 Kiedy, czyli dla jakiego rozkładu prawdopodobieństwa niepewność

Jednoski pomiaru ilości informacji 3 Często HfEfl nazywamy entropia komunikatu B ze względu na bezpo

czytanie0022 Celem oglądu jest uzyskanie przed czytaniem możliwie największej ilości informacji. Pod

11972 Slajd32 Kara Kara nie niesie tak dużej ilości informacji co zachowanie. Nagroda wskazuje

kierunki rozwoju przedsiębiorstwa2. Przy tak dużej ilości informacji potrzeby jest odpowiedni sposób

dscf2692 ■ Na poprzednim wykładzie: - Informacja i miary jej ilo

5/26/2014 Definicja jednostki miary niepewności (i miary ilości informacji) ma ścisły związek z

skanuj0011 (348) Historia logistyki Wymagało to przetwarzania olbrzymich ilości informacji. Na szczę

skanuj0039 (85) Rozdział 2.2 biorstwa, ale w zamian dostarcza większej ilości informacji. Integrując

www.mon.gov.pl Więcej informacji uzyskasz w WKU SŁUŻBA KANDYDACKA Jeżeli myślisz o studiach

KOMPUTEROWA ANALIZA SEKWENCJI Współczesna biologia dostarcza ogromnej ilości informacji, których

więcej podobnych podstron