Weryfikacja modelu

dr inż. Iwona Staniec

Zakład Metod Ilościowych w Zarządzaniu

Politechniki Łódzkiej

Założenia Gaussa-

Markowa

Zmienne niezależnesą nielosowe.

Składniki losowe dla i = 1, 2,..., n są

niezależnymi zmiennymi losowymi o

rozkładzie normalnym o:

–

a) wartości oczekiwanej równej zero, czyli

–

b) stałej wariancji

–

c) zerowej kowariancji

0

)

(

t

E

j

i

dla

E

j

i

2

)

,

(

j

i

dla

E

j

i

0

)

,

(

Informacje zawarte w wektorze i macierzy

są jedynymi informacjami, na podstawie

których oszacowane zostaną parametry

równań modelu.

Macierz obserwacji o wymiarach [n(k+1)]

jest macierzą pełnego rzędu, tzn. nie

występuje współliniowość między zmiennymi

egzogenicznymi. Rząd tej macierzy wynosi

(k+1)<n, gdzie n jest liczbą obserwacji, czyli

y

X

X

n

k

rz

1

)

(X

Modele, dla których nie zostało spełnione założenie

o jednorodności wariancji składnika losowego

nazywamy modelami heteroskedastycznymi,

Modele bez spełnionego założenia o autokorelacji

składnika losowego nazywamy modelami

z autokorelacją.

Założenie ostatnie ma zapewnić podstawowy

warunek istnienia macierzy odwrotnej , a

więc .

W przypadku, kiedy założenie to nie jest spełnione,

model jest nieidentyfikowalny, a więc nie można

oszacować jego parametrów.

1

)

(

X

X

T

0

)

det(

X

X

T

Weryfikacja statystyczna

modelu

dotyczy przede wszystkim

weryfikacji przyjętych założeń

o stochastycznej strukturze

modelu oraz założeń o

istotnym wpływie zmiennych

objaśniających na zmienną

objaśnianą za pomocą znanych

testów statystycznych.

Podstawowe elementy weryfikacji

modelu dotyczą:

istotności parametrów modelu, co

polega na sprawdzeniu hipotezy, że

poszczególne parametry strukturalne

istotnie różnią się od zera, która to

hipoteza weryfikowana jest za pomocą

testu t-Studenta,

istnienia autokorelacji, wykorzystując

test Durbina-Watsona. Autokorelacja

oznacza, że składnik losowy jest z sobą

skorelowany np. w czasie,

heteroskedastyczności, tj.

niejednorodności wariancji składnika

losowego, weryfikowanego za pomocą

statystyki Fishera-Snedecora.

Weryfikacja merytoryczna wiąże się z

odpowiedzią na pytanie, czy oszacowane

oceny parametrów równania zgodne są z

przyjętymi założeniami, a także czy istnieje

możliwość "sensownej" interpretacji

otrzymanych wartości ocen parametrów.

Autokorelacja składnika losowego

oraz niejednorodność jego wariancji

jest przyczyną niedoszacowania

standardowych błędów szacunku ,

co może w konsekwencji doprowadzić

do błędnych wniosków przy

weryfikacji hipotez o istotności

wprowadzonych do modelu zmiennych

)

(

j

a

S

1.

Sprawdzenie czy zachodzi związek

regresyjny między zmienna zależną a

którąkolwiek zmienną niezależną

Sprawdzianem tego testu jest

statystyka F postaci:

0

...

:

2

1

0

k

H

,...,k

j

wszystkie

nie

H

j

1

dla

0

:

1

k

k

n

R

R

F

)

1

(

1

2

2

;

F

W

o k oraz n-(k+1) stopniach

swobody.

= 0,05

p

p<

Przykład z poprzedniego

wykładu

Stawiamy hipotezy:

x

65

5

y

o 1 i 3 stopniach swobody

= 0,05

%

94

94

,

0

16

,

0

1

9000

*

5

900

1

2

R

0

:

1

0

H

,...,k

j

wszystkie

nie

H

j

1

dla

0

:

1

47

1

3

06

,

0

94

,

0

)

1

(

1

2

2

k

k

n

R

R

F

;

13

,

10

;

F

W

Odrzucamy zatem hipotezę zerową o braku zależności

regresyjnej między zmienną zależną a zmiennymi

niezależnymi

2.

Istotność wpływu zmiennych

objaśniających na zmienną

objaśnianą

Sprawdzianem tego testu jest

statystyka t-Studenta postaci:

o n-(k+1) stopniach swobody.

0

:

0

j

H

0

:

1

j

H

)

(

j

j

a

S

a

t

0

:

1

j

H

;

;

t

t

W

0

:

lub

0

:

1

1

j

j

H

H

;

2

t

W

2

; t

W

0

:

lub

0

:

1

1

j

j

H

H

W sytuacji, kiedy dla zadanego poziomu

istotności nie ma podstaw do odrzucenia

hipotezy zerowej należy zmienną x

j

(j = 1,

2,..., k) usunąć z równania i ponownie je

oszacować, być może wprowadzając na jej

miejsce inne zmienne.

Wyraz wolny zazwyczaj pozostawia się w

modelu nawet jeśli jego wpływ nie jest

istotny, bowiem często jego usunięcie

znacznie obniża poziom współczynnika

determinacji.

W praktyce często pozostawia się nawet

statystycznie nieistotne zmienne, jeśli

ich usunięcie powoduje znaczne

pogorszenie stopnia dopasowania

wartości teoretycznych do danych

empirycznych i nie można znaleźć

innych zmiennych niezależnych, które

mogłyby przyczynić się do wyjaśnienia

kształtowania się zmiennej zależnej.

Przykład z poprzedniego

wykładu

Stawiamy hipotezy:

x

65

5

y

)

(

0

a

S

31,75

)

(

1

a

S

9,58

0

:

0

0

H

0

:

0

1

H

16

,

0

75

,

31

5

)

(

0

0

a

S

a

t

o n-(k+1)=5-2=3

stopniach swobody

;

35

,

2

;

2

t

W

= 0,05

W

t

,

t

o

n

i

e

m

a

p

o

d

s

t

a

w

d

o

o

d

r

z

u

c

e

n

i

a

H

0

Przykład z poprzedniego

wykładu

Stawiamy hipotezy:

x

65

5

y

)

(

0

a

S

31,75

)

(

1

a

S

9,58

0

:

1

0

H

0

:

1

1

H

78

,

6

58

,

9

65

)

(

1

1

a

S

a

t

o n-(k+1)=5-2=3

stopniach swobody

;

35

,

2

;

2

t

W

= 0,05

W

t

,

t

o

o

d

r

z

u

c

a

m

y

h

i

p

o

t

e

zę

H

0

n

a

r

z

e

c

z

h

i

p

o

t

e

z

y

a

l

t

e

r

n

a

t

y

w

n

e

j

3.

weryfikacja hipotezy o

autokorelacji

Do

weryfikacji

hipotezy

o

autokorelacji wykorzystywany jest

test Durbina-Watsona.

W teście tym hipoteza zerowa

formułowana jest jako:

gdzie

oznacza

nieznany

współczynnik

autokorelacji, którego estymatorem jest

współczynnik autokorelacji w próbie

wyznaczany jako

:

0

:

0

H

T

t

t

T

t

t

t

T

t

T

t

t

t

T

t

t

t

e

e

e

e

e

e

e

1

2

2

1

1

2

2

1

2

2

1

Dla hipoteza alternatywna

formułowana jest w postaci:

Sprawdzianem w tym teście dla

modeli, w których nie występują

zmienne endogeniczne opóźnione,

jest statystyka Durbina-Watsona

postaci:

0

0

:

1

H

T

t

t

T

t

t

t

e

e

e

DW

1

2

2

2

1

)

(

Dla zadanego poziomu istotności w tablicach

statystycznych odczytuje się wartości krytyczne: dolną i

górną rozkładu Durbina-Watsona w zależności od liczby

szacowanych parametrów (k+1) oraz liczebności próby

statystycznej T. Jeżeli DW < , wówczas odrzucamy

hipotezę zerową na rzecz hipotezy alternatywnej, co

oznacza

istnienie

dodatniej

autokorelacji.

Jeżeli

natomiast DW > , to nie ma podstaw do odrzucenia

hipotezy zerowej, czyli ją przyjmujemy i stwierdzamy

brak istotnej korelacji dodatniej. W sytuacji gdy test nie

daje odpowiedzi na temat występowania autokorelacji,

jest to tak zwany obszar niekonkluzywności. W tym

przypadku najczęściej zaleca się zwiększenie liczebności

próby statystycznej, o ile oczywiście jest to możliwe.

l

d

u

d

l

d

u

d

W

celu

zweryfikowania

hipotezy

o

występowaniu

ujemnej

autokorelacji,

hipotezę alternatywną formułuje się jako:

a

sprawdzianem

tej

hipotezy

jest

statystyka:

którą porównuje się z wartościami krytycznymi i

w taki sam sposób, jak w przypadku opisanej

wcześniej autokorelacji dodatniej.

0

:

1

H

DW

4

DW'

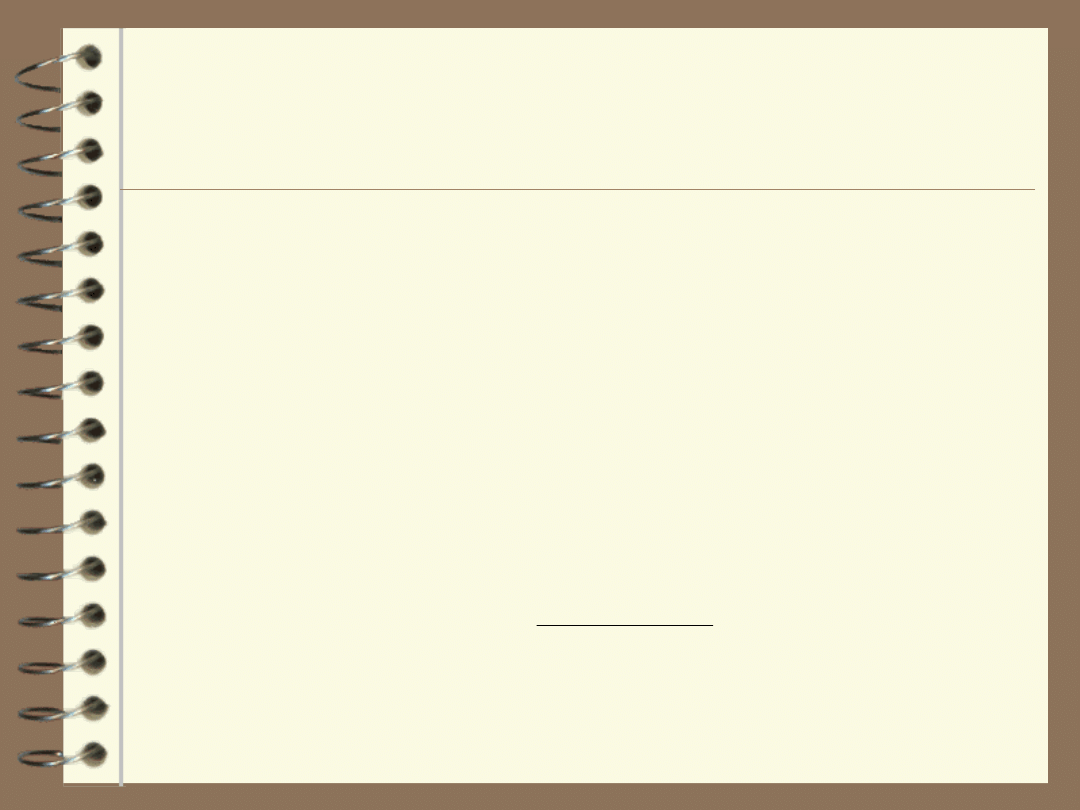

Przykład z poprzedniego

wykładu

y

t

t

y

ˆ

e

t

e

t

2

e

t

-

1

e

t

-

1

2

e

t

e

t

-

1

e

t

-

e

t

-

1

(

e

t

-

e

t

-

1

)

2

1

0

0

7

0

3

0

9

0

0

1

0

0

1

3

5

-

3

5

1

2

2

5

3

0

9

0

0

-

1

0

5

0

-

6

5

4

2

2

5

2

0

0

2

0

0

00-

3

5

1

2

2

5

03

51

2

2

5

2

5

0

2

6

5

-

1

5

2

2

5

000-

1

52

2

5

3

5

0

3

3

0

2

0

4

0

0

-

1

5

2

2

5

-

3

0

0

3

51

2

2

5

2

7

5

0 2

3

5

0

-

1

3

5

0

-

1

0

6

9

0

0

Przykład z poprzedniego

wykładu

0

:

0

H

53

,

0

2350

2750

1350

1

2

2

1

2

2

1

T

t

T

t

t

t

T

t

t

t

e

e

e

e

0

:

1

H

5

,

1

5

,

2

4

DW'

5

,

2

2750

6900

)

(

1

2

2

2

1

T

t

t

T

t

t

t

e

e

e

DW

DW

4

DW'

08

,

1

l

d

36

,

1

u

d

g

d

5

,

1

DW'

nie ma podstaw do odrzucenia

hipotezy zerowej, czyli ją

przyjmujemy i stwierdzamy brak

istotnej korelacji ujemnej

4.

Niejednorodność

wariancji składnika

losowego

Do weryfikacji stosuje się test Fishera-

Snedecora o jednorodności wariancji

2

2

2

1

e

e

S

S

F

o (n

1

-(k+1)) i (n

2

-(k+1)) stopniach

swobody

;

F

W

n

i

T

i

n

i

i

i

e

k

n

e

k

n

y

y

k

n

S

1

2

1

2

2

)

1

(

1

)

1

(

1

)

(

)

1

(

1

e

e

2

2

2

1

0

:

H

2

2

2

1

1

:

H

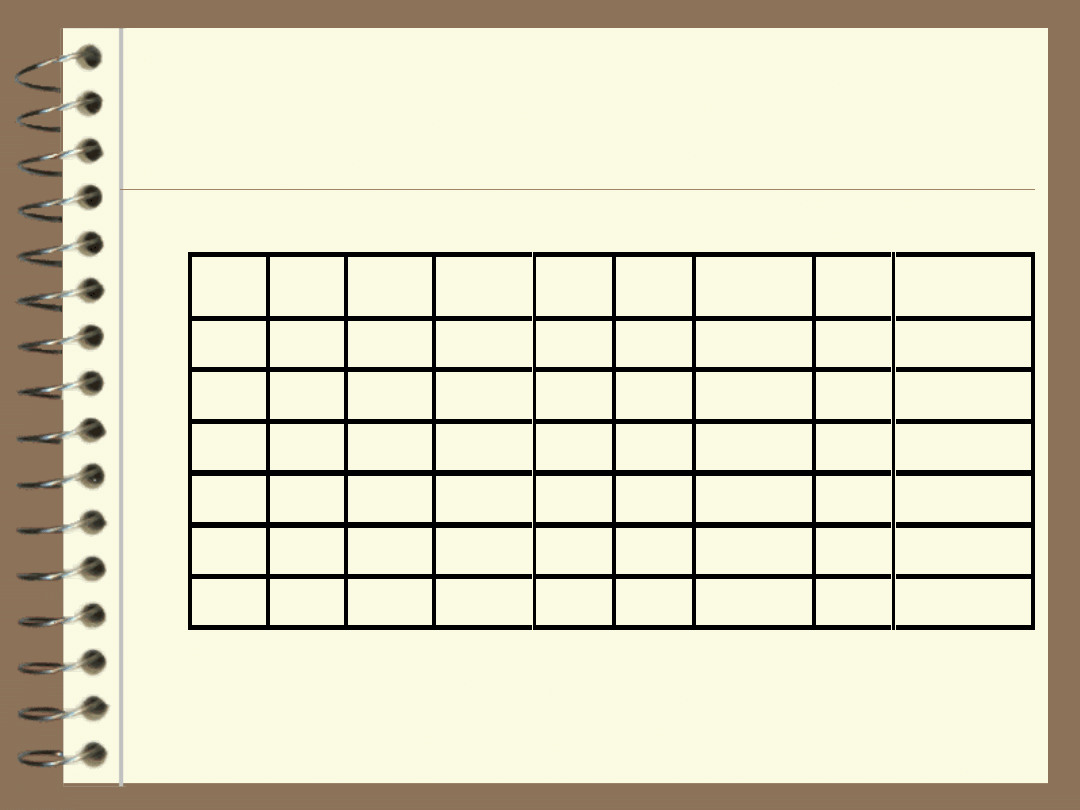

Przykład z poprzedniego

wykładu

3

,

2

925

2125

2

2

2

1

e

e

S

S

F

o 1 i 2 stopniach swobody

;

51

,

18

W

2125

2125

)

1

1

(

3

1

)

1

(

1

1

2

2

3

n

i

i

pe

e

k

n

S

2

2

2

1

0

:

H

2

2

2

1

1

:

H

925

1850

)

1

1

(

4

1

)

1

(

1

1

2

2

4

n

i

i

ke

e

k

n

S

Nie ma podstaw do

odrzucenia hipotezy o

jednorodności wariancji

składnika losowego.

5.

Skorygowany

współczynnik determinacji

Decydujemy się na włączenie

dodatkowej zmiennej do modelu

jeżeli powoduje to wzrost

skorygowanego współczynnika

determinacji

1

1

1

1

2

2

k

n

n

R

R

Document Outline

- Slide 1

- Slide 2

- Slide 3

- Slide 4

- Slide 5

- Slide 6

- Slide 7

- Slide 8

- Slide 9

- Slide 10

- Slide 11

- Slide 12

- Slide 13

- Slide 14

- Slide 15

- Slide 16

- Slide 17

- Slide 18

- Slide 19

- Slide 20

- Slide 21

- Slide 22

- Slide 23

- Slide 24

Wyszukiwarka

Podobne podstrony:

estymacja i weryfikacja modelu, Ekonometria

Weryfikacja modelu regresji z Exelem

KMNK weryfikacja modelu zadanie

Weryfikacja modelu prognostycznego

Weryfikacja własności stochastycznych modelu

7 weryfikacja jednorównaniowego modelu liniowego

Weryfikacja hipotez statystycznych

Wykorzystanie modelu procesow w projektowaniu systemow informatycznych

Krzywa opytu w modelu chamberlena

Badanie wpywu komponentw modelu SPP na dokadno wyznaczenia

Identyfikacja modelu matematycznego elementu

Porównajcie równowagę w neoklasycznej i keynesistowskim modelu

8 wnioskowanie na podstawie modelu ekonometrycznego prognozowanie ekonometryczne

Weryfikacja hipotez 3 (2 średnie), Semestr II, Statystyka matematyczna

7.Budowa i weryfikacja hipotez badawczych, licencjat(1)

więcej podobnych podstron