równanie kolinearności w postaci wektorowej

1. Podstawowe definicje:

Elementy orientacji wewnętrznej - ck-stała kamery - odległość od obrazowego środka rzutu do punktu głównego; x0, z0 - współrzędne środka rzutu (punktu głównego) w układzie (łącznic) znaczków tłowych - osie definiowane przez znaczki tłowe. *osie układu tłowego nie są równoległe do łącznic znaczków tłowych! ; EOW - mają na celu odtworzenie wiązki promieni rzutujących w kamerze.

Elementy orientacji zewnętrznej - X0,Y0,Z0 - wsp. środka rzutu (punkt główny przedmiotowy -zewnetrzny G) w układzie terenowym; 3 kąty orientacji ω - nachylenie osi kamery φ - azymut (kąt kierunkowy )osi kamery, κ - kąt skręcenia zdjęcia, mierzony w płaszczyźnie zdjęcia pomiędzy osią tłową a krawędzią płaszczyzny poziomej na zdjęciu. EOZ -służą do umiejscowienia wiazki promieni rzutujących w przestrzennym układzie odniesienia.

Elementy orientacji wzajemnej - służą do doprowadzenia do przecięcia się promieni homologicznych; 3 kąty skręcenia zdjęcia prawego względem lewego; ΔZ i ΔY - różnice pomiędzy wsp. środków rzutów obu wiązek → bz i by - bazy. Wyliczane na podstawie pomierzonych punktów w rejonach Grubera (co najmniej 1 w każdym z rejonów).-wystarczy 5 punktów aby aby doprowadzić do przecięcia, ale bez wyrównania

Elementy orientacji bezwzględnej - skala, 3 kąty obrotu układu modelu do układu terenowego i współrzędne początku układu modelu (środek rzutu dla lewego zdjęcia) w układzie odniesienia . Mają na celu przejście z układu modelu do układu terenowego, wyznaczone z pomiaru co najmniej 3 fotopunktów nie leżących na jednej prostej.

Punkt główny zdjęcia -Rzut ortogonalny obrazowego punktu węzłowego obiektywu na płaszczyznę ramki tłowej.

Środek rzutów - punkt skupienia wiązki promieni rzutujących.

Stała kamery - odległość od obrazowego środka rzutu do punktu głównego.

Oś kamery - prosta prostopadła do ramki tłowej przechodząca przez środek rzutów (punkt obrazowy) i punkt główny zdjęcia.

Układ tłowy - układ współrzędnych o środku w punkcie głównym, oraz osiach x, y zdefiniowanym przez znaczki tłowe.

Przestrzenny układ tłowy - układ o początku w obrazowym środku rzutu, oraz osiach x, y zdefiniowanych przez znaczki tłowe

Układ modelu - przestrzenny układ tłowy lewego zdjęcia,

Układ fotogrametryczny - terenowy układ modelu (pomocniczy) o początku w środku rzutu (punkt główny przedmiotowy obiektywu) lewej kamery, dla fotogrametrii naziemnej. Oś y - pozioma i wyznaczana przez kierunek osi kamery (ale się z nią nie pokrywa), oś x - prostopadła do osi y, oś z - pionowa.

Dystorsja obiektywu - błąd obiektywu, który zaburza kolinearność promieni w rzucie obiektywu; radialna - wychodzi z punktu przecięcia osi obiektywu z płaszczyzną tłową; tangensjalna - kiedy soczewki niedokładnie scentrowane czy wyszlifowane,

Dystorsja dla kamer metrycznych często zaniedbywana.

Stereogram zdjęć normalnych - osie zdjęć równoległe do siebie i prostopadłe do bazy, osie kamer poziome.

2. Jak należy wykonywać zdjęcia stereoskopowe?

osie prawie równoległe do siebie i prostopadłe do bazy, nie muszą być poziome, obiekt na dwóch zdjęciach( pokrycie podłużne), skala zdjęć nie powinna się róznic więcej niż 15 %

3.Jak uzyskuje się sztuczny efekt stereoskopowy?

- zdjęcie lewe obserwujemy okiem lewym , a zdjęcie prawe okiem prawym+ punkty należy obserwować w płaszczyznach rdzennych - promienie homologiczne muszą się przecinać

4.Wymień i scharakteryzuj transformacje wykorzystywane do wyznaczenia współrzędnych tłowych zdjęć fotogrametrycznych.

transformacja helmerta- 4 parametry ( skala, przesunięcie,kąt) ; wykonywana gdy zdjęcia są robione na kliszach szklanych ponieważ wtedy zdjęcia są niekurczliwe - potrzebujemy 2 znaczki, gdy mamy ich więcej jest to kontrola czy występują błędy grube. Docelowo wykonywana również w VSD gdy mamy zdjęcie cyfrowe.

Transformacja afiniczna - 6 parametrów - wykonywana dla zdjęć lotniczych, uwzględnia skosowanie układu i gdy mamy inne skale w obu osiach. Potrzebujemy co najmniej 3 punkty.

Transformacja biliniowa - 8 parametrów - 4 punkty - uwzględnia nierównomierność skurczu materiału fotograficznego spowodowanego naciągiem filmu.

Transformacja rzutowa - 8 parametrów - 4 punkty - przekształca odpowiednie sobie punkty leżace na 2 płaszczyznach rzutowych.

5.Jakie są korzyści ze stosowania macierzy małych obrotów w obliczeniach fotogrametrycznych?

macierz transformacji lewego zdjęcia do prawego; transformacja konforemne-wiernokątna

sinus=kat, cos=1, sincos=kąt

6.Wykaż posługując się równaniem kolinearności, że do fotogrametrycznego określenia

współrzędnych przestrzennych punktu powinien on być sfotografowany na co najmniej dwu zdjęciach.

równanie kolinearności w postaci wektorowej

A- macierz małych kątów

lambda- współczynnik skali

7.Co jest celem orientacji wzajemnej dwu zdjęć? Wymień i zdefiniuj elementy orientacji

wzajemnej w układzie modelu definiowanym przez lewe zdjęcie.

cel- przecięcie wiązek homologicznych i uzyskanie modelu przestrzennego.

Obliczenia 5 ( składowe bazy Bxi By oraz omega,fi, kappa )elementów orientacji wzajemnej oraz współrzędnych przecięcia promieni jednoimiennych wykonuje się w przestrzennym układzie tłowym zdjęcia lewego, które z założenia posiada elementy kątowe równe zero. Układ ten zaczepiony jest w środku rzutów zdjęcia lewego, osie x i y są odpowiednio równoległe do osi x i y na zdjęciu, a oś „z” pokrywa się z osia kamery.

Ze względu na nieliniowość równań kolinearności, z których wyznaczane są elementy orientacji wzajemnej proces obliczeniowy przeprowadzany jest iteracyjnie, natomiast jako przybliżone wartości niewiadomych przyjmuje się zero.

8.Analityczna postać warunku przecinania się dwu promieni homologicznych.

iloczyn mieszany ??????

9.Co to jest zdjęcie ekwiwalentne? Jaki jest cel stosowania?

Zdjęcie ekwiwalentne - zastępcze, przetworzone (analitycznie bądź komputerowo) na zdjęcie, które ma ten sam środek rzutów, ale inne kąty.

mozna przeliczyc na zdjęcie o innym Ck

wykorzystywane w metodzie uproszczonej stereogramu 2 zdjęć o osiach dokładnie równoległych i wykorzystuje się do wcięcia w przód.

10.Przedstaw wady metody dwuetapowej wyznaczania terenowych współrzędnych za

pomocą zdjęć lotniczych z wykorzystaniem zdjęć ekwiwalentnych.

- na każdym zdjęciu muszą być co najmniej 3 fotopunkty

-nie wykorzystuje się przecięć promieni homologicznych

-jeśli są to te same 3 fotopunkty na obu zdjęciach to ich rozmieszczenie nie jest korzystne dla wcięcia wstecz

11.Wykaż, że do wykonania orientacji wzajemnej z zastosowaniem równania kolinearności

potrzeba pomierzyć co najmniej 5 punktów homologicznych (układ modelu związany z

lewym zdjęciem).

Mamy tutaj 15 niewiadomych + 5 parametrów orientacji wzajemnej → potrzebujemy 20 równań.

1 punkt mam na 2 zdjęciach więc mamy 4 równania → potrzebujemy 5 punktów.

12.Jaki rodzaj transformacji jest wykorzystywany w orientacji bezwzględnej? Uzasadnij

minimalną ilość fotopunktów do tej orientacji.

orientacja bezwzględna jest procedurą, w której wykonywane jest przejście do układu terenowego, realizowane poprzez transformację przestrzenną układu modelu do układu terenowego (geodezyjnego). Niewiadomych jest 7 dlatego potrzeba 3 fotopunktów ( dadzą one nam 9 równań)

13.Zależność rzutowa między zdjęciem a mapą

rzutowa 8 parametrów----> 4 fotopunkty, żadne 3 nie leżą na linii

14.Linearyzacja równania kolinearności. Objaśnij, w jaki sposób możemy wyznaczyć lub

przyjąć wartości początkowe niewiadomych dla zdjęć lotniczych?

początkowe wartości X,Y przyjmujemy z projektu lotu a Z z wysokości lotu+ wys. n.p.m.

slajd 8 wykład 2i3

Linearyzacja równania przeprowadzana jest przez zastąpienie ścisłej macierzy obrotów przez macierz małych kątów, która jest jej przybliżeniem. Powoduje to konieczność iteracyjnego obliczenia niewiadomych.

Z uwagi na linearyzację równań niewiadomymi są przyrosty do przyjętych początkowych wartości

niewiadomych (elementów orientacji zewnętrznej zdjęcia). Duże przybliżenie tych początkowych

wartości niewiadomych powoduje konieczność wykonania obliczeń na drodze iteracyjnej.

Jednoznaczne rozwiązanie uzyskamy dysponując trzema punktami terenowymi i odpowiadającymi

im obrazami na zdjęciu. W przypadku większej ilości punktów po prawej stronie równań pojawią

się poprawki vx, vy i zagadnienie rozwiązujemy stosując metodę najmniejszych kwadratów.

15.Przejście z 3D na 2D drogą przekształcenia rzutowego (metodą DLT).

Inną parę utworów, których wzajemna rzutowość może mieć praktyczne znaczenie stanowią: płaszczyzna punktów (fotogramu) i przestrzeń punktów (mierzonego obiektu). Zapis matematyczny tej zależności jest znany pod nazwą DLT (ang. Direct Linear Transformation - bezpośrednia transformacja liniowa):

Ze względu na liczbę współczynników (11) zależność ta nazywana jest także „jedenastoparametrową”.

16.Objaśnij zasadę opracowania stereogramu na autografie.

Autograf jest przyrządem automatyzującym i ułatwiającym opracowanie mapy na podstawie stereogramu. Ide autografu najłatwiej jest wyjaśnić, zestawiając rejestrację punktu na zdjęciach z rekonstrukcję pary promieni rzucających, które obrazy tego punktu utworzyły - w autografie mechanicznym. W przyrządzie takim (rys. 3.9), po osadzeniu przestrzennego znaczka pomiarowego na jakimś szczególe modelu stereoskopowego, metalowe wodzidła odtwarzają przestrzenne usytuowanie promieni, które wcześniej utworzyły obrazy tego szczegółu na zdjęciu lewym i prawym.

ETAPY:

Budowa przestrzennego modelu:

orientacja wewnętrzna

orientacja zewnętrzna

Orientacja modelu do układu odniesienia

skalowanie i poziomowanie - dla analogowych

orientacja bezwzględna - dla analitycznych i cyfrowych

stereodigitalizacja

17.Porównanie autografów: analogowego, analitycznego i cyfrowego.

W zależności od koncepcji budowy, rozróżniamy autografy oparte na zasadzie rekonstrukcji: mechanicznej, optycznej bądź ( matematycznej (autograf analityczny). W autografach umieszcza się fotogramy, albo wykorzystuje ich obrazy cyfrowe; w tym drugim przypadku mówimy o autografach cyfrowych.

Analogowy - paralaksa poprzeczna usuwana na modelu ruchami prawego zdjęcia (układ związany z lewym zdjęciem) lub ruchami obu (gdy układ związany z bazą); stosowanie kolejnych przybliżeń; wprowadzanie pewnej wyliczonej wartości paralaksy.

Autograf analityczny - w najkrótszym ujęciu - tworzy pracujące w sprzężeniu zwrotnym: jednostka mierząca („stereokomparator”) oraz komputer dużej mocy ze specjalistycznym oprogramowaniem; z tym zestawem sprzężony jest plotter i inne urządzenia peryferyjne. Zdjęcia umieszczone na poziomych nośnikach, poruszane względem siebie.

Obecnie funkcję autografów analogowych przejęły autografy cyfrowe i cyfrowe stacje

fotogrametryczne. W autografach cyfrowych występują filtry polaryzujące czynne lub bierne.

18.Metody uzyskania sztucznego efektu stereoskopowego wykorzystywane w autografach

analogowych i cyfrowych.

punkty (szczegóły) obserwuje się w ich płaszczyznach rdzennych, tj. w płaszczyznach

wyznaczonych przez obydwa środki rzutów i obserwowany punkt (rys. 3.4, 3.5).

To oznacza, że obserwowane zdjęcia powinny zajmować takie położenie

(przestrzenne), jakie zajmowały w momencie fotografowania. Taki sposób odtworzenia

przestrzennego ułożenia fotogramów jest realizowany w autografach analogowych, których

konstrukcja umożliwia odpowiednie nachylanie (o katy fi,omega) i skręcenie obserwowanych

zdjęć (o kat kappa), oraz wzajemne oddalenie zdjęć o składowe bazy (bx, by, b). W przypadku

obserwacji fotogramów ułożonych płasko oznacza to, że powinny one zostać tak skręcone,

aby promienie rdzenne - ślady płaszczyzn rdzennych na zdjęciach - tworzyły jedną prostą. Po

spełnieniu powyższych warunków możemy obserwować przestrzenny model stereoskopowy

sfotografowanego przedmiotu.

19.Zasada znaczka mierzącego w sztucznym efekcie stereoskopowym.

Jeżeli w polu widzenia każdego z fotogramów umieści się - w płaszczyźnie rdzennej obserwowanego szczegółu - jednakowe znaczki pomiarowe (np. kropki), to w przestrzeni modelu stereoskopowego zauważy się przestrzenny znaczek pomiarowy (rys. 3.6). Przesuwając jeden ze znaczków pomiarowych w lewo lub w prawo (w płaszczyżnie rdzennej oberwowanego szczegółu), odbieramy wrażenie przybliżania lub oddalania się przestrzennego znaczka od obserwowanego stereoskopowego modelu przedmiotu. Znając wielkość przesunięcia znaczka pomiarowego, możemy obliczyć wielkość przestrzennego przemieszczenia przestrzennego znaczka pomiarowego na modelu stereoskopowym. Przestrzenny znaczek pomiarowy spełnia w fotogrametrii rolę pomiarowego - wysyłanego z tyczką lub sygnałem w określone miejsce mierzonego obiektu, aby móc pomiarowo określić jego położenie. Jest to zasadnicza koncepcja pomiarów stereofotogrametrycznych.

20.Co to są płaszczyzny rdzenne, linie rdzenne i zdjęcia znormalizowane (epipolarne)?

płaszczyzna rdzenna - płaszczyzna wyznaczona przez przez obydwa środki rzutów i obserwowany punkt

promienie rdzenne - krawędzie przecięcia zdjęć z płaszczyzną rdzenną

zdjęcie epipolarne - przetransformowane zdjęcie do takiego układu, w którym promienie rdzenne są równoległe do osi x układu tłowego.

21 .Porównaj etapy opracowania stereogramu zdjęć lotniczych na autografie analogowym i cyfrowym.

Etapy opracowania zdjęć na autografie analogowym

Centrowanie zdjęć na nośnikach

Wybór skali modelu - zależny od deniwelacji terenu i zakresu z-ów autografu, od przekładni model: stół do kartowania

Orientacja wzajemna - usuwanie paralaksy poprzecznej na modelu na punktach Grubera drogą kolejnych przybliżeń

Skalowanie modelu - nastawienie składowych bazy obliczonych na podstawie pomiaru odcinków między fotopunktami na modelu

Poziomowanie modelu - wprowadzenie obliczonych na podstawie znajomości współrzędnych fotopunktów (model, teren) kątów obrotu modelu

Kreślenie sytuacji i warstwic

Etapy opracowania zdjęć na autografie cyfrowym

Orientacja wewnętrzna - pomiar znaczków tłowych i transformacja pomierzonych współrzędnych do układu tłowego (na podstawie danych z kalibracji)

Orientacja wzajemna - usuwanie paralaksy poprzecznej na modelu na punktach Grubera drogą kolejnych przybliżeń

Orientacja bezwzględna - transformacja z układu modelu do układu terenowego

Wektoryzacja treści mapy

Wykonanie pomiaru do DTM

Edycja mapy

(więcej wykład 2 i 3)

Porównanie:

orientacja wewnętrzna na autografie analogowym to centrowanie zdjęć na nośnikach (transformacje mechaniczne), na autografie cyfrowym to transformacja pomierzonych współrzędnych w układzie obrazu do układu tłowego na podstawie danych z kalibracji kamery

orientacja wzajemna: na autografie analogowym i cyfrowym wykonywana metodą kolejnych przybliżeń (metoda iteracyjna)- z taką różnicą, ze na autografie analogowym proces ten jest bardzo czasochłonny

orientacja bezwzględna na autografie analogowym składa się z 2 etapów:

poziomowanie wykorzystuje kąty skręcenia

skalowanie: współczynnik skali i położenie prawego zdjęcia

na autografie cyfrowym orientacja bezwzględna wykonywana w 1 etapie, w którym są wyznaczane wszystkie niewiadome (współczynnik skali, Xo,Yo,Xo, kąty skręcenia)

Układ modelu stereogramu zdjęć lotniczych a układ fotogrametryczny stereogramu zdjęć naziemnych: przeprowadź analogie, wskaż różnice.

Układ fotogrametryczny- układ terenowy do wyznaczania współrzędnych terenowych X,Y,Z punktów mierzonych fotogrametrycznie, dotyczy stereogramów zdjęć naziemnych. Stereogram- para zdjęć o osiach równoległych (zdjęcia normalne lub nachylone) lub osiach zbieżnych; nazywany pomocniczym układem modelu; początek- środek rzutów lewego zdjęcia O'; oś Yf jest pozioma i zgodna z kierunkiem osi lewej kamery, oś Xf jest pozioma prostopadła do Yf i równoległa do bazy fotografowania B, oś Zf jest pionowa, współrzędne wyrażone w układzie odniesienia

układ modelu stereogramu zdjęć lotniczych: pierwszy układ 3D w strojeniu stereogramu który otrzymujemy wskutek przeprowadzenia orientacji wzajemnej, nazywany przestrzennym układem tłowym lewego zdjęcia, początek w środku rzutów zdjęcia lewego, osie x i y są równoległe do osi x i y na zdjęciu lotniczym, oś z pokrywa się z osią kamery lewego zdjęcia; stała ck do rekonstrukcji wiązki promieni rzutujących. Układ modelu jest układem przeskalowanym, nie ma współrzędnych terenowych (rzeczywistych), bazy są nierzeczywiste, jest zawieszony w przestrzeni

Analiza dokładności pomiaru stereofotogrametrycznego

Dokładności pomiaru metodami fotogrametrycznymi.

m X,Y pom = ± 0.5 piksela terenowego

m Z pom = ± 0.5 piksela terenowego * stosunek bazowy (W/B lub ck/b)

Dokładność NMT to błąd średni wysokości wyinterpolowanej z wynikowego NMT.

Na błąd ten składają się:

- błędy pomiaru wysokości punktów,

- gęstość pomiaru punktów,

- charakter terenu.

mz2DTM = mz2pom. + ( a* d)2

gdzie: m Z DTM - błąd średni wyinterpolowanej wysokości,

m Z pom - błąd średni danych pomiarowych,

d - średnia odległość punktów pomiarowych

a - współczynnik opisujący charakter terenu (0.004-0.007 dla terenów łatwych 0.01-0.02 dla terenów średnich 0.022-0.044 dla terenów trudnych)

Czym charakteryzuje się kamera niemetryczna?

Nie ma stałych elementów orientacji wewnętrznej: (są niestabilne) x0, y0 (z0), ck

nie ma urządzeń do nastawiania elementów orientacji zewnętrznej

znacznie większe wartości dystorsji obiektywu

kamery niemetryczne to zwykłe aparaty fotograficzne

Niestabilność lub nieznajomość elementów orientacji wewnętrznej, brak precyzji mechanicznej i spełnienia warunków optycznych, muszą być jednak wtedy rekompensowane dodatkowymi danymi; stosowane są specjalne sposoby obliczeń.

Metody fotogrametrycznego opracowania zdjęć niemetrycznych:

Popularne DLT czyli przejście z 3D na 2D- bezpośrednia transformacja liniowa, ma 11 parametrów (A-K)- nie musimy znać przybliżen elementow orientacji jak to jest wymagane w przypadku równan kolinearnosci

Samokalibracja- wyrównanie wiązki promieni rzutujących

Jakie parametry kamery zawiera certyfikat kalibracji?

Zgodnie z obowiązującymi przepisami, kamery używane do celów pomiarowych podlegają okresowym sprawdzeniom i kalibracjom; dotyczy to zwłaszcza kamer lotniczych - sprawdzanych co 2 lata.

W trakcie kalibracji określa się elementy orientacji wewnętrznej (jako dane niezbędne do poprawnej rekonstrukcji wiązki promieni):

stałą kamery (ck),

- współrzędne punktu głównego w układzie łącznic znaczków tłowych (xo, yo , lub xo, zo),

- parametry dystorsji,

- współrzędne znaczków tłowych.

Wymienione informacje uzyskuje się porównując terenowe współrzędne punktów (lub znane kierunki) z ich współrzędnymi w płaszczyźnie tłowej. Punkty znane - to zazwyczaj punkty pola testowego, albo punkty rzutowane przez laboratoryjny kalibrator kamer.

27.Czym spowodowane są przesunięcia radialne na zdjęciu lotniczym?

Deniwelacje terenu

nachylenie zdjęcia (zdjęcia nie są ścisłe pionowe, płaszczyzna zdjęć nie jest równoległa do płaszczyzny terenu)

Dystorsją obiektywu

przesunięcie radialne Δr -położenie punktu na zdjęciu od położenia punktu na mapie będzie się różnić

nachylenie zdjęć eliminuje się wykonując transformację rzutową

Kiedy stosuje się rektyfikację zdjęcia metodą przekształcenia rzutowego?

Gdy teren jest płaski lub prawie płaski to do rektyfikacji stosuje się przekształcenie rzutowe

( powoduje ono doprowadzenie zdjęcia do pionowości)

Nachylenie zdjęcia można stosunkowo prosto wyeliminować poprzez przekształcenie zdjęcia metodą transformacji rzutowej (przekształcenia rzutowego). W tym celu należy znać na zdjęciu i mapie cztery pary homologicznych punktów dostosowania. Po wykonaniu takiego przetworzenia, nowe, przetworzone zdjęcie możemy traktować jako ściśle pionowe i obarczone wpływem jedynie błędów deniwelacji terenu

29. Jakie dane potrzebne są do ortorektyfikacji zdjęcia lotniczego?

Ortorektyfikacja uwzględnia rzeźbę terenu

Zdjęcie lotnicze

metryka kalibracji kamery (do wykonania orientacji wewnętrznej)

-elementy orientacji wewnętrznej

-współrzędne znaczków tłowych

elementy orientacji zewnętrznej zdjęcia (lub wyznaczenie elementów orientacji zewnętrznej na podstawie minimum 3 fotopunktów o znanych x,y,X,Y,Z za pomocą równania kolinearności)

Numeryczny Model Terenu -umożliwiający określenie wysokości dowolnego punktu pomierzonego na zdjęciu

Co to jest powtórne przepróbkowanie obrazu cyfrowego?

Ortorektyfikacja polega na cyfrowym przesunięciu każdego piksela (w oparciu o NMT) do nowego - poprawnego położenia na obrazie cyfrowym.

Powtórne przepróbkowanie: obliczenie współrzędnych pikselowych na nowym obrazie (powstałym np. poprzez przeskalowanie) dla poszczególnych pikseli i przyporządkowanie im jasności poprzez interpolacje w odniesieniu do obrazu pierwotnego.

interpolacja jasności przemieszczonych pikseli:

metoda najbliższego sąsiada (slajd 9 wykład 6 i 7)

metoda biliniowa (slajd 10 wykład 6 i 7)

bikubiczna

Dlaczego podczas rektyfikacji zdjęć konieczne jest powtórne przepróbkowanie?

W czasie rektyfikacji zdjęć eliminuje się błędy odwzorowania

każdy piksel jest przesuwany do nowego poprawnego położenia

powtórne przepróbkowanie: celem jest wygenerowanie obrazu o nowej geometrii,

powtórne przepróbkowanie jest konieczne gdyż muszą zostać przy tym wyinterpolowane wartości jasności pikseli ponieważ występują puste miejsca po zmianie polożenia pikseli

Czym różni się ortoobraz od ortofotomapy? (definicje wg aneksu nr 1 do instrukcji G-5)

Ortoobraz (definicja wg aneksu nr 1 do instrukcji G-5) (inaczej aerofotografia cyfrowa): rastrowo zapisany obraz powierzchni terenu przetworzony różniczkowo z obrazów źródłowych do postaci kartometrycznej, w którym zostały wyeliminowane zniekształcenia spowodowane nachyleniem zdjęcia i deniwelacją terenu,

Ortoobraz to wynik ortorektyfikacji przeprowadzonej dla pojedynczego zdjęcia (obrazu); także ortofotografia,

Ortoobraz - takie przedstawienie powierzchni terenu, którego każdy punkt wygląda tak, jak gdyby obserwator patrzył na niego z dalekiej odległości, wzdłuż linii prostopadłej (ortogonalnej) do powierzchni terenu, Tak przetworzone zdjęcie lub obraz satelitarny jest produktem kartometrycznym, pozbawionym poważniejszych zniekształceń geometrycznych

Ortofotomapa jest mapą opracowaną na podstawie ortoobrazu lub ortoobrazów,

spełnia następujące kryteria: wykonana jest w określonym odwzorowaniu

kartograficznym, gwarantuje odpowiednią dla skali dokładność sytuacyjną dobrze

identyfikowanych elementów treści, zachowuje ustalony krój arkuszowy,

posiada siatkę kartograficzną i kilometrową, ramkę, opis pozaramkowy oraz

opcjonalnie elementy uzupełniające w tym warstwice.

Ortofotomapa cyfrowa powstaje z jednej lub kilku połączonych ortofotografii (ortoobrazów) w określonym odwzorowaniu kartograficznym i ustalonym kroju arkuszowym, uzupelniona o informacje georeferencyjne, definiujące położenie ortofotomapy w przyjętym układzie współrzędnych, Ortofotomapa cyfrowa jest to plik rastrowy, rastrowo-wektorowy lub zbiór plików (rastrowych, wektorowych, tekstowych) , w których są zapisane: treść obrazowa, ramka wraz z opisem, georeferencje oraz opcjonalnie elementy uzupełniające

różnice: ortofotomapa ma podziała sekcyjny, nazewnictwo, skale

Jak są odwzorowane budynki na ortofotomapie i dlaczego?

Budynki mają przesunięcia radialne na ortofotomapie, bo jest przekształcenie obrazu względem powierzchni terenu a nie obiektów nadpowierzchniowych.

Wysokości np. dachów budynków nie są uwzględnione, a więc są one zniekształcone, ponieważ dla dachów skala jest większa niż dla przyziemia

Czym różni się prawdziwa ortofotomapa od klasycznej?

Ortofotomapa klasyczna: mapa fotograficzna na której obrazy obiektów położonych na terenie są zrektyfikowane do położenia ortogonalnego. Powstaje na skutek przekształcenia obrazu względem powierzchni terenu.

wystarczająca dla terenów niezurbanizowanych, obszarów o niskiej zabudowie, w miastach w dużych skalach jest nieczytelna- wiele obszarów jest zakrytych, poprzez występowanie dużych zniekształceń radialnych zwłaszcza dla wysokich budynków.

Prawdziwa ortofotomapa- true orto- mapa fotograficzna na której obrazy wszystkich lub wybranych obiektów są zrektyfikowane do położenia ortogonalnego. Uwzględnia więc wysokości pokrycia terenu. pozbawiona wad dotyczących ortofotomapy klasycznej, jej opracowanie jest przez to pracochłonne i kosztowne

W praktyce true orto wykonuje się tylko dla budynków pozostawiając inne elementy pokrycia/ użytkowania terenu do ortorektyfikacji klasycznej.

Ortofotomapa jest wykorzystywana w Polsce m. in. do tworzenia bazy działek rolnych. Dla tych celów stosuje się dwa standardy opracowania. Czym różnią się te standardy? Jak i dlaczego podzielono obszar Polski na dwie strefy?

Standard ortofotomapy

Wymaga się, aby skala ortofotomapy odpowiadała skali prowadzonej mapy ewidencyjnej. Ogólne zalecenia sformułowane w rozporządzeniu Rady Europy nr 1593/2000 z 17 lipca 2000 r. określają minimalne wymagania, jakim odpowiadać ma ortofotomapa. Są to:

piksel terenowy ortofotomapy < 1,0 m;

błąd położenia sytuacyjnego (błąd średni) mp < 2,5 m.

W Polsce występuje zróżnicowane rozdrobnienie struktury działek rolnych. Ma to odbicie w dokładności mapy ewidencyjnej, która dla większości obszaru Polski prowadzona jest w skali 1:5000. Wszędzie tam ortofotomapa powinna mieć parametry zbliżone lub nieco lepsze od zalecanych przez UE.

W południowo-wschodniej części kraju występuje silne rozdrobnienie struktury działek. Dlatego prowadzi się tam mapę ewidencyjną w większych skalach: 1:2880 (w byłym zaborze austriackim) oraz 1:2000. Na tych obszarach rozpoczęto modernizację ewidencji z przejściem na numeryczną mapę ewidencyjną w skali 1:2000 i takiej skali powinna odpowiadać ortofotomapa.

Biorąc pod uwagę powyższe uwarunkowania, proponuje się dwa standardy ortofotomapy dla Polski:

Standard I: (dla północy kraju)

piksel terenowy ortofotomapy 0,5-1,0 m

błąd położenia sytuacyjnego mp = 1,5-2,5 m

Standard II: (dla południa kraju)

piksel terenowy ortofotomapy 0,25 m

błąd położenia sytuacyjnego mp = 0,75 m

Standardy różnią się więc rozdzielczością geometryczną jak i błędem położenia sytuacyjnego

Polska ma prawie pełne pokrycie zdjęciami lotniczymi w skali 1:26 000 wykonanymi w latach 1995-99 w ramach projektu PHARE. Zdjęcia takie - pod względem parametrów technicznych - stanowią idealny materiał źródłowy dla wytworzenia ortofotomapy wg standardu I. Dla standardu II wymagana skala to 1:13 000 - dla obszaru południa kraju.

Co to jest osnowa fotogrametryczna i jak się dzieli? (slajd 11 wykład 4 i 5)

Osnowę fotogrametryczną tworzy zbiór punktów o określonych współrzędnych, zidentyfikowanych w terenie i na zdjęciu lotniczym. Służy ona do zorientowania zdjęć lotniczych w przyjętym układzie współrzędnych i układzie wysokości.

Osnowa fotogrametryczna dzieli się na polową i kameralną.

Polowa osnowa fotogrametryczna powinna być zakładana w zależności od potrzeb jako:

a) pełna osnowa fotogrametryczna tak, aby każdy stereogram był uzbrojony w minimum 4 fotopunkty o współrzędnych x, y, z,

b) niepełna osnowa fotogrametryczna tylko w zakresie niezbędnym dla opracowania aerotriangulacji.

Kameralna osnowa fotogrametryczna jako zagęszczeniem osnowy polowej wykonywana jest w następujących etapach:

a) projekt aerotriangulacji,

b) obserwacje aerotriangulacji,

c) obliczenie aerotriangulacji.

Do czego służy i na czym polega aerotriangulacja? (slajdy 3-10 wykład 4 i 5)

Aerotriangulacja to wyrównanie sieci przestrzennej złożonej ze zbioru punktów wiążących i fotopunktów, służy do uzgodnienia współrzędnych terenowych punktów wiążących oraz wyznaczanie elementów orientacji zewnętrznej zdjęć. Aerotriangulacja służy więc do orientacji wzajemnej i bezwzględnej modeli.

Rodzaje aerotriangulacji: ( slajd 3 wykład 4 i 5)

analogowa: fototriangulacja płaska, przestrzenna na autografach

analityczna: metoda niezależnych wiązek, metoda niezależnych modeli

cyfrowa: metoda niezależnych wiązek, metoda niezależnych modeli

orientacja wzajemna pary zdjęć: rekonstrukcja wzajemnego położenia zdjęć, promienie homologiczne przecinają się tworząc fotogrametryczny model rzeczywistości, model nie posiada georeferencji, układ modelu: lewe zdjęcie, baza, do wyznaczenia orientacji wzajemnej pomiar współrzędnych co najmniej 5 fotopunktów w rejonach grubera, do tej orientacji wykorzystywane punkty to PUNKTY WIĄŻĄCE

orientacja bezwzględna: nadanie modelowi georeferencji, przestrzenny obrót i przeskalowanie tak by model był umiejscowiony w terenowym układzie współrzędnych, WYKORZYSTYWANE FOTOPUNKTY

Ile jest niewiadomych w pojedynczym równaniu kolinearności (dla współrzędnych x i y) ułożonym dla pomierzonego na zdjęciu fotopunktu, a ile dla punktu wiążącego (tylko pomiar współrzędnych tłowych-osnowa kameralna)? Wymienić niewiadome

Dla fotopunktu- 6 niewiadomych- elementy orientacji zewnętrznej

Dla punktów wiążących- 9 niewiadomcyh - elementy orientacji zewnętrznej zdjęcia +X,Y,Z terenowe dla punktu wiążącego

Porównaj zasady działania dwu najważniejszych typów cyfrowych kamer lotniczych

typy cyfrowych kamer lotniczych: modułowe i linijkowe

Zasada obrazowania lotniczej kamery cyfrowej, opartej na koncepcji skanera elektrooptycznego. Obrazowanie w zakresie panchromatycznym realizowane jest przez trzy linijki rejestrujące nadirowo, wstecz oraz w przód i daje pokrycie stereoskopowe. Ponadto nadirowo rejestruje się obraz w zakresie RGB i w IR.

Zasada obrazowania lotniczą cyfrową kamerą modułową. Kamera składa się z czterech kamer - modułów panchromatycznych, obrazujących teren z niewielkim pokryciem. Zasięg obrazów panchromatycznych pokrywa się z zasięgiem dodatkowych kamer obrazujących w zakresie RGB i IR. W procesie obróbki w oprogramowaniu kamery generowany jest jeden obraz - rzut środkowy z obrazów składowych

40) Co nazywamy Numerycznym Modelem Terenu? Podaj i krótko omów sposoby pozyskiwania danych do NMT.

NMT to numeryczna reprezentacja powierzchni terenowej utworzonej przez zbiór punktów (określonych współrzędnymi X,Y,Z) tej powierzchni wraz z algorytmem interpolującym, pozwalającym na określenie kształtu tej powierzchni bądź wysokości pojedynczych punktów. Najczęściej NMT tworzony jest w postaci regularnej siatki kwadratów (GRID) lub w postaci nieregularnej siatki trójkątów (TIN).

Źródła danych dla NMT - metody pozyskiwania:

Bezpośrednie pomiary terenowe

1. Pomiary GPS referencyjnym

2. Naziemny skaning laserowy

3. Tradycyjne pomiary geodezyjne

Zalety - bardzo duża dokładność i swobodny dobór rozdzielczości

Wady - czasochłonność i wysoki koszt pomiaru

Zastosowanie - niewielkie obszary dla których istotna jest wysoka dokładność danych np.: ocena dynamiki erozji gleb, pomiary niewielkich form terenu, modele budynków itp.

Fotogrametryczna - pomiar na zestrojonym modelu stereoskopowym utworzonym ze zdjęć lotniczych sposobem:

manualnym,

manualnym, wspomaganym automatycznym korelatorem obrazu oraz automatycznym.

Zalety - wysoka dokładność, wysoka efektywność, łatwa powtarzalność

Wady - wysoka cena, brak penetracji pokrywy roślinnej, zależność od warunków pogodowych, drogie oprogramowanie/sprzęt

Zastosowanie - tam gdzie liczy się dokładność i powtarzalność pomiaru np.: rejestracja zmian rzeźby kopalni odkrywkowych

Kartograficzna - pomiar na mapach topograficznych drogą digitalizacji lub skanowania i wektoryzacji warstwic

Zalety - dobra dostępność materiałów źródłowych, pokrycie całego kraju, wysoka dokładność, najlepszy stosunek ceny do dokładności; prostota tworzenia; otrzymujemy model rzeźby terenu (bez budynków, lasów itp.)

Wady - zróżnicowana jakość materiałów źródłowych; duża pracochłonność

Zastosowanie - średniopowierzchniowe obszary wymagające stosunkowo wysokiej dokładności

Lotniczy skaning laserowy - LIDAR - light detection and ranking

Zalety - wysoka dokładność; bardzo krótki cykl produkcji; sensor aktywny - niezależność od warunków pogodowych; rejestracja wielokrotnego odbicia = penetracja pokrywy roślinnej

Wady - bardzo wysoki koszt, wymagany specjalistyczny sprzęt

Zastosowanie - tam gdzie wymagana jest wysoka dokładność i szybkość uzyskania modelu np. ocena skutków zdarzeń katastrofalnych

Interferometria radarowa - InSAR

Zalety - system aktywny (niezależność od warunków pogodowych), zdolność częściowej penetracji pokrycia terenu oraz wody

Wady - wysoki koszt, zróżnicowana dokładność (samolot 1-5m, satelita 5-50m)

Zastosowanie - modelowanie terenów pokrytych bujną roślinnością, śniegiem, lodem, monitorowanie rozwoju linii brzegowych

41) Metody wykorzystywane w automatyzacji fotogrametrycznego pozyskiwania danych do NMT

Matching - dopasowanie: szukanie punktów odpowiadających sobie na różnych obrazach.

Metody:

Area Based Matching (np. korelacja krzyżowa)

Feature Based Matching (dopasowanie po cechach)

Relational Matching (porównuje cechy topologiczne)

42. Jaką rolę spełnia technologia GPS/INS w procesie aerotriangulacji? Jakie dane uzyskujemy z tej technologii do opracowań fotogrametrycznych?

GPS-system pozycyjny

Ins-system nawigacyjny

-pomiar fotopunktow terenowych

-wyznaczenie środków rzutów, oraz orientacji kątowej zdjęc wykonywanych z samolotów

System pozycyjny i nawigacyjny GPS i INS wykorzystywany jest w celu określenia położenia i orientacji platformy.

Połączenie danych pozyskanych z dalmierza laserowego oraz GPS i INS pozwala na wygenerowanie trójwymiarowej, gęstej chmury punktów o znanych współrzędnych terenowych - X,Y,Z. Trajektoria lotu samolotu wyznaczana jest poprzez system GPS, z wykorzystaniem pomiaru różnicowego dGPS. Polega ona na użyciu naziemnej stacji zwanej referencyjną ustawioną nad punktem o znanych współrzędnych. Stacja ta wylicza wektor błędu będący różnicą między współrzędnymi znanymi a wyliczonymi. Informacje te są następnie przesyłane do odbiornika GPS znajdującego się na pokładzie lecącego samolotu, który dokonuje korekcji swojego położenia. W rezultacie położenie skanera laserowego znajdującego się na pokładzie, może zostać wyznaczona z dokładnością nie gorszą niż 10 cm. System INS (inercyjny system nawigacyjny) wyznacza pozycję, prędkość, orientację oraz prędkości kątowe platformy skanującej (samolotu, helikoptera) mierząc liniowe i kątowe przyspieszenia wzdłuż trzech osi platformy, która jest w ruchu. System składa się z układu bardzo czułych giroskopów i akcelerometrów, które określają aktualny stan w jakim znajduje się system. Giroskopy określają kąty nachylenia platformy, natomiast akcelerometry wyznaczają jej prędkości w każdym z kierunków. Integrując działanie tych urządzeń system INS jest w stanie wyznaczyć trajektorie samolotu z błędem poniżej 2 cm oraz kąty nachylenia urządzenia skanującego. Systemy GPS i INS charakteryzują się różną i komplementarną propagacją błędów co daje zalety obu systemów: stabilność pomiaru GPS oraz precyzję INS. INS dostarcza danych chwilowych, które zostają skorygowane na podstawie informacji pozyskanych z GPS eliminując skumulowane błędy co w rezultacie zapewniają utrzymanie dokładności wyznaczenia trajektorii lotu na poziomie 2 cm.

Dane pozyskiwane w trakcie misji skaningu laserowego to:

- dane ze stacji referencyjnych GPS,

- dane o parametrach lotu,

- dane o skanowanej powierzchni pozyskane ze skanera laserowego

43) Jakie parametry charakteryzują obraz cyfrowy?

Rozdzielczość geometryczna (przestrzenna) - Wielkość boku elementarnej powierzchni obrazu (piksela) odwzorowana w terenie.

Rozdzielczość radiometryczna - Liczba rozróżnialnych poziomów promieniowania, a więc liczba bitów, na jakie podzielono zakres jaskrawości, np.: 8 bitów =256 poziomów /TM/.

Zakres i rozdzielczość spektralna - zakres długości fal promieniowania elektromagnetycznego rejestrowany przez dany sensor. Ilość kanałów selektywnie rejestrujących p.e.m.

Rozdzielczość czasowa - powtarzalność wykonywania w dniach

Histogram - wykres zależności ilości pikseli od ich jasności [opisany w kolejnych pytaniach]

44) Wyjaśnij, dlaczego do batymetrycznego skaningu laserowego nie wykorzystuje się laserów pracujących na bliskiej podczerwieni.

Skaning batymetryczny dotyczy głębokości i dna jeziora/morza, a woda pochłania promieniowanie bliskiej podczerwieni (700-1000nm) - innymi słowy powierzchnia oceanu jest czarna w tym zakresie widmowym.

45) Scharakteryzuj dokładność lotniczego skaningu laserowego.

Dokładność wysokościowa większa, ponieważ w niewielkim stopniu uzależniona od wysokości lotu.

Dokładność sytuacyjna niższa, w dużym stopniu zależy od wysokości lotu- plamka lasera tym większa im wyżej leci samolot (rozbieżność wiązki lasera)

Dokładność instrumentu laserowego: 2 - 5 cm

Dokładność GPS (przy założeniu właściwych stacji naziemnych i poprawnym rozmieszczeniu satelitów) : 5 - 7cm

Ostateczna dokładność wysokościowa danych jest uzależniona od wielu czynników (m.in. wysokości lotu). Dla większości systemów nie spada poniżej ±15 cm dla Wlotu < 1000 m.

Ostateczna dokładność sytuacyjna: 1/10000 Wlotu

46) Od czego zależy dokładność NMT ?

Dokładność NMT określa średni błąd wyinterpolowanych z niego wysokości terenowych. Wielkość tego błędu zależy głównie od:

Błędów danych źródłowych , dokładności, z jaką pomierzono pierwotne punkty siatki,

Wielkości oczka siatki - gęstość punktów,

Ukształtowania powierzchni terenu i stopnia jej pokrycia,

Metody interpolacji.

mNMT2= mZ2 + (α*d)2

mNMT - średni błąd wyinterpolowanej wysokości z NMT;

mZ - średni błąd określenia wysokości;

α - współczynnik opisujący charakter rzeźby terenu;

d - średnia odległość punktów pomiarowych

47) Dane jest zdjęcie cyfrowe o rozdzielczości 1200dpi, rozmiarze 230x230mm. Oblicz wielkość pliku z danymi dla obrazu panchromatycznego i barwnego.

Dpi-Ilość pikseli przypadająca na cal

1 cal-2,54 cm

1200/2,6=472,4 piksele/cm

(472,48*23)^2 ?????????

48) Co to jest histogram obrazu cyfrowego? Co z niego można odczytać? Wymień najważniejsze działania na histogramie.

Histogram obrazu cyfrowego - statystyczny rozkład jasności pikseli, przedstawiany zazwyczaj w sposób graficzny. Wykres zależności ilości pikseli od ich jasności.

Możemy odczytać:

Działania na histogramie:

Normalizacja (rozciągnięcie histogramu)

Obraz (1) zarejestrowany na małym zakresie jasności zostaje przeniesiony na obraz (2) z liniowym rozciągnięciem jasności.

Wyrównujące rozciągnięcie histogramu- takie przekształcenie jasności poszczególnych pikseli, aby ilość pikseli o jasności leżącej w każdym z równych przedziałów histogramu była w przybliżeniu taka sama.

Przekształcenie obrazu według funkcji

Dobór funkcji decyduje o skutku

Progowanie- podział obrazu na obraz binarny (zero-jedynkowy) według ustalonego przepisu przyporządkowania pikseli, np. dla jasności g>125 →1 (jasne); g<125→1 (ciemne)

49) Co to są okna atmosferyczne? Wymień najważniejsze.

Teledetekcja nie wykorzystuje całego spektrum lecz te jego podzakresy, w których pochłanianie promieniowania przez atmosferę jest niewielkie. Podzakresy spektrum przepuszczane przez atmosferę są określane jako okna atmosferyczne.

Okna atmosferyczne

1. promieniowanie widzialne (światło) - fale o długości: 0,4 -0,7 µm,

2. krótkofalowe promieniowanie podczerwone (podczerwień fotograficzna): 0,7-1,5 µm,

3. podczerwień środkowa: 3,0 - 5,0 µm,

4. podczerwień długofalowa (termalna): 8 -12 µm,

5. promieniowanie mikrofalowe:1-100 cm,

6. promieniowanie radiowe > 1 m

Zakres fal o długościach 0,3-12 µm jest nazywany widmem optycznym.

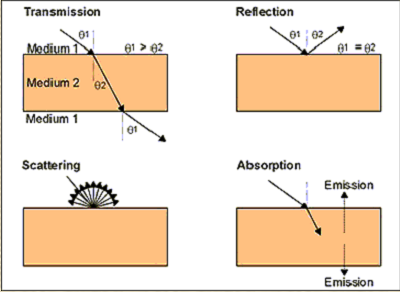

50) Interakcja promieniowania elektromagnetycznego z obiektem.

Promieniowanie elektromagnetyczne Q (każda energia) padające na obiekt jest w części:

przepuszczana - transmisja T

odbijana - refleksja R

rozpraszana - S

pochłaniana - absorpcja A

Q = T + R + S + A

Interakcja obiektu:

Q'= R + S + E

Q' - promieniowanie

odbijane i emitowane

51) Jakie typy orbit spotykane są dla satelitów meteorologicznych a jakie dla gospodarczych?

Satelity meteorologiczne - wysoka orbita geostacjonarna (METEOSAT - 36 000 km) [opis niżej]

Satelity gospodarcze - orbita heliosynchroniczna.

Płaszczyzna orbity heliosynchronicznej tworzy stały kąt z kierunkiem na Słońce. W stosunku do punktu równonocy wiosennej płaszczyzna takiej orbity obraca się o 360º/365 dni czyli około 1º na dobę. /rysunek/

52) Czym różnią się satelity geostacjonarne od okołobiegunowych?

Satelity geostacjonarne - „Wisza” nieruchomo nad jednym punktem równika Ziemi; orbita geostacjonarna - orbita kołowa w płaszczyźnie równika, przebiega na wysokości ok. 36 tys. km

Satelity okołobiegunowe - Umieszczane na niskich orbitach (500-1500 km), nachylonych pod dużym kątem w stosunku do płaszczyzny równika. Ruch zwykle zsynchronizowany z pozornym ruchem Słońca, co oznacza, że w trakcie swego obiegu dookoła Ziemi satelita zajmuje takie samo położenie w stosunku do Słońca.

53) Porównać rozdzielczość geometryczną i spektralną systemu Landsat i systemów wysokorozdzielczych (ogólnie).

Systemy wysoko rozdzielcze -

najwyższa rozdzielczość geometryczna dla kanału panchromatycznego < 1 m;

IKONOS - od 4,0 m do 1,0 m

Quickbird - od 2,5 m do 0, 61 m

IRS - od 23,5 m do 5,8 m

Landsat 7 - najwyższa rozdzielczość dla kanału panchromatycznego 15m, termalnego 60m, pozostałe 30m.

54) Porównać system SPOT do systemu Landsat

LANDSAT

- satelita gospodarczy

- rozdzielczość geometryczna: kanały o rozdzielczości 30m

Landsat 7 ETM +: kanał panchromatyczny o rozmiarze piksela 15 m, termalny 60m

- rozdzielczość czasowa: 16 dni

- rozdzielczość spektralna: Landsat 1- 5 po 7 kanałów, Landsat 7 - 8 kanałów

- wysokość orbity 705 km, czas obiegu ok. 100 min

SPOT

- satelita gospodarczy

- rozdzielczość geometryczna: kanały spektralne 20 m, kanał panchromatyczny 10 m,

- rozdzielczość czasowa: 26 dni

- rozdzielczość spektralna 3+1

- wysokość orbity 832 km, czas obiegu ok. 101 min

- szerokość pasa obrazowania 60 km

- nowość w stosunku do Landsata - skaner wykonuje obrazy nadirowi co pozwala obserwować wybrane obrazy Ziemi co kilka dni i daje możliwość tworzenia obrazów stereoskopowych

55) Wymień metody ekstrakcji tematycznej z obrazów wielospektralnych.

kompozycje barwne (KB)

KB stanowią efekt scalenia zapisu cyfrowego z trzech kanałów spektralnych w jeden barwny obraz. Procedura ta służy do wykrycia i uwypuklenia, istotnej dla interpretatora informacji tematycznej, której często nie zawierają pojedyncze wyciągi spektralne. Do projekcji KB wykorzystuje się ideę addytywnej syntezy barw podstawowych: czerwonej, zielonej i niebieskiej, czyli tzw. system RGB. Każdy piksel KB jest wyświetlany na ekranie monitora w kolorze odpowiadającym udziałowi trzech barw RGB, proporcjonalnie do jasności pikseli w kanałach, z których tworzona jest kompozycja.

obliczanie wskaźników ilościowych:

wagowanie międzykanałowe (indeksy wegetacji RVI, NDVI)

albedo [opis w pytaniu nizej]

temperatura radiacyjna

Wagowanie międzykanałowe - sprowadza się do obliczenia dla każdego piksela stosunku jasności spektralnych dla dwóch lub większej liczby kanałów. Do najpowszechniej stosowanych w badaniach przyrodniczych należą formuły tzw. wskaźników roślinności (indeksów wegetacji). Wagowanie jest stosowane również dla usuwania wpływu topografii terenu, zminimalizowania wpływu roślinności na odwzorowanie innych elementów itd..

Temperatura radiacyjna to taka temperatura ciała doskonale czarnego, dla której całkowita zdolność emisyjna jest równa całkowitej zdolności absorpcyjnej badanego ciała.

klasyfikacja danych wielospektralnych - technika ilościowej analizy obrazów cyfrowych, wykorzystywana do automatycznego kartowania tematycznego, czyli generowania cyfrowych map tematycznych (np. użytkowania terenu, stanu i zmian środowiska przyrodniczego itp.) polega na wykorzystaniu zróżnicowania odbicia spektralnego przez obiekty terenowe, zarejestrowanego na obrazach wielospektralnych, do opracowanie mapy tematycznej; najczęściej jest to mapa użytkowania Ziemi.

Metody: Parametryczne - interpretacja fizyczna odbicia spektralnego, jasności w kanałach mają interpretację fizyczną, oprócz obrazów wykorzystuje się krzywe spektralne (pomiar przy pomocy spektrometru), szuka się korelacji jasności spektralnych w kanałach z wartościami pokazanymi na krzywej spektralnej.

Nieparametryczne - jasności pikseli na obrazie traktuje się jak liczby niemianowane, wykorzystuje się sam fakt ich wzajemnego zróżnicowania; metoda wymaga wspomagania wiedzą operatora

Klasyfikacja nienadzorowana

Klasyfikacja nadzorowana

integracja danych teledetekcyjnych - metody i algorytmy podwyższania rozdzielczości przestrzennej (geometrycznej) obrazów wielospektralnych przy wykorzystaniu obrazów panchromatycznych

transformacja IHS

56) Co to jest indeks wegetacji i jakie ma zastosowanie?

Ocena stanu roślinności. Wskaźnik roślinności (indeks wegetacji) wykorzystuje się kanały czerwony (RED) i podczerwony (NIR), ponieważ pomiędzy tymi kanałami zachodzi największe zróżnicowanie odbicia promieniowania dla roślinności. Obraz indeksu wegetacji interpretujemy jako wskaźnik biomasy: im wyższa jego wartość, tym większa ilość biomasy. Indeks wegetacji jest sztucznym obrazem powstałym przez dzielenie wybranych kanałów spektralnych. Istnieje wiele indeksów, dwa najpopularniejsze to:

-Ratio Vegetation Index RVI=NIR/RED

-NDVI Normalized Difference Vegetation Index NDVI=(NIR-RED)/(NIR+RED)

57) Czy indeks wegetacji można określić na podstawie obrazów wysokorozdzielczych (np.IKONOS, QuickBird)? Odpowiedź uzasadnić.

Tak, ponieważ odbierają wśród kanałów obrazu jest czerwony i podczerwony.

IKONOS: kanał 3 (czerwony) 0.63 - 0.70 µm; kanał 4 (bliska podczerwnień) 0.76 - 0.85 µm.

QuickBird: kanał czerwony 0.63 - 0.69 µm; kanał bliski -IR 0.76 - 0.90 µm

58) Co to jest albedo? Od czego zależy?

Ta część promieniowania słonecznego, która podlega odbiciu jest nazywana albedo Ziemi i wynosi średnio 30%. Albedo (z łac. „białość”) definiowane jest jako stosunek promieniowania odbitego do całkowitego padającego na daną powierzchnię. Jest parametrem określającym zdolność odbijania promieniowania słonecznego przez daną powierzchnię. Albedo może przyjmować wartości od 0 (co oznacza brak odbicia) do 1 (całe padające promieniowanie jest odbijane). Może być również wyrażone w %.

Zależy od:

- natężenia całkowitego promieniowania słonecznego

- charakteru powierzchni odbijającej, jej barwy, szorstkości, zawartości wilgoci

- kąta padania promieni słonecznych

- wysokość słońca nad horyzontem (odległość źródła światła od obiektu)

59) Co to jest krzywa spektralna? Jaki jest jej związek z albedo?

Krzywa spektralna danego piksela dla fal widzialnych i bliskiej podczerwieni przedstawia zależność współczynnika odbicia od długości fali, a dla podczerwieni termalnej zależność współczynnika emisyjności od długości fali. Inaczej to stosunek promieniowania odbitego od powierzchni obiektu do promieniowania padającego w danym zakresie spektralnym.

Związek z albedo jest taki, że jedna oś dla wykresu krzywej to albedo.

60. Jaki rodzaj temperatury można wyznaczyć na podstawie obrazu satelitarnego, jakim

kanałem spektralnym musimy dysponować?

Możemy wyznaczyć temperaturę radiacyjną. Musimy dysponować kanałem termalnym.

Do ilościowego scharakteryzowania promieniowania cieplnego służy spektralna zdolność emisyjna ε, natomiast zdolność ciała do pochłaniania padającego na nie promieniowania jest charakteryzowana przez jego spektralną zdolność absorpcyjną A. Obydwie zdolności zależą od natury ciała, jego temperatury i rodzaju promieniowania (długości fali). Na podstawie rejestracji zdolności emisyjnej badanego ciała (a ściślej -jego powierzchni) można wyliczyć temperaturę radiacyjną powierzchni, czyli temperaturę promieniowania przez nią emitowanego, jaka ustala się w wyniku równowagi pomiędzy promieniowaniem padającym na powierzchnię a promieniowaniem przez nią emitowanym

T -temperatura radiacyjna,

Trzecz-temperatura rzeczywista,

A -zdolność absorpcyjna

Temperaturę radiacyjną oblicza się w oparciu o znajomość luminancji, wyznaczonej na podstawie DN zarejestrowanego przez radiometr satelity (np. obrazu w kanale termalnym)

61. Wymienić czynniki zakłócające radiometrię:

Atmosfera: rozpraszanie promieniowania w atmosferze - wpływ atmosfery i aerozoli w niej zawartych;

Geometria rejestracji

•Zmiany w relacji pomiędzy kątem widzenie skanera i kątem padania promieni słonecznych •Wpływ topografii terenu •Zmienność oświetlenia wzdłuż toru lotu satelity, • Zmienność kąta widzenia w poprzek linii skanowania, •Zmiany w orientacji platformy urządzeń rejestracyjnych w czasie skanowania, •Obserwacje kątowe,

Instrument: Wpływ nieidealności detektorów sensora; Błędy w transmisji danych.

Ważniejsze przyczyny zniekształcenia radiometrycznego

:•rozpraszanie promieniowania w atmosferze

•wpływ kąta padania promieni słonecznych

•wpływ topografii terenu

•błędy instrumentalne

62. Co składa się na korekcję radiometryczną obrazów teledetekcyjnych?

•radiometryczne zniekształcenia obrazów-zniekształcenia wartości sygnału powodujące zmianę jasności pikseli obrazu•

Usunięcie czynników zakłócających oraz kalibracja detektorów.

Błędy instrumentalne

spowodowane są przez niedoskonałość detektorów - gdy naraz rejestruje kilka detektorów (np. linijka detektorów) -przy tym samym natężeniu promieniowania mogą dać nieco inny sygnał

błąd ten nosi nazwę„striping”-a usunięcie jego wpływu „destriping”

63. Na czym polega kalibracja detektorów?

Mierzona energia przez detektory jest kodowana w pewnym zakresie liczbowym (najczęściej 0-255), wartości te są niemianowane, określane jako jasności spektralne - DN. Konieczne jest przeliczenie DN na luminancję energetyczną (spektralną) z jednoczesnym usunięciem błędów systematycznych.

Kalibracja jest więc ustaleniem wartości luminacji max i min zbieranej przez detektor oraz ustaleniem rozdzielczości radiometrcznej

64. W jakim zakresie spektralnym powstaje obrazowanie radarowe, czy na intensywność mierzonego echa ma wpływ promieniowanie słoneczne i promieniowanie własne Ziemi? Odpowiedź uzasadnić.

Obrazowanie radarowe powstaje w promieniowaniu mikrofalowym 1mm-1m.

Radar jest systemem aktywnym - tzn. antena kierunkowa wysyła wiązkę fal radiowych, zaś odbiornik radiowy wychwytuje fale odbite. Ważną cechą radaru jest niezależność od oświetlenia słonecznego (pory dnia czy nocy); fale radarowe łatwo przenikają przez chmury i zanieczyszczenia atmosfery - niezależność od warunków pogodowych. Jest to szczególnie ważne przy badaniach oceanów. Radary wykorzystujące długie fale stwarzają możliwość rozpoznania podpowierzchniowego. Wykorzystuje się także radary do penetracji chmur, mgieł, zanieczyszczeń atmosfery, badań stanu powierzchni wód i oceanów, prądów morskich, analizy pokrywy lodowej i śnieżnej.

65. Na czym polega zasada działania systemu InSAR, do czego służy?

Metoda wykorzystująca wzajemne przesunięcia fazy sygnału dwóch zdjęć SAR tego samego obiektu. W oparciu o różnice fazy odpowiadających sobie sygnałów radarowych z dwóch kolejnych zdjęć uzyskuje się informacje o wartościach względnych wysokości powierzchni terenu lub jej zmianach w czasie.

66. Jak powstaje interferogram?

Powstaje na skutek nałożenia obrazów faz dla deóch obrazów radaorowych

Interferogram składa się z prążek interferencyjnych, gdzie za pomocą barwy lub tonu szarości ilustrowana jest różnica faz w zakresie 0-2Π

Istotą interferometrii radarowej InSAR (ang.: Interferometric SAR) jest odbiór ech radarowych niezależnie przez dwie anteny. Z uzyskanych w ten sposób dwóch obrazów radarowych, w których każdy piksel zawiera informacje o amplitudzie i fazie zarejestrowanego echa, tworzy się interferogram zawierający różnice faz odpowiadających sobie pikseli obu obrazów. Taki interferogram zawiera informacje przestrzenne o obiekcie, może więc być podstawą do pomiarów wysokościowych i budowy Numerycznego Modelu Rzeźby Terenu.

67. Co to jest interferogram różnicowy? Jaki są jego zastosowania?

Jeśli rejestracja obrazów nastąpiła w różnym czasie ale z tej samej pozycji, wówczas teoretycznie baza poprzeczna wynosi zero, więc faza na interferogramie zależy tylko od zmian topografii terenu pomiędzy rejestracjami.

Powstaje z bazy czasowej , a nie przestrzennej.

Zastosowania: powolne przemieszczenia - osiadania budynków, analiza pojedynczych wydarzeń - np. trzęsienie ziemi,

68. Na czym polega lotniczy skaning laserowy, do czego służy?

Połączenie danych pozyskanych z dalmierza laserowego (kierunku i odległości) oraz GPS i INS pozwala na wygenerowanie trójwymiarowej, gęstej chmury punktów o znanych współrzędnych terenowych - X,Y,Z. Do stworzenia NMT i NMPT.

Zastosowania: Projektowania przebiegów dróg, torów kolejowych, wodociągów; rejestracja linii wysokiego napięcia; trójwymiarowe modele miast; pomiar mas ziemnych w kopalniach odkrywkowych; pozyskanie parametrów o roślinności;

69. Co wchodzi w skład segmentu pokładowego i naziemnego systemu ALS?

Segment lotniczy:

system pomiaru odległości: dalmierz laserowy, odbiornik

system pozycyjny GPS

system nawigacyjny INS

kamera fotogrametryczna

system planowania i zarządzania lotem

Segment naziemny:

naziemna, referencyjna stacja GPS

stacja robocza do obróbki i przetwarzania danych laserowych.

70. Jakimi systemami z punktu widzenia teledetekcji są InSAR i ALS. Porównać je

wzajemnie.

Sa systemami aktywnymi

ALS- lasery maja dużą koherencję wiązki, dużą moc;

mechanizmy skanujące - lustro wahadłowe, wielobok rotacyjny, wykorzystujący światłowody.

Wykorzystanie GPS - trajektoria lotu samolotu; dokładność położenia skanera <10cm; wykorzystanie INS - wyznaczenie pozycji, prędkości, orientacji oraz prędkości kątowe platformy skanującej. Bardzo czuły i dokładny system - < 2 cm.

Integracja GPS i INS - eliminacja błędów.

Współdziałanie skanera laserowego i kamery fotogrametrycznej - synchronizacja danych, każde zdjęcie i każda klatka zapisu video ma zarejestrowany numer i dokładny czas wykonania.

W wyniku pomiaru otrzymujemy: dane laserowe, taśmy video/zdjęcia, dane GPS z odbiornika ruchomego, dane referencyjne GPS ze stacji naziemnej.

Możliwość rejestracji kilku odbić pojedynczego impulsu;

Pomiar intensywności - wartość energii, która została odbita od danej powierzchni;

Niemożliwy pomiar gdy powierzchnia jest: czarna - wysoce absorbująca promieniowanie;

przezroczysta - wysoce transmitująca; lustrzana - wysoce odbijająca.

Niezależność od warunków oświetleniowych, pogodowych - wyj. Silny deszcz i mgła - stanowią przeszkodę. Błąd wysokościowy mz=0.15-0.25 m; krótki czas uzyskania produktu końcowego i relatywnie niski koszt; mała liczba punktów kontrolnych, wysoka gęstość danych, pomiar dla terenów z pokrywą roślinną. Impuls lasera pochłaniany przez wodę, asfalt i smołę, chmury i mgłę; duża objętość zbiorów danych. Uzyskujemy NMPT a nie NMT, dopiero po filtracji NMT. Zastosowania: patrz wyżej

InSAR - wykorzystuje radary, pomiar różnicy faz między dwoma obrazami SAR; Różne dane wejściowe i różne metody przetwarzania w zależności od celu zastosowania interferometrii radarowej. cel: generowanie NMT, wykrywanie zmian powierzchni terenu w czasie - trzęsienia ziemi, osiadania; dokładność od 0.2-0.5 m

i nie mam pojecia co jeszcze!;)

71. Na czym polega fuzja (merging, band sharpening) kanałów obrazów satelitarnych? Jak

się ją wykonuje?

w większości systemów obrazowania cywilnego regułą jest to,że rejestracja spektralna ma rozdzielczość niższą od panchromatycznej. Fuzji wykonuje się poprzez złączenie obrazu wielospektralnego o niższej rozdzielczości i obrazu panchromatycznej o wyższej.

„proces, w którym informacja wysokoprzestrzenna z jednego obrazu jest używana do zwiększenia rozdzielczości drugiego obrazu o niższej rozdzielczości wpasowanego w obraz pierwszy”.

„metody i algorytmy podwyższania rozdzielczości przestrzennej (geometrycznej) obrazów wielospektralnych przy wykorzystaniu obrazów panchromatycznych”

fuzja wykorzystuje algorytmy: PAN sharpening, -resampling obrazu barwnego do rozdzielczości PAN, -zamiana RGB na IHS (HSI)-Intensity, Hue, Saturation-model barw; -zamiana kanału I (intensywność na obaz panchromatyczny); -powrót do przestrzeni RGB.

72. Scharakteryzuj (ogólnie) satelitarne systemy wysokorozdzielcze: sensory, orbity,

zakresy i rozdzielczość spektralną, rozdzielczość geometryczną.

System |

IKONOS-2 |

QuickBird-2 |

EROS-A1 |

EROS-B |

OrbView-3 |

|||||

Wys. orbity |

681 km {98.1 stopni, zsynchronizowana ze Słońcem-heliocentryczna |

450 km {98 stopni, heliocentryczna} |

480 km {heliocentryczna} |

600 km {heliocentryczna} |

460 km {heliocentryczna} |

|||||

Typ sensora |

Linijka CCD |

Linijka CCD |

Linijka CCD |

Linijka CCD |

Linijka CCD |

|||||

Szer. pasa obrazowania |

11 km |

16,5 km |

12,7 km |

13 km |

8 km |

|||||

Rozdz. radialna |

11 bitów |

11 bitów |

11 bitów |

10 bitów |

8 bitów |

|||||

Wych. Ukł. -wzdłuż o. -w poprzek |

45° 45° |

30° 30° |

45° 45° |

45° 45° |

45° 45° |

|||||

Tryb pracy |

PAN |

MS |

PAN |

MS |

PAN |

MS |

PAN |

MS |

PAN |

MS |

Zakres spektralny |

0,45-0,90 |

4 kanały |

0,45-0,90 |

4 kanały |

0,50-0,90 |

- |

0,50-0,90 |

B; G; R; IR |

0,50-0,90 |

4 kanały |

PAN - kanał panchromatyczny {czarno biały}

MS- kanały multispektralne lub barwne {niebieski, zielony, czerwony, bliska IR}