6. W jakich przypadkach stosuje się jednoczynnikową analizę wariancji? Jakie założenia należy

sprawdzić przed użyciem tej techniki statystycznej? Podaj przykład zastosowania jednoczynnikowej

analizy wariancji.

Jednoczynnikowa analiza wariancji jest testem statystycznym służącym do porównywania średnich

w wielu populacjach. Stosujemy ją gdy chcemy ocenić czy występujące różnice są istotne

statystycznie gdy mamy jeden czynnik eksperymentalny.

Założenia:

Każda populacja musi mieć rozkład normalny

Pobrane do analizy próby są niezależne

Próby pobrane z każdej populacji muszą być losowymi próbami prostymi

Wariancje w populacjach są równe

W przypadku, gdy założenia analizy wariancji nie są spełnione należy posługiwać się testem Kruskala-

Wallisa.

Przykład z zajęć:

Zbadać czy rodzaj paszy podawany kurczakom wpływa na przyrost ich wagi.

Mamy trzy rodzaje paszy: A, B oraz C.

Plan doświadczenia: układ całkowicie losowy ( kompletnie zrandomizowany) zrównoważony, czyli

jednakowa liczba kurczaków przypisana do trzech pasz.

Czynnik doświadczalny (inaczej eksperymentalny): rodzaj paszy (A, B, C); każda pasza jest obiektem

doświadczalnym, natomiast jednostki eksperymentalne to kurczaki.

µA- średni przyrost dla paszy A

µB- średni przyrost dla paszy B

µC- średni przyrost dla paszy C

H

0

: wszystkie średnie grupowe są identyczne; µA= µB= µC

vs. H

1

: istnieje różnica w przyrostach wagi dla przynajmniej dwóch pasz

Przed zastosowaniem testu dla równości średnich w analizie wariancji konieczne jest sprawdzenie

hipotezy o równości wariancji zmiennej odpowiedzi w poszczególnych grupach. Stosujemy różne

testy do badania równości wariancji, jednak najlepszy jest test Levene'a.

Jego założenia:

δ

2

A- wariancja śr odpowiedzi dla paszy A

δ

2

B- wariancja śr odpowiedzi dla paszy B

δ

2

C- wariancja śr odpowiedzi dla paszy C

H

0

: wszystkie wariancje są identyczne

vs. H

1

: przynajmniej jedna wariancja różni się od pozostałych

Gdy p-wartość > α=0,05 to przyjmujemy hipotezę zerową, że wszystkie wariancje są równe (są

homogeniczne), czyli można stosować analizę wariancji.

Co więcej, warto również zastosować inny test dla zbadania wartości wariancji np. test Bartlett'a.

Musimy wcześniej sprawdzić normalność składnika losowego ε za pomocą testu Shapiro-Wilka.

Gdy p-wartość > α=0,05 to składniki losowe modelu są normalne (możemy zastosować test

Bartlett'a).

Gdy po zastosowaniu testu Bartlett’a (bartlett.test(przyrost~pasza) p-wartość > α=0,05 oznacza to,

że test ten także potwierdził jednorodność wariancji.

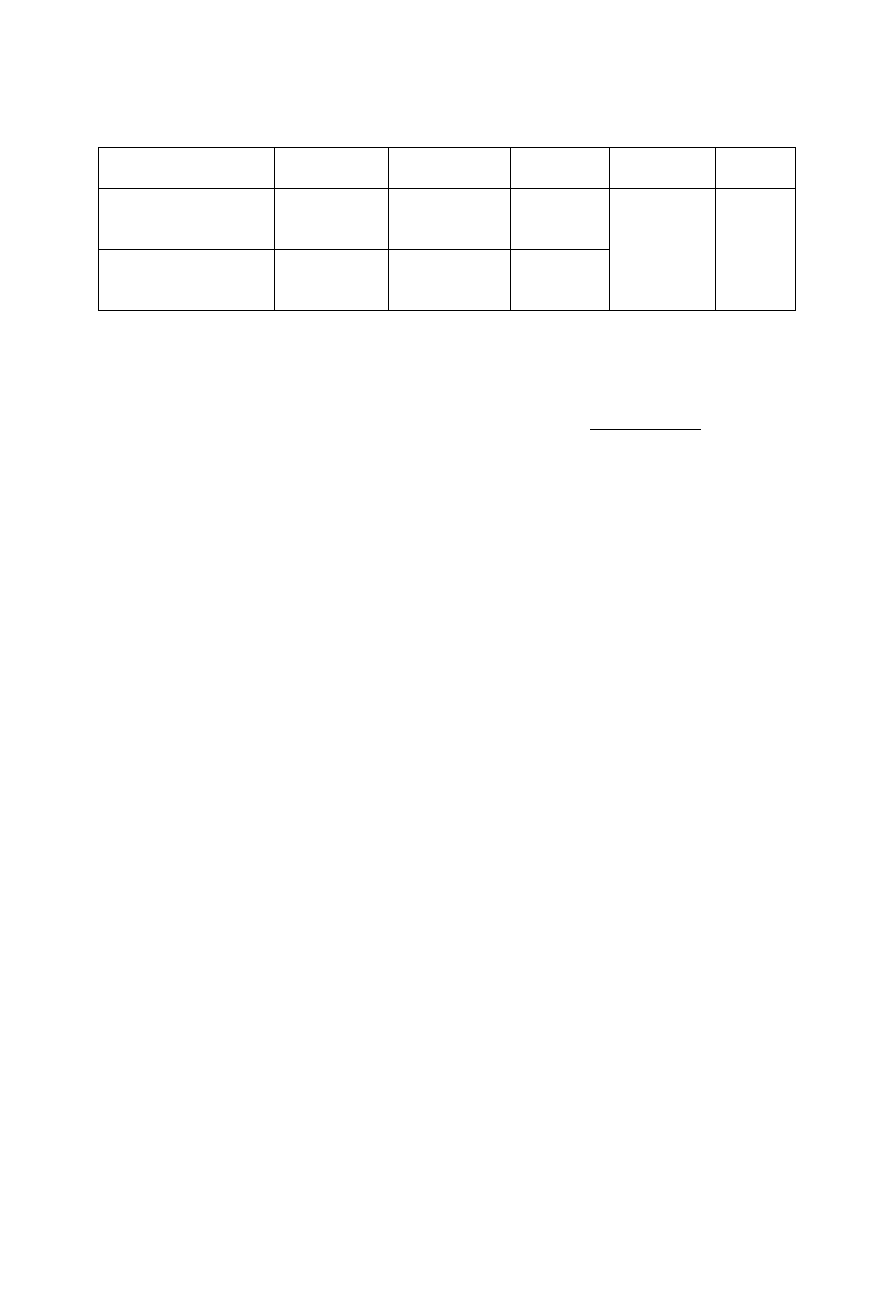

Następnie po wprowadzeniu formuły: summary (model) otrzymujemy podsumowanie naszego

modelu, które możemy przedstawić w formie tabeli analizy wariancji:

Źródło zmienności

Liczba stopni

swobody

Suma

kwadratów

Średni

kwadrat

Statystyka

testowa F

p-

wartość

Czynniki

eksperymentalne

(rodzaj paszy)

Czynnik losowy

(naturalna zmienność

wewnątrz grup)

Gdy p-wartość jest < α = 0,05 to należy odrzucić hipotezę zerową (H

0

) o tym, że µA= µB= µC, czyli że

średnie przyrosty dla każdej z pasz są takie same. Oznacza to, że pasze różnicują wartości przyrostu.

Ponieważ odrzucamy H

0

o równości średnich to można przeprowadzić test post-hoc. Stosujemy

metodę HSD Tukey'a dla układu zrównoważonego tzw. test Turkey o formule:

TukeyHSD(aov(przyrost~pasza)).

Gdy p adj, czyli wartości prawdopodobieństwa testowego są > α = 0,05 określa to, że wszystkie pary

rodzajów paszy różnią się statystycznie istotnie w zakresie średnich przyrostów wagi, gdy tylko jedna

p adj > α = 0,05 (np. dla pary C-B) to tylko dla pasz B i C można odrzucić hipotezę o równości średnich.

Możemy

zilustrować

przedziały

ufności

na

wykresie

korzystając

z

formuły:

plot

(TukeyHSD(aov(przyrost~pasza))).

Wyszukiwarka

Podobne podstrony:

Jednoczynnikowa analiza wariancji

Jednoczynnikowa analiza wariancji zadania Word2003, Elementy matematyki wyższej

Analiza wariancji, Jednoczynnikowy model analizy wariancji

Opis analizowanych wariantów inwestycji

Analiza wariancji wprowadzenie

Analiza wariancji

Hierarchiczna analiza wariancji zadania Word2003, Elementy matematyki wyższej

8 1 analiza wariancji odp

ANALIZA 3 WARIANTÓW ZAMIENNEGO WYKONANIA OKIEN

10 Analiza wariancji

analiza wariancji

analiza wariancji metodologia wyk4

ANOVA jednoczynnikowa analiza w Nieznany (2)

Analiza wariancji

zaj 10i11 analiza wariancji

więcej podobnych podstron