1

REGRESJA LINIOWA

Jeżeli zmierzono obarczone tylko błędami przypadkowymi wartości ( x

i

, y

i

), i = 1, 2, ..., n dwóch różnych

wielkości fizycznych X i Y, o których wiadomo, że są związane ze sobą zależnością liniową y = f(x), to

najlepszym przybliżeniem współczynników A i B w równaniu y = Ax + B jest

A

n

x y

x

y

i i

i

n

i

i

n

i

i

n

=

⎛

⎝

⎜

⎞

⎠

⎟ −

⎛

⎝

⎜

⎞

⎠

⎟

⎛

⎝

⎜

⎞

⎠

⎟

⎡

⎣

⎢

⎤

⎦

⎥ ⋅

=

=

=

∑

∑

∑

1

1

1

1

Γ

,

B

x

y

x

x y

i

i

n

i

i

n

i

i

n

i

i

i

n

=

⎛

⎝

⎜

⎞

⎠

⎟

⎛

⎝

⎜

⎞

⎠

⎟ −

⎛

⎝

⎜

⎞

⎠

⎟

⎛

⎝

⎜

⎞

⎠

⎟

⎡

⎣

⎢

⎤

⎦

⎥ ⋅

=

=

=

=

∑

∑

∑

∑

2

1

1

1

1

1

Γ

,

gdzie

Γ =

⎛

⎝

⎜

⎞

⎠

⎟ −

⎛

⎝

⎜

⎞

⎠

⎟

=

=

∑

∑

n

x

x

i

i

n

i

i

n

2

1

1

2

Wielkości charakteryzujące zależność liniową zostały obliczone w oparciu o punkty doświadczalne, a te

obarczone są niepewnościami związanymi z wykonywanymi pomiarami. Dlatego współczynniki A i B też są

wyznaczane z pewną dokładnością. Niepewności wielkości A i B obliczamy następująco:

δ

σ

A

n

y

=

Γ

,

δ

σ

B

x

y

i

i

n

=

=

∑

2

1

Γ

,

gdzie

(

)

σ

ε

y

i

i

i

n

i

i

y

Ax

B

n

n

=

−

−

−

=

−

=

∑

∑

2

1

2

2

2

UWAGA:

1. Aby narysować „prostą regresji liniowej” na papierze milimetrowym wybieramy dowolne ( względnie

odległe od siebie) współrzędne x

p

i x

k

( nie współrzędne punktów pomiarowych ! ), obliczymy

odpowiadające im współrzędne y

p

i y

k

według równania y = Ax + B ( A i B już są znane ), nanosimy

punkty o współrzędnych (x

p

, y

p

) oraz ( x

k

, y

k

) i przez te punkty przeprowadzamy prostą. Punkty

odpowiadające wynikom naszych pomiarów wraz z ich niepewnościami powinny rozkładać się

równomiernie w pobliżu tej prostej i może się okazać, że żaden z naszych punktów pomiarowych nie

leży na niej !

Znaczne odstępstwa ( ponad 30 % ) punktów pomiarowych od linii teoretycznej pozwalają

przypuszczać, że mierzone wielkości nie są liniowo zależne. Wtedy też współczynnik korelacji

znacznie różni się od jedności. Jeśli te odstępstwa dotyczą małej ilości punktów pomiarowych

usytuowanych w różnych częściach wykresu to przyjmujemy, że punkty te obarczone są tzw. błędem

grubym. Takie punkty odrzucamy, a dla pozostałych ponownie obliczmy wszystkie parametry prostej

najlepszego dopasowania tzn. A,

δ

A, B,

δ

B oraz współczynnik korelacji R.

2

2. Wszystkie kalkulatory typu „ SCIENTIFIC”, które wykonują obliczenia statystyczne jednej

zmiennej, automatycznie obliczają sumy typu

∑ ∑

i

i

2

i

i

x

,

x

, gdzie i = 1,2,3,...n . Kalkulatory pozwalające

wykonywać obliczenia statystyczne na dwóch zmiennych, obliczają także sumy typu

y

y

x y

i

i

i

i

i

i

i

,

,

2

∑

∑

∑

. Możliwe więc jest wyznaczenie wszystkich parametrów prostej najlepszego

dopasowania metodą regresji liniowej zwanej również metodą najmniejszych kwadratów. Przed

obliczeniami sprawdzić w instrukcji dołączonej do kalkulatora, czy regresja jest liczona dla równania

y = Ax + B czy dla y = A + Bx. Aby wyznaczyć niepewności współczynników A i B przy pomocy

kalkulatora wygodniej jest zastosować następujące przybliżenie

ε

i

i

i

i

i

i

i

i

i

y

A

x y

B

y

2

2

≅

−

−

∑

∑

∑

∑

zamiast

ε

i

i

i

i

i

y

Ax

B

2

2

=

−

−

∑

∑

(

)

Procedura ta może wpłynąć na zmianę wartości

σ

y

, która zależna jest od

ε

i

i

2

∑

. W konsekwencji może

to spowodować zmianę wartości

δA i δB choć wyrażenia pozostają takie same

δ

ε

A

n

n

i

i

=

−

∑

2

2

Γ

δ

ε

B

n

x

i

i

i

i

=

−

∑

∑

2

2

2

Γ

W rozważanym przykładzie

y

1

= f(x)

z wzorów „wygodnych” mamy

ε

i

i

2

∑

≅ 469,8796 – 344,0643 – 124,6749 = 1,140437

ε

i

i

n

2

2

1140437

3

0 6165595

∑

−

=

=

,

,

δA = 0,1992366 δB = 0,6618653

Na podstawie wzorów „dokładnych” otrzymano

(

)

,

,

y

Ax

B

n

i

i

i

−

−

−

=

=

∑

2

2

11404299

3

0 6165576

δA = 0,1992360 δB = 0,6618633

Widać, że zgodność otrzymanych wielkości liczbowych jest bardzo dobra. Celowo zaniechano zaokrągleń.

Równanie prostej najlepszego dopasowania będzie

y

1

= ( 2,1541

± 0,1993)x + ( 2,707 ± 0,662 )

Ten sposób obliczania niepewności

δA i δB jest o wiele prostszy i szybszy lecz mniej dokładny. Może

na przykład zawyżać wartości poszukiwanych wielkości

δA i δB niezależnie od zaokrągleń

różnych wielkości

na poszczególnych etapach obliczeń. Poza tym, schematyczne stosowanie przybliżonej zależności

3

ε

i

i

i

i

i

i

i

i

i

y

A

x y

B

y

2

2

≅

−

−

∑

∑

∑

∑

może prowadzić do bezsensownych wartości liczbowych wielkości

ε

i

i

2

∑

( np. wartości ujemne

!!! ) nawet przy dużej dokładności pomiarów i obliczeń. W przypadku, gdy przy

obliczaniu wyrażenia przybliżonego

ε

i

i

2

∑

występuje różnica dwóch dużych, prawie jednakowych liczb,

należy koniecznie posłużyć się zależnością definicyjną

ε

i

i

i

i

i

y

Ax

B

2

2

=

−

−

∑

∑

(

) .

WSPÓŁCZYNNIK KORELACJI

Współczynnik korelacji R jest miarą liczbową korelacji (związku, współzależności) zmiennych x

i

i y

i

(i = 1, 2, 3,...n) tworzących serie pomiarów wielkości X i Y. Z jednej strony służy do upewnienia się, czy

mamy wystarczającą ilość n pomiarów wielkości x

i

i y

i

by twierdzić, że zachodzi między nimi korelacja czyli

zależność np. liniowa, wykładnicza, logarytmiczna. Z drugiej strony R jest miarą prawdopodobieństwa istnienia

przyjętej (postulowanej) współzależności zmiennych x

i

i y

i

. Jeżeli związek między zmiennymi x

i

i y

i

jest

liniowy, y = f(x), to R nazywamy współczynnikiem korelacji liniowej, a współzależność między dwiema

seriami pomiarów - korelacją liniową. Korelacja jest tym silniejsza, im większą wartość z przedziału [-1, +1 ]

osiąga

⎢R ⎢. Duża wartość współczynnika ⏐R⏐ świadczy o dużym prawdopodobieństwie postulowanego

związku zmiennych x

i

i y

i

. W szczególności R =

±0,95 oznacza prawdopodobieństwo równe 95% dla badanej

współzależności. Tak więc, może zachodzić korelacja liniowa pomiędzy punktami doświadczalnymi (x

i

, y

i

),

lecz obarczona jest niepewnością względną wynoszącą 5%.

Jeżeli R =

± 1 mówimy o korelacji zupełnej, jeżeli

R = 0 to mówimy o braku korelacji. Mała wartość współczynnika korelacji R może wskazywać na zbyt krótką

serię pomiarów lub na inną, niż przyjęto, współzależność między wielkościami x

i

i y

i

. W pierwszym przypadku

przeprowadzamy pomiary uzupełniające, a w drugim, o ile nie przeczy to prawom rządzącym badanym

związkiem między seriami pomiarów, sprawdzamy inną korelację, np. krzywoliniową zamiast liniowej.

Informacje dotyczące regresji nieliniowej zawarte są w § 4.2. skryptu „Ćwiczenia laboratoryjne z fizyki, cz.I.

Podstawy opracowania wyników pomiarów” OWPWr., Wrocław 1999 - P

OPRAWSKI

R., S

ALEJDA

W

.

Jeżeli

natomiast wiadomo, że związek między wielkościami x

i

i y

i

ma charakter wykładniczy, to warto najpierw

dokonać tzw. linearyzacji badanej zależności a następnie skorzystać z metody regresji liniowej. Więcej na ten

temat można znaleźć w §3.3. wspomnianego skryptu.

Graniczne wartości

⎢R ⎢w zależności od liczby pomiarów n, od których wzwyż można wnioskować o

istnieniu współzależności, przedstawia poniższa tabela.

n

5 10 20 30 40 50 75 100 500

1000

10000

⎢R ⎢

0,99 0,84 0,64 0,53 0,47 0,42 0,35 0,30 0,14 0,10 0,03

Rozumiemy ją następująco: jeżeli np. dla n = 10 otrzymano wartość współczynnika korelacji | R | nie mniej niż

0,84, to przyjęty związek między wielkościami x

i

i y

i

jest poprawny, ale tylko w 84%. W związku z tym, nie

można spodziewać się ułożenia wszystkich punktów pomiarowych na linii najlepszego dopasowania.

4

Wartości średnie x i y zmiennych x

i

i y

i

, standardowe odchylenia pojedynczego pomiaru S

x

i S

y

,

współczynnik korelacji R i parametry prostej y = Ax + B spełniają następujące relacje:

A

R

S

S

y

x

=

B

y

Ax

= −

( )

S

x

n

x

i

i

=

−

∑

Δ

2

1

( )

S

y

n

y

i

i

=

−

∑

Δ

2

1

gdzie: S

x

i S

y

– odchylenia standardowe pojedynczej wartości z serii pomiarów x

i

i y

i

,

Δx = x

i

-

x ,

Δy

i

= y

i

- y ,

x i y – wartości średnie serii x

i

i y

i

,

n – ilość pomiarów w seriach x

i

i y

i

.

W programie użytkowym Excel przy wykonywaniu wykresów można określić współczynnik korelacji,

jednak

niepewności współczynników A i B liczymy korzystając ze wzorów regresji liniowej, lub korzystając z

programów „regresja”. Należy pamiętać, że w przypadku mianowanych wielkości zmiennych x

i

i y

i

również

współczynniki A, δA, B i δB są wielkościami mianowanymi – należy podawać wartości tych współczynników

wraz z jednostkami !!!.

Wskazane jest także podanie faktycznej zależności, dla której zastosowana będzie

metoda regresji liniowej. Przykładowo rozważmy odkształcenia jednoosiowe (np. rozciąganie drutu), które w

wąskim zakresie naprężeń podlegają prawu Hooke’a:

S

F

L

L

E

0

=

Δ

,

Jeśli ta zależność zostanie przybliżona funkcją liniową y = Ax + B to x ≡

0

L

L

Δ

, y ≡

S

F

, A ≡ E oraz δA ≡ ΔE.

Jeśli natomiast funkcją liniową przybliży się wyrażenie E

m

L

g

L

S

0

≡

Δ

to

x ≡ ΔL, y ≡ m oraz A ≡

g

L

ES

0

.

W tym przypadku moduł Younga,

E, należy obliczyć na podstawie wartości liczbowych A, S, L

0

i

g, a jego

niepewność

ΔE - na podstawie niepewności δA, ΔS, ΔL

0

i

Δg. Obie metody są poprawne, jednak pierwsza

pozwala bezpośrednio wyznaczyć szukany parametr

E i niepewność ΔE. Wymiary współczynników prostej

regresji

(

A, B ) w każdym z prezentowanych przykładów będą oczywiście różne.

gdzie:

L

O

i

S - wielkości stałe dla danego drutu ( długość

początkowa i pole przekroju poprzecznego)

F – siła powodująca naprężenie ( F = mg ),

ΔL – wydłużenie drutu pod wpływem siły F,

E – moduł Younga, poszukiwany parametr drutu.

5

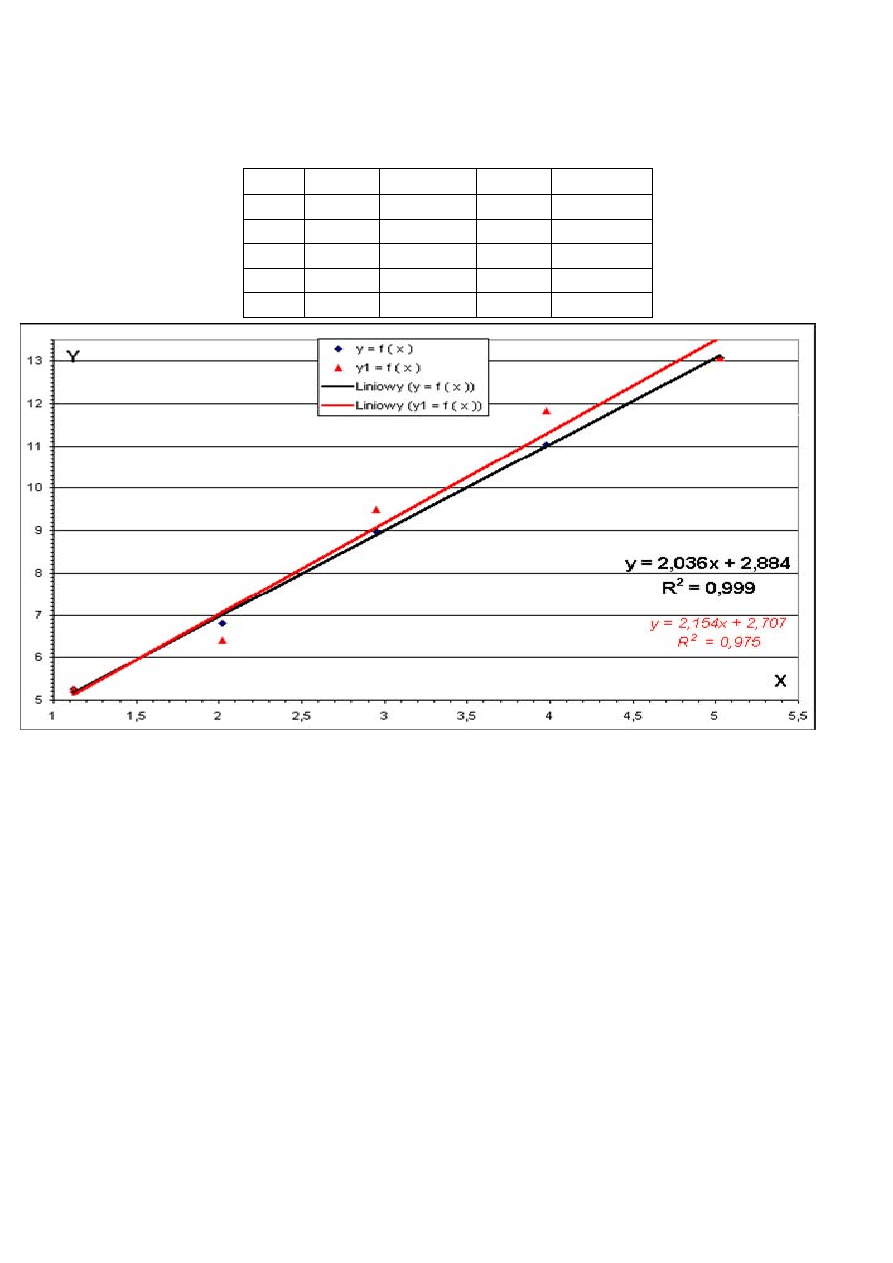

Przykład:

Dokonano pomiarów o różnej precyzji. Wyniki pomiarów wielkości

x

i

i

y

i

zebrano w tabeli.

a) tabela i wykres wykonane za pomocą programu Excel

Lp

.

x y

=

f

(

x

)

x

y

1

= f ( x )

1

1,12

5,25

1,12 5,25

2

2,02

6,80

2,02 6,40

3

2,95

8,99

2,95 9,49

4

3,98

11,03

3,98 11,83

5

5,03

13,09

5,03 13,09

Jak widać, dla funkcji

y

1

=

f (x)

czyli

y = 2,154 x + 2,707

współczynnik korelacji

R = 0,987

jest za mały

(dla

n = 5, współczynnik R

≥ 0,99) czyli nie można powiedzieć ,że występuje liniowa zależność

y (x )

.

Należy więc wykonać dodatkowe pomiary w innych , lub w tych samych punktach (zagęścić pomiary,

powtórzyć wątpliwe lub/i rozszerzyć zakres pomiarowy).

b

) obliczenia wykonane na podstawie pomiarów

y = f(x) ujętych w tabeli powyżej za pomocą programu

regresja.zip znajdującego się w sieci internetowej pod adresem:

http://www.if.pwr.wroc.pl/~dydaktyka/LPF/programy/index.htmi

Współczynniki:

A = 2,036 E + 0

B = 2,884 E + 0

Niepewność współczynników:

δA = 4,534 E – 2

δB = 1,506 E – 1

c) obliczenia wykonane na podstawie pomiarów ujętych w tabeli w punkcie a) za pomocą programu

regresja.exe znajdującego się w komputerze w LPF pod adresem: C:\UŻYTKI\regresja.exe

Równanie prostej:

y = 2,036 x + 2,884

Niepewność współczynników:

δA ≡ δa = 0,045 δB ≡ δb = 0,151

Takie równanie należy przepisać, stosując prawidła zaokrąglenia, w następujący sposób:

y = ( 2,036

± 0,045 ) x + ( 2,88 ± 0,16 )

Wyszukiwarka

Podobne podstrony:

Fizyka 2 3 teoria kinetyczna id Nieznany

DYNAMIKA UKLADOW LINIOWYCH id 1 Nieznany

Fizyka Prad elektryczny test id Nieznany

Fizyka lista zadan 1 id 176924 Nieznany

fizyka by lesnik id 176590 Nieznany

fizyka cz 2 pdf id 176637 Nieznany

Fizyka zestaw VII id 177324 Nieznany

Algebra liniowa1 id 57289 Nieznany

fizyka sciaga telefon id 176620 Nieznany

Materialy dydaktyczne FIZYKA id Nieznany

Fizyka i astronomia 12 id 17675 Nieznany

Algebra liniowa 1 3 id 57241 Nieznany

więcej podobnych podstron