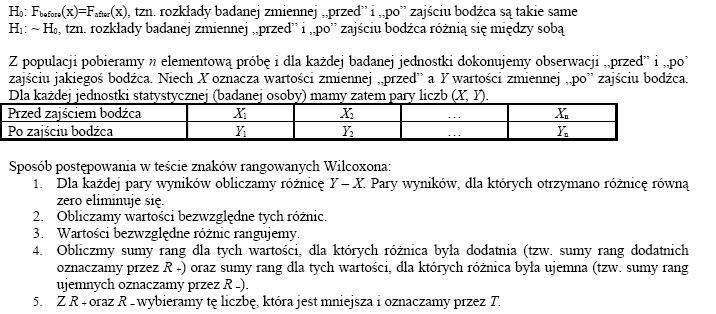

Wykład 5

Zastosowania statystyki Z w testach parametrycznych i nieparametrycznych

. Test Cochrana i Coxa oraz Welcha lub U Manna-Whitney'a. Testy te zastępują standardowy test t Studenta w sytuacji, gdy nie jest spełnione założenie homogeniczności wariancji rozkładów zmiennej zależnej porównywanych populacji.(por. Brzeziński, 1975 - test Cochrana i Coxa; Oktaba, 1966; Ferguson, 1976; Góralski, 1976, Kowal 1998).

(d). Testy istotności różnic dla danych niezależnych, wyrażonych w skali co namniej porządkowej.

W tej grupie testów istotności przedstawione są trzy testy:

test U Manna-Whitney'a,

test Kołmogorowa-Smirnowa i

test "serii" Walda-Wolfowitza, które mogą być szczególnie użyteczne w badaniach sondażowych badaniach społeczno-ekonomicznych i psychologicznych.

Wynika to z następujących faktów:

testy te występują w standardowych pakietach statystycznych, dostępnych również na polskim rynku;

oparte są na łatwych do zrozumienia bez specjalnego przygotowania matematycznego ideach;

ze względów merytorycznych i interpretacyjnych mogą być pomocne w rozwiązywaniu problemów, dotyczących metod kształtowania produktów, polityki cenowej lub polityki komunikacji społecznej (np. reklamy);

zakładają co najmniej porządkowy poziom pomiaru i losowość próby, przy czym badacz nie musi określać kształtu rozkładu;

badane populacje próbne mogą być statystycznie małe.

Tak więc można przyjąć założenia słabsze niż dla testów parametrycznych, a z drugiej strony testy te pozwalają badać różnice między całymi rozkładami, wartości ekstremalne różnic, różnice dyspersji oraz różnice tendencji centralnych.

Omawiane testy można na przykład stosować w sytuacjach, gdy po szybkim sondażu wśród klientów lub sprzedawców, porównuje się dwie grupy produktów o jednakowym przeznaczeniu, z których jedna uzyskała najwyższą rangę w preferencjach klientów, a druga rangę najniższą. Dzięki wspomnianym testom można kolejno analizować nasilenie charakterystycznych dla danego produktu właściwości (na przykład zawartości alkoholu w piwie lub środków aromatyzyjących w proszkach do pieczenia), uzyskując informacje o

różnicach w postaciach rozkładów, w dyspersji, czy w tendencji centralnej.

(d-1). Test U Manna-Whitneya (test Wilcoxona).

Test U Manna-Whitneya (test Wilcoxona) testuje hipotezę, że dwie zmienne niezależne (mierzone co najmniej na skali porządkowej) pochodzą z tej samej populacji i mają taki sam rozkład.

Statystyką służącą w tym wypadku do testowania hipotezy zerowej jest suma rang dla każdej z dwóch zmiennych (grup).

Idea testu opiera się na założeniu, że jeśli zmienne mają taki sam rozkład wartości, to rozkłady ich rang również będą podobne.

Tak więc omawiany test znajduje zastosowanie w przypadku testowania różnic między rozkładami zmiennej zależnej w grupach o liczebności n1 i n2 (w przypadku, gdy grupy nie są równoliczne przyjmuje się, że n1 < n2 ).

Wyniki, których jest n1 + n2, wymagają porangowania - od wyniku najmniejszego do wyniku najwyższego - czyli od rangi "1" do rangi "najwyższej". Następnie sumuje się rangi przypisane wynikom w grupie o liczebności n1 i w grupie o liczebności n2. Otrzymane sumy rang oznacza się przez R1 i R2. W kolejnym kroku oblicza się wartości U' i U'' według wzorów:

Mniejsza z dwóch wartości: U' i U'' stanowi statystykę U.

Wiemy też, że R1+R2=N(N+1)/2 i N=n1+n2. Wiemy też, że

Hipoteza zerowa zakłada, iż dwie próby : n1 i n2 pochodzą z tej samej populacji. Test "U" występuje w trzech wersjach:

(1) 3 <= n2 <=8

(2) 9 <= n2 < 20

(3) n2 >= 20

W wersji (3) wykorzystuje się fakt, iż rozkład "U" z próby jest w przybliżeniu normalny, ze średnią mu i wariancją σu2 :

Następnie oblicza się wartość statystyki Z wg wzoru:

H0 odrzucamy, gdy |Zemp.| >= Z α/2 (test dwustronny).

(por. Blalock, 1975; Domański, 1979; Siegel, 1956; Ferguson, 1976; Waligóra, 1985; Brzeziński, 1996, Kowal 1998). W pracy Blalocka (1975) oraz Jaworowskiej i Michalicka (1978),

(d-2). Test Kołmogorowa-Smirnowa. Test Kołmogorowa-Smirnowa może znaleźć zastosowanie w sytuacjach, gdy badacza interesują różnice dotyczące mediany, dyspersji, skośności itd. między rozkładami dwóch zmiennych niezależnych. Jest testem zbliżonym do testu U-Manna-Whitney'a w sensie idei, lecz porównuje raczej całe rozkłady, a nie rangi. Może być również stosowany w przypadku rang wiązanych. Test ten służy do sprawdzenia hipotezy, że dwie próby o liczebościach: n1 i n2 pochodzą z tej samej populacji. Jeśli hipoteza zerowa jest prawdziwa, to kumulatywne rozkłady częstości (dystrybuanty) dla obu prób powinny być zbliżone. W teście Kołmogorowa-Smirnowa statystykę stanowi największa różnica między częstościami - D. Jeśli różnica z próbki jest większa niż różnica krytyczna dla danego poziomu istotności przy znanej liczebności prób, należy podejrzewać, że hipoteza zerowa nie zachodzi. Można przy tym uwzględniać kierunek rozbieżności między populacjami lub badać różnice w dowolnym kierunku.

Test Kołmogorowa-Smirnowa, dla jednej próby, do oceny zgodności rozkładu z rozkładem normalnym wykorzystuje maksymalną wartość różnicy między dystrybuantą z próby, a założoną dystrybuantą. Jeżeli wartość prawdopodobieństwa testowego jest mniejsza od przyjętego poziomu istotności, to hipotezę, że badany rozkład jest zgodny z normalnym należy odrzucić. Wiele programów oblicza wartości prawdopodobieństwa na podstawie tabeli przygotowanej przez Masseya (1951), należy jednak zwrócić uwagę, że wartości te są poprawne przy założeniu, że znamy średnią w populacji generalnej i odchylenie standardowe rozkładu normalnego, a nie oceniamy je na podstawie próby. W praktyce parametry rozkładu najczęściej wyznaczamy z danych, co oznacza konieczność testowania złożonej hipotezy warunkowej ("jak jest prawdopodobieństwo uzyskania wartości statystyki D większej lub równej od pewnej wartości, przy założeniu wartości parametrów rozkładu wyznaczonych z danych") i powinniśmy stosować prawdopodobieństwo Lillieforsa (Lilliefors, 1967). Zwróćmy uwagę, że w ostatnich latach najczęściej zaleca się test W Shapiro-Wilka ze względu na jego dużą moc w porównaniu do innych testów.

Zakłada się, że rozkłady zmiennej zależnej w porównywanych populacjach mają dystrybuanty ciągłe: F1 = F2. Wyniki otrzymane z przebadania n1 + n2 obiektów ranguje się w relatywnie wąskie przedziały - im więcej przedziałów zbuduje badacz, tym lepiej.

Test Kołmogorowa-Smirnowa występuje w następujących wersjach:

(x) n1 =n2 = n < 40

(xx) n1 = n2 lub n1 n2 oraz n1 > 40 lub n2 > 40

(xxx) n1 n2 oraz n2 < 40 (n2 > n1).

Gdy kierunek rozbieżności jest przewidziany, można zastosować przybliżenie chi-kwadrat. Wzór aproksymacyjny ma postać :

przy dwóch stopniach swobody.

Gdy próby są większe od 40, a kierunek rozbieżności nie jest przewidziany, podane są wzory na różnicę między rozkładami kumulatywnymi przy założonych poziomach istotności. Odrzucenie hipotezy zerowej jest możliwe przy założonym poziomie istotności, jeśli róznica przyjmuje co najmniej wartość minimalną określoną przykładowymi wzorami podanymi w tabelce:

minimalna różnica |

poziom istotności |

|

0.001 |

|

0.01 |

|

0.05 |

|

0.1 |

Test można zastosować na przykład w analizie w porównaniu zawartości alkoholu dwóch grup marek piwa. Marki piwa w pierwszej grupie uzyskały najwyższą rangę u klientów, a marki piwa w drugiej grupie - najniższą. Liczebności i rangi wynosiły

odpowiednio: w grupie pierwszej 10 i 3, a w grupie drugiej 11 i 1.

Największa różnica co do wartości bezwzględnej wyniosła 0.6, a wartość statystyki Kołmogorowa-Smirnowa z=1.373, przy obliczonym przez komputer obserwowanym poziomie istotności równym 0.046. Tak więc w tym wypadku, jeśli badacz przyjął wstępnie poziom istotności równy 0.05, można podjąć decyzję o odrzuceniu hipotezy zerowej, co oznacza, że w skrajnie ocenionych przez klientów markach piwa zawartość alkoholu jest różna. (por. Blalock, 1975; Brzeziński, 1975; Domański, 1979; Kirk, 1968; Siegel, 1956).

Przykład

Zmienna: KKS2_Komunikacja - wynik surowy, Rozkład: Normalny d Kołmogorowa-Smirnowa 0,16734, p = n.i., p Lillieforsa < 0,05 Chi-kwadrat = 2,43695, df = 1 (dopasow.) , p = 0,11851

Górna granica |

Obserw. |

Skumul. |

Oczekiw. |

Skumul. |

Obsew. - |

<= 23,00 |

0,00 |

0,00 |

0,09 |

0,09 |

-0,09 |

24,00 |

1,00 |

1,00 |

0,10 |

0,19 |

0,90 |

25,00 |

0,00 |

1,00 |

0,19 |

0,38 |

-0,19 |

26,00 |

1,00 |

2,00 |

0,33 |

0,71 |

0,67 |

27,00 |

0,00 |

2,00 |

0,54 |

1,25 |

-0,54 |

28,00 |

0,00 |

2,00 |

0,84 |

2,09 |

-0,84 |

29,00 |

2,00 |

4,00 |

1,20 |

3,29 |

0,80 |

30,00 |

2,00 |

6,00 |

1,62 |

4,92 |

0,38 |

31,00 |

2,00 |

8,00 |

2,05 |

6,96 |

-0,05 |

32,00 |

2,00 |

10,00 |

2,42 |

9,39 |

-0,42 |

33,00 |

1,00 |

11,00 |

2,68 |

12,06 |

-1,68 |

34,00 |

2,00 |

13,00 |

2,77 |

14,83 |

-0,77 |

35,00 |

6,00 |

19,00 |

2,68 |

17,52 |

3,32 |

36,00 |

3,00 |

22,00 |

2,43 |

19,95 |

0,57 |

37,00 |

2,00 |

24,00 |

2,06 |

22,02 |

-0,06 |

38,00 |

1,00 |

25,00 |

1,64 |

23,66 |

-0,64 |

39,00 |

0,00 |

25,00 |

1,22 |

24,88 |

-1,22 |

40,00 |

2,00 |

27,00 |

0,85 |

25,72 |

1,15 |

41,00 |

0,00 |

27,00 |

0,55 |

26,28 |

-0,55 |

< nieskończonoś |

0,00 |

27,00 |

0,72 |

27,00 |

-0,72 |

(d-3). Test Walda-Wolfowitza (test"serii"). Test serii jest najmocniejszy przy porównaniach dyspersji lub postaci rozkładów. Test ten służy do sprawdzenia hipotezy, że dwie próby o liczebnościach n1 i n2 pochodzą z tej samej populacji. Test oparty jest na rozkładzie liczby serii. Wyniki n1 + n2 osób porządkuje się od wyniku najmniejszego do największego. Niech symbol "a" oznacza wyniki z próby n1, a symbol "b" wyniki próby n2. Odczytuje się liczbę serii w tym ciągu; przykładowo w ciągu:

występuje k=9 serii (n1 = 10, n2 =9).

Dla n1 i n2 zawartych w przedziale (2,...,20) można znaleźć, w specjalnie skonstruowanych tablicach dla różnych poziomów istotności, krytyczną liczbę serii kΣ±. Jeżeli k <= kΣ±, to odrzuca się H0 i przyjmuje hipotezę alternatywną, że dwie próby pochodzą de facto z różnych populacji. Dla n2 > 20 (n2 > n1) rozkład statystyki k2 z próby jest w przybliżeniu rozkładem normalnym o średniej mk i wariancji σ2k:

Następnie oblicza się wartość Z informującą o rozstępie między rzeczywistą a przewidywaną przez H0 liczbą serii, wyrażoną w jednostkach odchylenia standardowego:

Odrzuca się H0, jeżeli: |zemp.|>= zα. Przy korzystaniu z procedur komputerowych nie ma problemu poszukiwania tablic i odczytywania wartości statystyk lub liczby serii w zależności od liczebności próby. Programy komputerowe (SPSS, STATGRAPHICS, SYSTAT, STATISTICA) drukują odpowiednie wartości statystyk wraz z dokładnym prawdopodobieństwem wystąpienia wartości wyliczonych na podstawie próby losowej, przy założeniu H0. Jeśli prawdopodobieństwo jest niższe niż założony wcześniej poziom istotności, hipotezę zerową odrzuca się na korzyść hipotezy alternatywnej. (por. Blalock, 1975; Domański, 1979; Greń, 1976; Siegel, 1956; Kirk, 1968).

Wykład 6

Test nieparametryczne dla pomiarów zależnych

(c). Test T Wilcoxona.

Z populacji losuje się próbę n-elementową.

Dla każdego z n obiektów dokonuje się pomiaru zmiennej zależnej w dwóch momentach czasowych - na przykład "przed" i "po" wprowadzeniu postępowania eksperymentalnego. Test może być też wykorzystywany w badaniu, dotyczącym dwóch momentów czasowych, oddzielonych nie postępowaniem eksperymentalnym, lecz bodźcami, które są konsekwencją zjawisk i zdarzeń gospodarczych (na przykład denominacją złotego) lub konsekwencją pewnych nowych zabiegów ze strony firm, prowadzących ekspansywną politykę komunikacji społecznej.

Następnym krokiem jest obliczenie dla każdego obiektu wartości różnicy: dk = y1k - y2k.

Pary wyników, dla których dk = 0 eliminuje się.

U pozostałych par wyników ranguje się bezwzględne wartości różnic, tj. |dk| od wartości najniższej do najwyższej.

Następnie oddzielnie sumowane są te rangi, które zostały przypisane różnicom : dk < 0.

Mniejsza z dwóch sum stanowi statystykę T.

Hipoteza zerowa zakłada, że suma rang różnic o ujemnym znaku jest równa sumie rang różnic o znaku dodatnim, czyli T równe jest połowie całkowitej sumy rang.

Im bardziej otrzymana wartość T odbiega od zakładanej przez H0 wartości T, tym bardziej zwiększają się szanse odrzucenia H0. Tak więc odrzuca się H0, gdy: T <= Tα.

Test T występuje w dwóch wariantach:

(I) dla liczby par o dk ≠ 0, która zawiera się w przedziale od 6 do 25. Wartości krytyczne statystyki T zawarte są w specjalnych tablicach statystycznych (por. Brzeziński, 1975; Jaworowska, Michalićka, 1978; Blalock, 1975; Domański, 1979; Siegel, 1956; Hollander, Wolfe, 1973).

(II) dla liczby par o dk ≠ 0 rozkład T z próby jest w przybliżeniu normalny o średniej μT i wariancji δ2 (n>25):

Następnie obliczana jest wartość statystyki Z według wzoru:

H0 odrzuca się, gdy |Z|> Zα(test dwustronny).

(por. Brzeziński, 1975; Jaworowska, Michalićka, 1978; Blalock, 1975; Domański, 1979; Siegel, 1956; Hollander, Wolfe, 1973; Waligóra, 1985; Brzeziński, 1996).

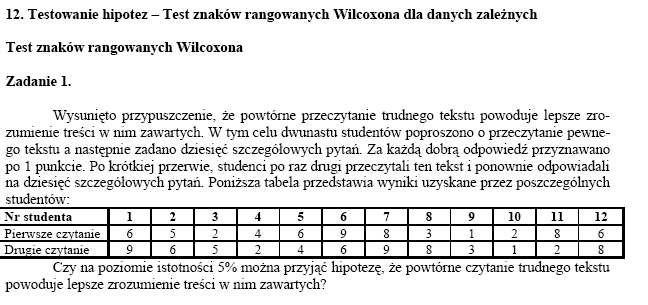

i |

xi-I czytanie |

yi-II czytanie |

di=xi-yi

|

|di=xi-yi| |

R|di| |

|R+| |

|R-| |

r(|R+|)i |

r(|R-|)i |

1 |

6 |

9 |

-3 |

3 |

9 |

|

9 |

|

5,5 |

2 |

5 |

6 |

-1 |

1 |

2 |

|

2 |

|

1,5 |

3 |

2 |

5 |

-3 |

3 |

9 |

|

9 |

|

5,5 |

4 |

4 |

2 |

2 |

2 |

5,5 |

5,5 |

|

2,5 |

|

5 |

6 |

4 |

2 |

2 |

5,5 |

5,5 |

|

2,5 |

|

6 |

9 |

6 |

3 |

3 |

9 |

9 |

|

4 |

|

7 |

8 |

9 |

-1 |

1 |

2 |

|

2 |

|

1,5 |

8 |

3 |

8 |

-5 |

5 |

11 |

|

11 |

|

7 |

9 |

1 |

3 |

-2 |

2 |

5,5 |

|

5,5 |

|

3,5 |

10 |

2 |

1 |

1 |

1 |

2 |

2 |

|

1 |

|

11 |

8 |

2 |

6 |

6 |

12 |

12 |

12 |

5 |

3,5 |

12 |

6 |

8 |

-2 |

2 |

5,5 |

|

|

|

|

|

|

|

|

|

suma rang |

34 |

50,5 |

T=min(R+, R-)=34 |

|

|

|

|

|

|

|

|

|

|

|

Hipoteza zerowa zakłada, że suma rang różnic o ujemnym znaku jest równa sumie rang różnic o znaku dodatnim, czyli T równe jest połowie całkowitej sumy rang.

Im bardziej otrzymana wartość T odbiega od zakładanej przez H0 wartości T, tym bardziej zwiększają się szanse odrzucenia H0. Tak więc odrzuca się H0, gdy: T <= Tα.

Wersja I

|

Xi & Yi |

N Ważnych |

12,00 |

T |

34,00 |

Z |

0,39 |

poziom p |

0,69 |

T*=14 |

Te=34>T*=14; nie ma podstaw do odrzucenia Ho |

Im bardziej otrzymana wartość T odbiega od zakładanej przez H0 wartości T, tym bardziej zwiększają się szanse odrzucenia H0. Tak więc odrzuca się H0, gdy: T <= Tα. |

Wersja II

(II) dla liczby par o dk ≠ 0 rozkład T z próby jest w przybliżeniu normalny o średniej μT i wariancji δ2 (n>25):

Następnie obliczana jest wartość statystyki Z według wzoru:

H0 odrzuca się, gdy |Z|> Zα(test dwustronny).

N=12

m= |

39,00 |

S= |

12,75 |

Ze= |

-0,39 |

|Ze|= |

0,39 |

Wyszukiwarka

Podobne podstrony:

Rozkład U Manna Whitneya Wilcoxona w teście dla dwóch prób niezależnych

Rozkłąd U Manna Whitneya Wilcoxonaw teście dla dwóch prób niezależnychU

wyklad10 testy nieparametryczne

Testy istotności różnic dla prób niezależnych

Metodologia z elelmentami statystyki dr Izabela Krejtz wyklad 6 Test T dla prób niezależnyc

Wyklad 9 statystyka testy nieparametryczne

Testy dla dwoch srednich, FiR SAN Łódź, semestr 3, Statystyka

Wykład 6 Analiza wariancji Testy nieparametryczne

Weryfikacja hipotez dla prób niezależnych

Wyklad 6 Testy zgodnosci dopasowania PL

Wyklad FP II dla studenta

wyklad 6 Testy zgodnosci dopasowania PL

Wykład IV Ubezpieczenia dla przedsiębiorstw

testy nieparametryczne

pytania testowe i chemia budowlana -zestaw3, Szkoła, Pollub, SEMESTR II, chemia, wykład, testy

lipidy 2, Prywatne, Biochemia WYKŁADÓWKA I, Biochemia wykładówka 1, TESTY, testy

Monitoring wykłady i pytania, Materiały dla studentów, ochrona srodowiska

więcej podobnych podstron