Wykład I

Teoria - triada:

Empirycznie sprawdzalna

Teoria jest podstawą do skonstruowania metody

Terapia - sposób postępowania z ludźmi

Przykładem jest poznawcza teoria depresji - Becka:

Została dobrze sprawdzona empirycznie

Metodą jest stworzony kwestionariusz depresji Becka

Stworzono terapie - poznawcza terapia radzenia sobie z depresją

Kiedy pojawia się problem, to formułujemy go w jakimś języku, w przypadku psychologii jest to język teorii. Ale żeby coś nazwać teorią trzeba ją zweryfikować empirycznie.

W psychologii konstruujemy zmienne i za ich pomocą budujemy sensowne zdania czyli teorie, które po empirycznym zweryfikowaniu wchodzą do statusu teorii.

Teorią jest zespół twierdzeń umocowanych empirycznie:

Najpierw jest refleksja metodologiczna

Psycholog konstruuje zmienne, buduje hipotezy a następnie twierdzenia

Warunek replikacji - powtarzalności!

Zmienne - język teorii, za ich pomocą psycholog formułuje hipotezy, a po sprawdzeniu wchodzą one w język psychologii.

Warunki poprawnej konstrukcji zmiennej

I. Warunki formalne:

Rozłączność - jednej osobie przysługuje tylko jedna wartość (albo tyle, albo tyle np. IQ). Jednej osobie przysługuje tylko jedna wartość. Granice muszą być jasno określone.

Adekwatność

B-1: Wyczerpywalność - każdej osobie musi być przypisana jakaś wartość

B-2: Wyłączność - wartości zmiennej mogą być przypisane tylko tym osobom, które ta zmienna obejmuje swoim zasięgiem

II. Warunek treściowy - kryterium wyodrębniania wartości musi być trafne (kryterium musi być wywiedzione z zaakceptowanej teorii - czy da się uzasadnić zmienną na gruncie empirycznej teorii)

POSTAĆ ZWIĄZKU

Albo przyjmujemy, że związek ma charakter liniowy, albo związek jest wyraźnie krzywoliniowy

Ważna jest dla nas natura związku między Y a X-ami

Kontekst teorii psychologicznej jest najważniejszy. Teoria jest punktem wyjścia. Teoria to system twierdzeń.

Zmienne Y i X jeśli mają brać udział w badaniu, to trzeba je umieć pomierzyć.

Gdy zmienne zdefiniujemy to trzeba je potem zoperacjonalizować (wskazanie np. kobieta, mężczyzna)

Skala pomiarowa Xi Y - skala Stivensa

Nominalna

Porządkowa

Interwałowa

Ilorazowa

Gulliksen - podał podstawową aksjomatykę do tworzenia testów. Wynik, który my obserwujemy składa się z :

Wyniku prawdziwego (nieobserwowalnego)

Części błędu (SEM)

Sięgamy po ten test, który ma najniższe SEM. Prowadzi on do estymacji przedziałowej.

Trafność teoretyczna - powiązanie wyniku z teorią - Macierz WCWM

Od testu wymaga się by był rzetelny i by był trafny.

Status motywacyjny - od przymusu do statusu ochotnika

Lęk przed oceną - osoby boją się ujawnienia swojego `ja prywatnego' ponieważ obawiają się rozbicia tego obrazu. W badaniu trzeba zredukować lęk

Wskazówki sugerujące hipotezę - osoba uczestnicząca w badaniu umie odczytać intencje badacza

Nastawienia badacza - badacze nieświadomie przekazują treść swoich hipotez, oczekiwań (efekt Rosentalla). Efekt nastawienia można zredukować, gdy oddzielimy funkcje badacza od funkcji zbieracza danych.

Klasyfikacyjne - nie podlegają manipulacji np. płeć

Manipulacyjne

Podejście eksperymentalne (dla zmiennej manipulacyjnej) - model Aurora

Podejście korelacyjne (dla zmiennej klasyfikacyjnej) - model wielokrotnej regresji

Z interakcją

Bez interakcji

model efektów stałych - dobierane przez badacza

model efektów losowych - losujemy ze zbioru wartości kilka wartości

model efektów mieszanych - stałych i losowych

przydzielamy osobom numery:

wybieramy tablice liczb losowych, rząd i poźniej sprawdzamy, które liczby wchodzą np.:

i przydzielamy do grup

próby

populacji

Trafność wewnętrzna - przesądza o precyzji badania

Trafność zewnętrzna - związana z jakością wniosków (z próby przekładamy wnioski na populację)

Badacz musi kontrolować źródło wariancji

Dwa porównania

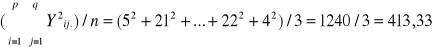

Obliczono wariancje w obu grupach:

Obliczono wariancję całkowitą (s2C):

Obliczono wariancję wewnątrzgrupową (s2W) definiowaną jako średnia wariancji poszczególnych grup (tu: a1 i a2):

Obliczono wariancję międzygrupową (s2M) definiowaną jako średnia suma kwadratów odchyleń poszczególnych średnich grupowych (Y1. i Y2.) od średniej całkowitej (Y..):

Wychodząc z równania:

Izolacyjny vs interakcyjny wpływ zmiennych

Prostoliniowość vs krzywoliniowość

Historia - pokazuje co się dzieje na zewnątrz

Dojrzewanie - jeśli prowadzimy badania na dzieciach, musimy uwzględnić ich rozwój

Selekcja - działa tam, gdzie nie ma randomizacji

Testowanie - dwukrotne badanie może uwrażliwiać i wyuczać

Instrumentacja

Regresja statystyczna

Utrata osób badanych

Interakcja selekcji z: historią, dojrzewaniem, instrumentacją

Przenikanie informacji związanych z postępowaniem eksperymentalnym z grupy do grupy, albo imitowanie postępowania eksperymentalnego

Kompensujące, programowe zróżnicowanie grup porównawczych, wyrównanie ich traktowania

Kompensowanie mniej pożądanych warunków i spowodowane nim rywalizacyjne zachowanie się osób badanych

Obrażanie się osób badanych, które znalazły się w mniej pożądanych warunkach

Interakcja selekcji z postępowaniem eksperymentalnym

Interakcja warunków badania z postępowaniem eksperymentalnym

Interakcja historii z postępowaniem eksperymentalnym

Interakcja pretestu Y z postępowaniem eksperymentalnym

Musi być sprawdzona

Musi być skonfrontowana z zebranymi już danymi

Jeśli teoria jest sprawdzona to możemy tworzyć z niej zmienne i pewne założenia

Nasza hipoteza musi być osadzona na gruncie sprawdzonej teorii

W takim modelu tylko jeden x może wpływać na jeden y (1x -> 1y)

W takim modelu x może być tylko dwuwartościowy (1x -> {0,1}

Możemy badać zależność tylko liniowo

Nie można robić interakcji (AB) -> Y

M - Część, która została wywołana systematycznie ale odmiennie w grupach (zróżnicowanie międzygrupowe); wielkość zróżnicowania jest oddana za pomocą wariancji międzygrupowej

W - Wariancja wewnątrzgrupowa - zróżnicowanie mierzone wewnątrz grupy

Międzygrupowe

Wewnątrzgrupowe

= Y.. μ

= Yi. - Y.. α

= Yik - Yi. εTabela ANOVA - żeby się dowiedzieć czy test F ≥ Fα to odrzucamy H0 na rzecz H1

HSD Tuckey`a aby porównać:

μ1 z μ2

μ2 z μ3

μ3 z μ1

wariancja:

var (Y/A) = ? ( jaki % wariancji tłumaczy czynnik A)

var (Y/e) = ? e - terror (jaki % wariancji tłumaczy błąd)

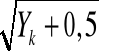

Transformacja pierwiastkowa - tę już wyżej objaśniliśmy. Kiedy się nią posłużyć? Jedna tylko uwaga techniczna, gdy w zbiorze danych występują wyniki mniejsze od 10, to wówczas posłużymy się nieco zmodyfikowanym wzorem:

Transformacja logarytmiczna:

Transformacja ilorazowa:

A

B

AB

jest ၠY...

= ၭi.. - ၭ... czyli efektu i-tego poziomu czynnika A jest różnica: ၠYi.. - ၠY...

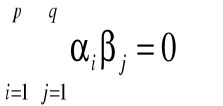

= ၭ.j. - ၭ... czyli efektu j-tego poziomu czynnika B jest różnica: ၠY.j. - ၠY...Efekt αi

Efekt βj

Efekt αiβj

Brzegową kolumnową

Brzegową wierszową

Całkowitą

średniej ogólnej (ၠY...), która jest średnią z próby losowo pobranej z populacji o średniej ၭ

odchylenia średniej z i-tej grupy (ၠYi..) od średniej ogólnej (ၠY...), czyli:

ၠYi.. - ၠY...odchylenia średniej z j-tej grupy (ၠY.j.) od średniej ogólnej (ၠY...), czyli:

ၠY.j. - ၠY...odchylenia średniej ij-tej grupy (ၠYij.) od średnich brzegowych: ၠYi.. , ၠY.j. oraz średniej ogólnej ၠY..., czyli: ၠYij. - ၠYi.. - ၠY.j. + ၠY...

odchylenia k-tej osoby z ij-tej grupy (Yijk) od średniej ij-tej grupy, czyli:

Yijk - ၠYij.Ta sama zmienna jest badana u tej samej osoby kilkakrotnie i dlatego może to doprowadzić do wyćwiczenia, wyuczenia się

Wprowadzamy drugie źródło wariancji - różne osoby różnie reagują na kolejność pomiarów

Zmienna wyjaśniana Y (objaśniana)Zmienna wyjaśniająca X (objaśniająca)

Zm. na interwałowym poziomie

Zm. na ilorazowym poziomie

Skala nominalna:

Dla modelu 2x2 df=1 -> φ-Yule`a i Q-Kendala

Dla tabel większych niż 4 pola -> C-Pearsona (max. Wartość wynosi tu 1)? i T-Czuprowa (wartości przyjmują od <0,1> -> najlepiej od razu przekształcać C na T)

Dla tabel większych niż 4 pola, ale jest ona dla zmiennych ciągłych dychotomizowanych - > V-Cramera

Skala porządkowa - te współczynniki wymagają przeprowadzenia randomizacji ->

skala ilościowa - dla prostoliniowa -> r-Pearsona; dla krzywoliniowych -> η2

współczynnik korelacji cząstkowej (p)

współczynnik korelacji semicząstkowej (s)

Psychologiczna natura zmiennych

Postać związku Y z X-ami (przyjmujemy, że związek ma charakter liniowy)

Model ANOVA/MR

Lin. vs. ~lin. (liniowy vs. Nieliniowy)

Addytywność (model z interakcją i bez interakcji)

Trafność modelu:

I. (model stały)Status motywacyjny OB (od przymusu do statusu ochotnika)

Lęk przed oceną

Wskazówki sugerujące hipotezę (osoba badana umie odczytać intencje badacza)

Nastawienia badacza (badacze nieświadomie odczytują intencje badacza)

SEM = SD * √ 1- rtt

SD - odchylenie standardowe

r - rzetelność

KONTEKST INTERAKCJI

Między badaczem a osobą badaną zawiązuje się interakcja, która może mieć wpływ na wyniki.

BADACZ - OSOBA BADANA

Zmienne można podzielić na:

Osoby do grup powinny być przydzielane w sposób losowy (randomizacja)

Randomizacja - określa nam sposób manipulowania zmiennymi. Zawsze przydzielaj osoby losowo by zminimalizować czynnik wpływ badanych. Manipulowanie zmienną za pomocą randomizacji jest wpisane w eksperyment.

Quazi eksperyment - brak randomizacji

Dwa modele - Bowy:

Addytywność efektu - efekty się dodają

Problem addytywności - np. problem kultura - dziedziczność

Dwa modele:

Modele ANOVA mogą być w 3 modelach:

Hipoteza może być trafna bądź nietrafna.

η2 - zmiana zależności krzywoliniowych

r Pearsona - model liniowy

Mechanizm Losowy - tablice liczb losowych potrzebne są w randomizacji:

01 Adam Mickiewicz

02 Henryk Sienkiewicz

.

.

.

014 Stefan Żeromski

00 Bolesław Prus

Pracujemy na 2 poziomach:

Musimy wiedzieć, co jest populacją (określa co badamy).

Określamy próbę, od której składu zależy jakość badania.

A efektem badania naukowego jest rezultat badawczy.

WYKŁAD II

Zadania badacza:

Porównania - międzygrupowe (ang. between) i wewnątrzgrupowe (ang. within)

pretest (e) |

Ⴌdane zależneႮ (porównania wewnątrzgrupowe) |

posttest (e) |

Ⴏ dane niezależne Ⴍ (porównania międzygrupowe)

|

|

Ⴏ dane niezależne Ⴍ (porównania międzygrupowe) |

pretest (k) |

Ⴌdane zależneႮ (porównania wewnątrzgrupowe) |

posttest (k) |

Pretest - przed wprowadzeniem manipulacji

Postest - po wprowadzeniu manipulacji

W porównaniu wewnątrzgrupowym - porównywanie tych samych osób, wynikiem są dane zależne.

W porównaniu międzygrupowym - porównywanie różnych osób, są źródłem danych niezależnych.

Badacz identyfikuje rodzaj porównań w badaniu, np:

b1 b2 b3 b4 b5

a1 lek |

1 |

2 |

3 |

4 |

|

|

|

|

|

|

|

|

|

|

|

|

|

a2 lek + psychoterapia |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ANOVA

WARIANCJA CAŁKOWITA

max min

varC[T]y = varM [B] + varW[w]

varc - wariancja całkowita (całkowita zmienność wyników)

varM - wariancja międzygrupowa, wariancja kontrolowana

varW - wariancja wewnątrzgrupowa, wariancja błędu, wariancja niekontrolowana

Wariancja będzie zerowa, gdy dwie grupy upodobniają się do siebie

Im wyniki między grupami się bardziej różnią, tym wariancja jest wyższa.

Porównania wewnątrzgrupowe - różnice indywidualne

Badacz tak konstruuje badanie by maksymalizować wariancję między grupami, a minimalizować wariancję wewnątrzgrupową.

vary = varM + varW

100% ?% ?%

varM varM

(od kobiet) (od mężczyzn)

Badacz powinien przy projektowaniu badania zadbać o to, by osoby wewnątrz grupy były do siebie podobne (by zminimalizować wariancję wewnątrzgrupową)

Aby jak najwięcej różnic było wyjaśniane przez rolę czynnika eksp. Wariancja międzygrupowa powinna być jak największa.

Badanie polega na kontroli wariancji między i wewnątrzgrupowych. Jeżeli zróżnicowanie wewnątrzgrupowe jest duże, to może świadczyć, że na badanie ma wpływ inny czynnik (np. kawa wypita w domu, o której eksperymentator nie wiedział, a miała wpływ na wynik eksperymentu).

Im bardziej duże zróżnicowanie ą grupy wewnątrz, tym gorzej dla eksperymentu - na badanych ma działać przede wszystkim zmienna, którą manipulujemy.

Test istotności = varM6 / varW6

Każdy wynik - średnia = 0 -> grupy idealnie jednorodne

Przykład:

I

a2 |

a2 |

L |

A |

2 |

4 |

1 |

9 |

7 |

16 |

3 |

7 |

a2 |

a2 |

L |

A |

1 |

4 |

2 |

5 |

2 |

5 |

1 |

4 |

_

y1.=3,25

Gdy grupa jest liczna to skrajne wyniki mniej zafałszowują wyniki.

Średnia odcięta - obcina 5% skrajnych wyników i liczy średnią z 95%

Najlepiej dobierać osoby, które pod względem zmiennych ubocznych mają podobne wariancje.

Badanie polega na kontroli wariancji wewnątrzgrupowej i międzygrupowej !!

Obliczenia przebiegają wg etapów:

s21 = Σy2/n1 = 4/5 = 0,80

s22 = Σy2/n2 = 80,80/5 = 16,16

i odchylenia standardowe w obu grupach:

s1 = √ s21 = 0,89

s2 = √ s22 = 4,02

s2C = Σy'2/n = 168,90/10 = 16,89

s2W = (s21 + s22)/2 = (0,80 + 16,16)/2 = 16,96/2 = 8,48

s2M = [(Y1. - Y..)2 + (Y2. - Y..)2]/2 =

[(7 - 9,9)2 + (12,8 - 9,9)2]/2 = 8,41

s2C = s2M. + s2W

można obliczyć procentowy udział poszczególnych wariancji cząstkowych w wariancji całkowitej.

Jeżeli przyjmiemy, że całkowita zmienność wyrażona za pomocą wariancji całkowitej wynosi 100%, to jej dwie składowe (wariancje cząstkowe) wynoszą:

s2M = (8,41/16,89)100% = 49,80%

s2W = (8,48/16,89)100% = 50,20%

SYSTEM KROPKOWY

Osoby |

Grupa a1 |

Grupa a2 |

Sumy |

. . . y.1

. . . y.2

. . . y.3

. . . y.4

Sumy |

y1. |

y2. |

y.. |

y.1 - suma wyników osoby (wersowa)

y1. - dodajemy do siebie wyniki wszystkich osób z grupy pierwszej (kolumnowa)

y.. - suma sum

Osoby |

Grupa a1 |

Grupa a2 |

Sumy |

1 |

2 |

4 |

|

2 |

3 |

6 |

|

3 |

1 |

5 |

|

Sumy |

|

|

|

|

Grupa a1 |

Grupa a2 |

Sumy |

1 |

Y11 = 2 |

Y21 = 4 |

Y.1 = 6 |

2 |

Y12 = 3 |

Y22 = 6 |

Y.2 = 9 |

3 |

Y13 = 1 |

Y23 = 5 |

Y.3 = 6 |

Sumy |

Y1. = 6 |

Y2. = 15 |

Y.. = 21 |

Osoby |

a1 |

a2 |

Sumy |

||

|

b1 |

b2 |

b1 |

b2 |

|

1 |

Y111 = 2 |

Y121 = 3 |

Y211 = 1 |

Y221 = 4 |

Y..1 = 10 |

2 |

Y112 = 1 |

Y122 = 2 |

Y212 = 1 |

Y222 = 3 |

Y..2 = 7 |

3 |

Y113 = 2 |

Y123 = 4 |

Y213 = 2 |

Y223 = 4 |

Y..3 = 12 |

Sumy |

Y11. = 5 |

Y12. = 9 |

Y21. = 4 |

Y22. = 11 |

Y... = 29 |

Osoby |

a1 |

a2 |

Sumy |

||

|

b1 |

b2 |

b1 |

b2 |

|

1 |

Y111 = 2 |

Y121 = 3 |

Y211 = 1 |

Y221 = 4 |

Y..1 = 10 |

2 |

Y112 = 1 |

Y122 = 2 |

Y212 = 1 |

Y222 = 3 |

Y..2 = 7 |

3 |

Y113 = 2 |

Y123 = 4 |

Y213 = 2 |

Y223 = 4 |

Y..3 = 12 |

Sumy |

Y11. = 5 |

Y12. = 9 |

Y21. = 4 |

Y22. = 11 |

Y... = 29 |

Osoby |

a1 |

a2 |

Sumy |

||

|

b1 |

b2 |

b1 |

b2 |

|

1 |

Y111 = 2 |

Y121 = 3 |

Y211 = 1 |

Y221 = 4 |

Y..1 = 10 |

2 |

Y112 = 1 |

Y122 = 2 |

Y212 = 1 |

Y222 = 3 |

Y..2 = 7 |

3 |

Y113 = 2 |

Y123 = 4 |

Y213 = 2 |

Y223 = 4 |

Y..3 = 12 |

Sumy |

Y11. = 5 |

Y12. = 9 |

Y21. = 4 |

Y22. = 11 |

Y... = 29 |

Osoby |

a1 |

a2 |

Sumy |

||

|

b1 |

b2 |

b1 |

b2 |

|

1 |

Y111 = 2 |

Y121 = 3 |

Y211 = 1 |

Y221 = 4 |

Y..1 = 10 |

2 |

Y112 = 1 |

Y122 = 2 |

Y212 = 1 |

Y222 = 3 |

Y..2 = 7 |

3 |

Y113 = 2 |

Y123 = 4 |

Y213 = 2 |

Y223 = 4 |

Y..3 = 12 |

Sumy |

Y11. = 5 |

Y12. = 9 |

Y21. = 4 |

Y22. = 11 |

Y... = 29 |

Y

Y

i k A B K

A= a1,…..,ai,……ap

B= b1,……bj,……bq

Np. Y2 2 1

Osoby |

a1 |

a2 |

Sumy |

||

|

b1 |

b2 |

b1 |

b2 |

|

1 |

Y111 = 2 |

Y121 = 3 |

Y211 = 1 |

Y221 = 4 |

Y..1 = 10 |

2 |

Y112 = 1 |

Y122 = 2 |

Y212 = 1 |

Y222 = 3 |

Y..2 = 7 |

3 |

Y113 = 2 |

Y123 = 4 |

Y213 = 2 |

Y223 = 4 |

Y..3 = 12 |

Sumy |

Y11. = 5 |

Y12. = 9 |

Y21. = 4 |

Y22. = 11 |

Y... = 29 |

Kropka oznacza zsumowanie wyników w obrębie grupy

Dwie kropki oznaczają sumę sum

Y2.2

Z analizy odchyleń badacz otrzymuje dodatkowe informacje na temat zmiennych, których nie uwzględniał, a które mogą mieć wpływ na wyniki.

Trafność wewnętrzna

Plan E trafny wewnętrznie, to taki plan, który pozwala wyeliminować alternatywne - do ujętych w hipotezie badawczej - wyjaśnienia wariancji zmiennej Y

Badanie jest trafne wewnętrznie gdy badacz wyeliminuje alternatywne wyjaśnienia wariancji (może to zrobić przez randomizacje - czynnik selekcji)

Owe alternatywne wyjaśnienia zmienności Y związane są z czynnikami odnoszącymi się do sposobu organizacji, przebiegu samego badania eksperymentalnego, niespecyficznymi zachowaniami się osób badanych w sytuacji badania eksperymentalnego oraz wpływem czynników z otoczenia fizycznego i społecznego sytuacji badawczej

Warunki od których zależy trafność wewnętrzna planu E:

(1) Plan E powinien być adekwatny do hipotezy (i tak, na przykład, plany „0-1” nie są adekwatne do testowania hipotez zakładających zależność krzywoliniową zmiennej Y od zmiennej X)

Np. prawo Yerkesa - Dowsona

[y]

plan a - ten plan jest nieadekwatny

x - poziom

y - poziom wykonania

[y] a1 a2 x

plan b - plan jest adekwatny

a1 a2 a3 a4 x

Plan musi dawać szanse aby czynnik mógł się ujawnić - plan adekwatny!

Gdy podejrzewamy, że zależność jest krzywoliniowa to musimy mieć minimum 4 grupy

Dwa główne powody nieadekwatności:

(2) Badacz powinien kontrolować wszystkie czynniki mogące mieć - poza zmienną X - wpływ na zachowanie się (także to niespecyficzne) osób badanych w trakcie badania eksperymentalnego

(3) Badacz powinien efektywnie manipulować zmienną X czyli powinien stworzyć takie warunki badania, które zapewnią maksymalizację wariancji zmiennej Y wyjaśnionej oddziaływaniem na tę zmienną postępowania eksperymentalnego X (efekty jego wpływu na Y można będzie oddzielić od „szumu” pochodzącego z pozostałych źródeł).

TRAFNOŚĆ WEWNĘTRZNA - przejawia się w kontroli wariancji międzygrupowej i wewnątrzgrupowej

Trafność zewnętrzna

Trafność zewnętrzna planu E związana jest z pytaniem o zakres wniosków, które badacz sformułował na podstawie wyników uzyskanych z zakończonego badania. Dotyczy ona zakresu generalizacji (uogólniania) tych wniosków.

Do kogo i do jakich warunków możemy odnieść nasz wynik z badania - trafność zewnętrzna

Warunki od których zależy trafność zewnętrzna planu E:

(1) Badacz powinien wiedzieć, czy uzyskane wyniki mogą być podstawą do formułowania uogólnień na całą populację, czy też mogą być jedynie potraktowane jako podstawa do sporządzenia psychologicznego portretu osób z przebadanych grup - eksperymentalnej i kontrolnej

(2) Problem trafności zewnętrznej, to także problem reprezentatywności warunków w których przeprowadzono badanie. Inaczej mówiąc, jest to problem typowości warunków badania dla warunków pozaeksperymentalnych na które będą uogólniane wyniki przeprowadzonego badania eksperymentalnej. (na ile warunki badania imitują warunki rzeczywistości)

(3) Trafność zewnętrzna wyraża się też w następującym pytaniu: czy uzyskiwane przez badacza wartości zmiennych zoperacjonalizowanych nie zniekształcają rzeczywistych wartości zmiennych przysługujących osobom z populacji, które nie będą - w warunkach „życiowych” - przed wprowadzaniem określonego postępowania, wzorowanego na postępowaniu eksperymentalnym, poddawane pretestom

(4) Z trafnością zewnętrzną związany jest też problem czasu w którym badacz przeprowadził badanie.

Nie da się zaprojektować takiego badania, by miało wysoką trafność wewnętrzną i wysoką trafność zewnętrzną!!!

Quasi - eksperyment - bez randomizacji

Ex post facto - np. Po powodzi, zmiany powstały naturalnie

Obserwacja - najbardziej trafna zewnętrznie, ale nic nie kontrolujemy (nie ingerujemy)

trafność wewnętrzna (PRECYZJA badania) |

|||||||||||||||||||

wysoka (+) |

|||||||||||||||||||

|

eksperyment laboratoryjny |

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

eksperyment terenowy |

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

quasi- eksperyment |

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

ex post facto |

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

obserwacja

|

|

|||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|||||

niska (-) wysoka (+) |

|||||||||||||||||||

trafność zewnętrzna (zakres wniosków) |

|||||||||||||||||||

Czynniki zakłócające trafność wewnętrzną

Czynniki zakłócające trafność zewnętrzną

WYKŁAD III

Teoria psychologiczna:

Manipulacja polega na losowym przydzieleniu osób do grup eksperymentalnych.

Istotą eksperymentu jest zasada randomizacji.

I faza rozwoju eksperymentu przypada na lata 20-te (all-or-nothing) - z jakiejś populacji wybierało się pewną próbę i rozdzielało się ją na 2 grupy porównawcze.

Wady modelu all-or-nothing:

Fisher - w latach 20-tych XIX w. opracował nową metodologię badań eksperymentalnych. Ta nowa metodologia najbardziej podkreślała możliwości interakcji (AB -> Y)

ANOVA - analysis of variance ( analiza wariancji) - została wprowadzona przez Fishera

ANOVA - A -> jednoczynnikowa analiza wariancji

ANOVA - AB -> anova dwuczynnikowa

ANOVA - ABC -> analiza trójczynnikowa

Oznaczenia:

Y - zm. Zależna; oznaczamy nią wyniki osób

y - odchylenie wyników osoby od średniej

_

y = Y - Y

Czynnik A jest ustalony dla Y dzięki stosunkowi między do wewnątrz. (str.127)

A, B, C -> zmienne (czynniki) niezależne

A: {a1,…,ai,…,ap} - wartości zmiennej A

B: {b1,…,bj,…,bq} - wartości zmiennej B

C: {c1,…,cz,…,cr}

Np. A: {a1,a2,a3}

a1 - psychoterapia 1

a2 - psychoterapia 2

a3 - psychoterapia 3

n - liczebność grupy

k - od 1 do n, oznaczenia osób (indeksy osób) k-ta osoba k: {1,…,n}

alfabet łaciński - do opisu próby

alfabet grecki - do opisu populacji

ў |

μ |

||

Średnia arytmetyczna z próby |

Średnia arytmetyczna z populacji |

||

r |

ρ |

||

Współczynnik korelacji w próbie |

Współczynnik korelacji w populacji |

||

s |

σ |

||

Odchylenie standardowe w próbie |

Odchylenie standardowe w populacji |

||

s2 |

σ2 |

||

Wariancja w próbie

|

Wariancja w populacji |

||

Indeksy:

Y

i - grupa w której jest osoba

k - k-ta osoba

i, k - indeksy

np. Y27 - siódma osoba z drugiej grupy

Osoby |

|

Sumy osób |

|

|

a1 |

a2 |

|

1 |

Y11 |

Y21 |

Y.1 |

2 |

Y12 |

Y22 |

Y.2 |

3 |

Y13 |

Y23 |

Y.3 |

Sumy grup |

Y1. |

Y2. |

Y.. suma sum |

ANOVA - porównuje wyniki i średnie

Wariancja - miara zmienności w grupie

Im większa różnica wyników, tym większa wariancja wyników.

Jeśli wyniki byłyby identyczne to wariancja byłaby równa zero.

Całkowita zaobserwowana zmienność i obliczona wariancja może być rozbita na 2 składniki:

Porównanie tego `co między' z tym `co wewnątrz' - zostało to stworzone i rozwinięte w modelu eksperymentalnym stworzonym przez Fishera.

Gdy mały mianownik to różnica może się łatwiej ujawnić. Gdy duży mianownik różnica się nie ujawni.

Prowadząc badania eksperymentalne musimy się nastawić na dwojakie porównania:

Maksymalizacja wariancji międzygrupowej.

Minimalizowanie różnicy osób wewnątrz grupy (jednorodność jest bardzo ważna)

Tabela wyników w eksperymencie jednoczynnikowym (A):

Osoby |

Grupa a1 |

Grupa a2 |

Grupa a3 |

1 |

5 |

3 |

9 |

2 |

6 |

2 |

8 |

3 |

4 |

1 |

7 |

Sumy |

15 |

6 |

24 |

Średnia |

5 |

2 |

8 |

Średnia odchylenie w grupie (wariancja międzygrupowa) |

5 - 5 6 - 5 4 - 5 |

3 - 2 2 - 2 1 - 2 |

9 - 8 8 - 8 7 - 8 |

Wariancja międzygrupowa |

5 - 5 |

2 - 5 |

|

Każdy wynik w grupie porównujemy ze średnią w grupie - wariancja wewnątrzgrupowa.

Średnia grupy 1 ze średnią całkowitą + średnia grupy 2 ze średnią całkowitą + średnia grupy 3 ze średnią całkowitą - wariancja międzygrupowa (porównanie każdej średniej grupowej ze średnią całkowitą)

Każdy z wyników odejmujemy (porównujemy) od średniej całkowitej - wariancja całkowita.

STOPNIE SWOBODY

df - mówi ile jest operacji możliwych do wykonania przez badacza

4 = [ 2+4+? ] / 3 ? = 6

4 = [ 3+7+? ] / 3 ? = 2

4 = [ 2+1+? ] / 3 ? = 9

4 = [ 6+5+? ] / 3 ? = 1

Stopnie swobody są addytywne - są dodawalne - jeśli dodam df wewnątrz do df między to wyjdzie df całkowita.

Wewnątrzgrupowa liczba stopni swobody (dfwewnątrz):

Grupa 1: df1 = n - 1, dla: Y1k - Y1. , i = 1,...,n

..........................................................................

Grupa p: df1 = n - 1, dla: Ypk - Y1. , i = 1,...,n

_____________________________________

Dla p grup: df = p(n - 1), czyli:

dfwewnątrz = p(n - 1)

Średnia ogólna (Y..) jest średnią z p średnich grupowych (Yi.). Obliczając sumę p odchyleń średnich grupowych od średniej ogólnej (sumy międzygrupowej) dysponujemy następującą międzygrupową liczbą stopni swobody:

dfmiędzy = p - 1

Obliczamy odchylenia każdego wyniku (Yik) od średniej ogólnej (Y..), a więc: Yik - Y.. W każdej grupie porównawczej mieliśmy n - 1 stopni swobody. W całej próbie złożonej z p grup, po n osób mamy: pn - 1 = N - 1 całkowitą liczbę stopni swobody:

dfcała = pn - 1

Stopnie swobody są addytywne:

pn - 1 = (p - 1) + p(n - 1) = p - 1 + pn - p = pn - 1

Przykład: p = 3, n = 3. Zatem:

dfcała = dfmiędzy + dfwewnątrz

(3)(3) - 1 = 3 - 1 + 3(3 - 1)

8 = 2 + 6

Tabela z spss !!!!!!!

Źródło zmienności (wariancji) |

SS |

df |

MS |

F |

F0,05 |

F0,01 |

Między (A) |

54 |

2 |

27 |

27** |

5,14 |

10,9 |

Wewnątrz (błąd eksperymentalny) |

6 |

6 |

1 |

|

|

|

Cała |

60 |

8 |

|

|

|

|

*p<0,05 **p<0,01

MS = 54 / 2 = 27

MS = 6 / 6 = 1

F obliczeniowe ≥ Fα, dfl, dfm (poziom istotności) -> wtedy wiemy, że A wpłynęło na Y

Wynik takiej, k-tej (k = 1,..., n) osoby przypisanej (losowo!) do i-tej (i = 1,..., p) grupy składa się z trzech elementów:

średniej ogólnej (całkowitej) (Y..), która jest średnią z próby, pobranej losowo z populacji o średniej μ

odchylenia średniej z i-tej grupy (Yi.) od średniej ogólnej) (Y..), czyli: Yi. - Y.. !!

Odchylenia wyniku k-tej osoby z i-tej grupy (Yik) od średniej z i-tej grupy (Yi.), czyli: Yik - Yi. !! Im to jest większe, tym większy wpływ czynnika A

założenia Badaczy:

Y.. jest oszacowaniem średniej populacyjnej μ (jeżeli mało osób to zaburza strukturę wyników)

Yi. - Y.. = yi. jest oszacowaniem odchylenia w populacji:

μi - μ = αi (efekt eksperymentalny - im bardziej średnia grupy różni się od średniej całkowitej, tym większy wpływ czynnika)

Yik - Yi. = yik jest oszacowaniem parametru εik, zwanego błędem eksperymentalnym. (to zanieczyszcza nam wynik)

Model strukturalny wyniku Yik: (na poziomie populacji)

Yik = μ + αi + εik

Ponieważ:

Na poziomie próby model strukturalny wyniku Yik:

Yik = Y.. + (Yi. - Y..) + (Yik - Yi.)

Z tabelki 5 = 5 + ( 5 - 5 ) + ( 5 - 5 )

W małej grupie duży wynik wpływa niedobrze na wyniki.

Folia x 2

WYKŁAD IV

Nam zależy aby F było jak największe.

MS wewnątrz - może zakłócać wyniki

F ≥ Fα

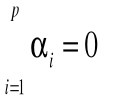

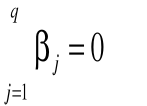

Hipotezy zerowe w ANOVA

H0 : μ1 = μ2 = μ3 = …

p

H0 : Σ αi2 = 0 zapis hipotezy zerowej

i=1

p

H1 : Σ αi2 ≠ 0 zapis hipotezy alternatywnej

i=1

αi = μi - μ

Jeżeli test F nakaże nam odrzucenie H0 nie można na tym poprzestać tylko zrobić test Tuckey`a

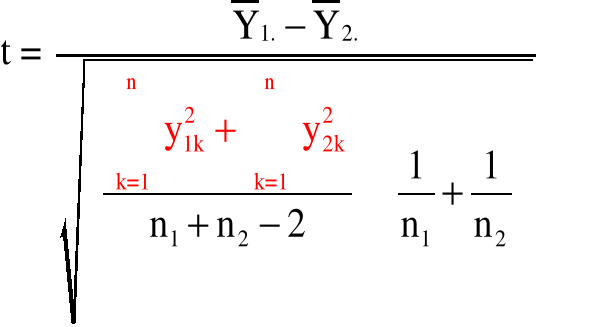

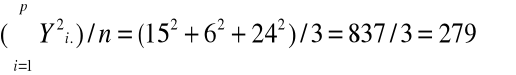

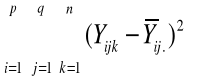

Moduł obliczeniowy do planu jednoczynnikowego (A):

Wyrażenia pomocnicze:

(1) ![]()

(2)

(3)

Z wyrażeń pomocniczych wyliczamy wariancję między, wewnątrz i całkowitą (SS)

Sumy kwadratów (SS):

Między (A): (3) - (1) = 279 - 225 = 54

Wewnątrz (błąd): (2) - (3) = 285 - 279 = 6

Cała: (2) - (1) = 285 - 225 = 60

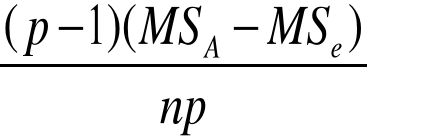

Plan z jednym czynnikiem A

σ2α =

σ2ε = MSe

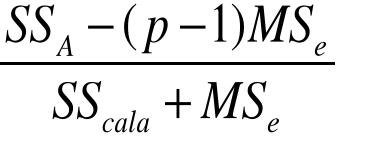

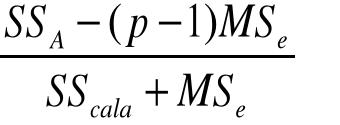

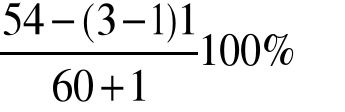

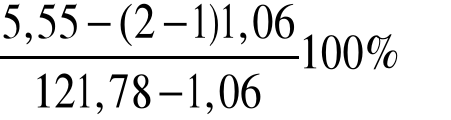

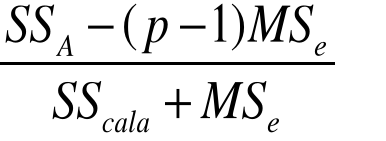

Procentowo wyrażone wielkości wariancji cząstkowej wyjaśnionej wpływem na Y czynnika A można też obliczyć wprost ze wzoru:

ω2A = 100%

Przykład I - ANOVA -A

Wariancja wyjaśniona Y równa się:

ω2A = 100% = = 85,25%

Wariancja nie wyjaśniona Y (błędu) równa się:

100% - 85,25% = 14,75%

Założenia ANOVA - plan jednoczynnikowy (A)

założenie i: Zmienna zależna Y - skala interwałowa.

ZAŁOŻENIE II: Osoby zostały losowo pobrane z populacji do próby

ZAŁOŻENIE III: Osoby z próby zostały losowo przypisane do p grup porównawczych odpowiadających p poziomom czynnika A

ZAŁOŻENIE IV: Ponieważ w i-tej populacji średnia ogólna (μi.) i efekt i-tego poziomu czynnika A (αi) są stałe dla wszystkich osób z tej populacji, więc jedyne co je różni, to nie kontrolowane przez badacza zmienne uboczne i zakłócające, które określamy łącznie nazwą błędu eksperymentalnego (εik). Rozkład εik jest w i-tej populacji normalny ze średnią zero i wariancją ![]()

ZAŁÓŻENIE V: Dwa błędy εik i ε'ik są od siebie niezależne w p populacjach. Mówiąc inaczej chodzi o niezależność pomiarów zmiennej zależnej Y

ZAŁOŻENIE VI: Występujące w liczniku i w mianowniku stosunku F oszacowania wariancji międzygrupowej i wewnątrzgrupowej są niezależne

ZAŁOŻENIE VII: Wariancje w p populacjach wprowadzone przez błąd eksperymentalny są jednorodne (homogeniczne): ![]()

a1 |

a2 |

a3 |

25 5 |

16 4 |

4 2 |

16 4 |

16 4 |

9 3 |

16 4 |

9 3 |

4 2 |

9 3 |

9 3 |

4 2 |

|

|

1 1 |

1947 - Bartlet - praca o wykorzystaniu transformacji wyników

Można te zbiory uczynić bardziej jednorodnymi poprzez wykorzystanie transformacji wyników:

Y` = √Y

transformacja

Y'k =

. Stosujemy ją, gdy rozkład Y jest rozkładem Poissona, jaki ma np. liczba błędów popełnianych przez osoby badane w trakcie rozwiązywania jakiegoś zadania. Stosujemy je także wtedy, gdy wariancje w grupach porównawczych są proporcjonalne do średnich grupowych - gdy między s2i i Yi zachodzi, rzecz jasna, że w przybliżeniu, zależność liniowa.

Y'k = log Yk , a gdy wśród danych występują wyniki zerowe lub bardzo małe, to: Y'k = log (Yk + 1). Jest ona szczególnie przydatna, gdy wynikami są czasy reakcji (dość chętnie przez psychologów mierzone) i gdy ich rozkład jest wyraźnie dodatnio skośny. Posłużymy się nią, gdy wariancje są proporcjonalne do kwadratów średnich grupowych.

Yk = 1/Yk , a gdy wśród danych występują wyniki zerowe, to stosujemy wzór:

Yk= 1/(Yk + 1).

Znajduje ona zastosowanie, gdy zmienną zależną jest czas reakcji czy czas rozwiązywania problemów. Stosujemy przekształcenie ilorazowe, gdy odchylenia standardowe są proporcjonalne do kwadratów średnich.

D. Transformacja arcsin: Y' = 2arcsin

, gdzie Y wyrażony jest pod postacią proporcji.

W miejsce 0 i 1 wstawiamy, odpowiednio,

„1/4n” i „1 - 1/4n”

(n - liczba obserwacji).

Ta transformacja jest zalecana, gdy wyniki wyrażone są pod postacią proporcji, np. proporcja poprawnych odpowiedzi w jakimś teście.

Do każdego charakteru danych dobieramy odpowiednią transformację.

Testy jednorodności wariancji - jeśli grupy są niejednorodne to trzeba dokonać transformacji wyników. Jeśli grupy są jednorodne to pracujemy na uzyskanych w badaniu wynikach.

ANOVA - AB

A : {a1,…,ap}

B : {b1,…,bq}

Osoby badane są traktowane jako kombinacja dwóch wartości a,b

A: |

B: |

|||

|

|

ekspres |

zwykła |

|

|

|

b1 |

b2 |

|

|

a1 |

Ў11. |

Ў12. |

|

|

a2 |

Ў21. |

Ў22. |

Ў2.. |

|

a3 |

Ў31. |

|

Ў3.. |

Ў.1. Ў.2. Ў…

Ў11. - średnia grupy osób, które dostały kawę a1 zaparzona ekspresem.

Y

Y122 - wynik drugiej osoby, która dostała kawę a1 zwykłą

A B h

Średnie kratkowe - powstają w wyniku działania na osobę dwóch wartości.

Ў.1. - cały czynnik A na poziomie b1

Ў.2. - cały czynnik na poziomie b2

N = pgn = 3*2*3 = 18 (osób badanych)

p - poziom A

q - poziom B

Najważniejsze w badaniu AB jest sprawdzenie interakcji.

Tabela wyników w eksperymencie dwuczynnikowym (AB): p = 3; q = 2; n = 3; N = 18

A |

Osoby |

B |

|

|

|

b1 |

b2 |

a1 |

1 |

2 |

7 |

|

2 |

1 |

5 |

|

3 |

2 |

9 |

a2 |

1 |

6 |

2 |

|

2 |

5 |

2 |

|

3 |

4 |

3 |

a3 |

1 |

7 |

1 |

|

2 |

8 |

1 |

|

3 |

7 |

2 |

Sumy kratkowe i brzegowe - do analizy efektów prostych

A |

B |

||

|

b1 |

b2 |

Yi.. |

a1 |

5 |

21 |

26 |

a2 |

15 |

7 |

22 |

a3 |

22 |

4 |

26 |

Y.j. |

42 |

32 |

74 |

Średnie kratkowe - do wykreślenia profilów efektów prostych

A |

B |

||

|

b1 |

b2 |

Yi.. |

a1 |

1,7 |

7 |

4,3 |

a2 |

5 |

2,3 |

3,6 |

a3 |

7,3 |

1,3 |

4,3 |

Y.j. |

4,6 |

3,5 |

4,1 |

Każdy wynik porównujemy ze średnią grupy - porównanie wewnątrzgrupowe

Porównanie międzygrupowe rozbijamy na szczegółowe źródła między:

Średnią kratkową ze średnią kolumny b1 i b2

Średnią kartkową ze średnią wierszową a1 itd.

Folia - ANOVA AB spss

|

|

|

|

|

Cała SScała |

|

|

|

|||

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Między osobami SSmiędzy |

|

|

Wewnątrz osób SSwewnątrz |

||||||

|

|

|

|

|

|

||||||

|

|

|

|

|

|

||||||

|

|

|

|

|

|

||||||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

A SSA |

|

B SSB |

|

AB SSAB |

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|||

|

|

|

|

|

|

|

|

|

|

|

|

sumy kwadratów |

|

|

|

|

|

|

|

|

|

||

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

||

|

|

|

|

Całkowita liczba stopni swobody npq - 1 |

|

|

|||||||||||

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|||||||||||

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

||||||||

|

Między pq - 1 |

|

|

Wewnątrz pq(n-1) |

|||||||||||||

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|||||||||||||

|

|

|

|

|

|

|

|

|

|

||||||||

|

|

|

|

|

|

|

|

|

|

||||||||

A p - 1 |

|

B q - 1 |

|

AB (p - 1) (q - 1) |

|

|

|

||||||||||

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

||||||||||

|

|

|

|

|

|

|

|

|

|

||||||||

stopnie swobody

Podział całkowitej sumy kwadratów (SS) i

całkowitej liczby stopni swobody (df) w planie dwuczynnikowym (AB)

Dla trójczynnikowego ABC

Między

A

B

C

AB

BC I - pierwszego rzędu

AC

ABC - II

Wewnątrz

Cała

Sumaryczna tabela ANOVA dla planu dwuczynnikowego (AB): p = 3, n = 3, q = 2

źródło zmienności (wariancji) |

SS |

df |

MS |

F |

F0,05 |

F0,01 |

A |

1,78 |

2 |

0,89 |

0,84 |

3,49 |

5,95 |

B |

5,55 |

1 |

5,55 |

5,24∗ |

4,75 |

9,33 |

AB |

101,78 |

2 |

50,89 |

48,00∗∗ |

3,49 |

5,95 |

WEWNĄTRZ (błąd eksper.) |

12.67 |

12 |

1,06 |

|

|

|

CAŁA |

121,78 |

17 |

|

|

|

|

∗ p < 0,05 ∗∗ p < 0,01

Źródło zmienności (wariancji) |

SS |

df |

MS |

F |

F0,05 |

F0,01 |

A |

|

|

|

|

|

|

B |

|

|

|

|

|

|

AB |

|

|

|

|

|

|

Cała |

|

|

|

|

|

|

Wewnątrz (błąd eksperymentalny) |

|

|

|

|

|

|

Cała |

|

|

|

|

|

|

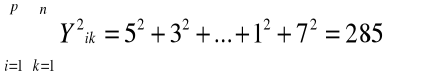

Moduł obliczeniowy do planu dwuczynnikowego (AB):

Wyrażenia pomocnicze:

Sumy kwadratów (SS):

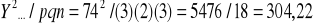

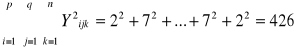

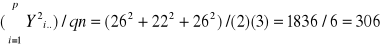

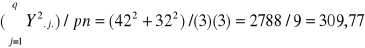

A (3) - (1) = 306 - 304,22 = 1,78

B (4) - (1) = 309,77 - 304,22 = 5,55

AB (5) - (3) - (4) + (1) = 413,33 - 306 - 309,77 + 304,22 = 101,78

Wewnątrz (reszta) (2) - (5) = 426 - 413,33 = 12,67

cała (2) - (1) = 426 - 304,22 = 121,78

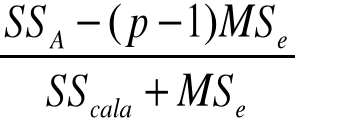

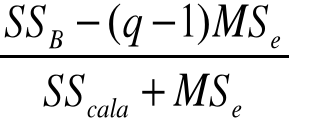

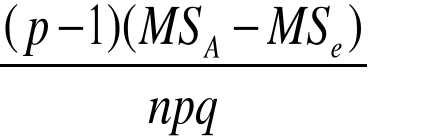

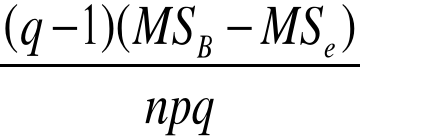

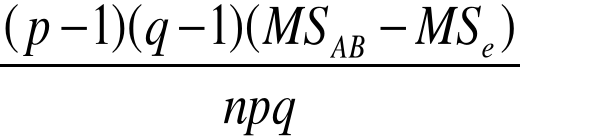

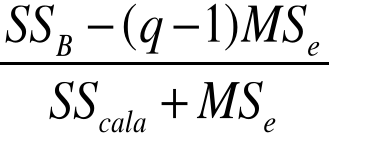

Plan z dwoma czynnikami A i B

σ2α =

σ2β =

σ2αβ =

σ2ε = MSe

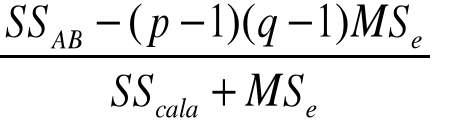

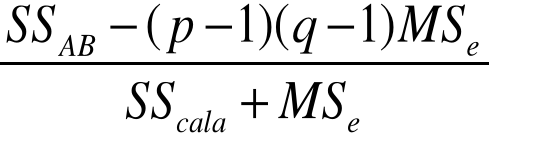

Procentowo wyrażone wielkości wariancji cząstkowej wyjaśnionej wpływem na Y czynników: A oraz B i ich interakcji AB można też obliczyć wprost ze wzoru:

ω2A = 100%

ω2B = 100%

ω2AB = 100%

Oszacowaniami:

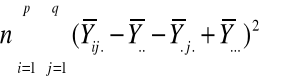

(4) ![]()

= ၭij. - ၭ... - ၡi - ၢj =

ၭij. - ၭ... - (ၭi.. - ၭ... ) - (ၭ.j. - ၭ...) =

ၭij. - ၭi.. - ၭ.j. + ၭ...

czyli efektu interakcyjnego i-tego poziomu czynnika A z j-tym poziomem czynnika B jest wyrażenie: ၠ

Yij. - ၠYi.. - ၠY.j. + ၠY...

(5) ၥijk czyli błędu eksperymentalnego jest różnica: Yijk - ၠYij.

Model ijk-tego wyniku - na poziomie populacji :

Yijk = ၭ + ၡi + ၢj + ၡiၢj + ၥijk

Wynik ijk-tej osoby, na poziomie próby:

Yijk = ၠY... + [(ၠYi.. - ၠY...) + (ၠY.j. - ၠY...) +

(ၠYij. - ၠYi.. - ၠY.j. + ၠY...) + (Yijk - ၠYij.)]

Odchylenie pojedynczego wyniku od średniej ogólnej:

Yijk - ၠY... = [(ၠYi.. - ၠY...) + (ၠY.j. - ၠY...) +

(ၠYij. - ၠYi.. - ၠY.j. + ၠY...) + (Yijk - ၠYij.)]

Podnosząc obie strony równania do kwadratu:

SScała = SSA + SSB + SSAB + SSbłąd

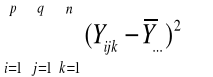

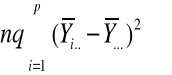

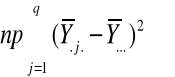

SScała =

SSA =

SSB =

SSAB =

SSbłąd =

Średnia kratkowa porównywana jest ze średnią:

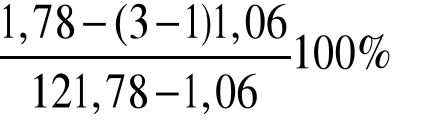

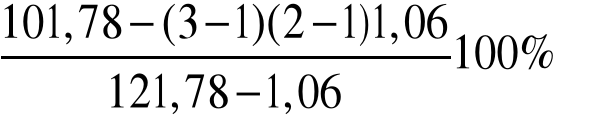

Przykład II - ANOVA - AB

ω2A = 100% = = -0,0028 ≈ 0%

ω2B = 100% = = 3,72%

ω2AB = 100% = = 82,55%

Wariancja wyjaśniona zmiennej Y wynosi:

0% + 3,72% + 82,55% = 86,27%;

pozostała jej część, tj. 100% - 86,27% = 13,73%,

to wariancja niewyjaśniona (resztowa) zmiennej Y.

folia - oszacowanie średnie brzegowe

Wykład V

|

B |

|

|

|

b1 |

b2 |

|

a1 |

|

|

Ў1.. |

|

|

Ў22. |

|

a3 |

Ў31. |

Ў32. |

Ў3.. |

|

|

|

Y…

|

Mamy tu 3 efekty główne czynnika A i 2 efekty główne czynnika B i 6 prostych efektów głównych.

αi = 3

βj = 2

αiβj = 6

By zdefiniować efekty główne α i β to porównujemy np. Ў21. z Ў2.. (efekt α) oraz Ў21. z Ў.1. (efekt β)

Efekt interakcyjny - średnia kratkowa, średnia kolumnowa i średnia całkowita, średnia wierszowa

ANOVA - AB - sumy kwadratów

Wynik k-tej osoby przypisanej (losowo!) do ij-tej

(i = 1, ..., p; j = 1, ..., q) grupy tworzy liniową kombinację elementów:

Przykład 1:

a1 - podstawowe

a2 - średnie

a3 - wyższe

b1 - wieś

b2 - małe miasto

b3 - duże miasto

A - wykształcenie

B - miejsce zamieszkania

C - atrakcyjność serialu m jak miłość

A: {a1, a2, a3}

B: {b1, b2, b3}

C: {0,…,9}

|

b1 |

b2 |

b3 |

a1 |

9 |

|

|

a2 |

2 |

5 |

8 |

a3 |

5 |

9 |

|

Jeśli profile są do siebie równoległe to jest brak interakcji!!!

Kiedy profile się krzyżują to jest silna interakcja (interakcja krzywowa - najsilniejsza)

Gdybyśmy mieli tylko średnią to stracilibyśmy ważne informacje ilościowe.

Przykład 2:

A: {a1, a2}

B: {b1, b2, b3}

Ў: {0,…,7}

|

b1 |

b2 |

b3 |

a1 |

6 |

|

|

a2 |

2 |

4 |

|

Przykład 3

ABC

AB

BC

AC

Folia 36

A/ bj - wpływ czynnika A na poszczególnych poziomach czynnika b

Test hsd - by odróżnić pary istotne od par nieistotnych (które pary w efektach są istotne)

Model efectives > wysoki poziom trafności zewnętrznej, a niski poziom trafności wewnętrznej. Jest to eksperyment naturalny,

W eksperymencie laboratoryjnym > wysoki poziom trafności wewnętrznej, a niski poziom trafności zewnętrznej.

PLANY Z POWTARZANIEM POMIARÓW ZM. ZALEŻNEJ

Osoba trafia na wszystkie poziomy czynnika - eksperyment z powtarzaniem pomiarów

Czynnik powtarzany - wszystkie poziomy tego samego czynnika są eksponowane każdej osobie

Niebezpieczeństwa eksperymentu z powtarzanymi pomiarami:

MODEL KORELACYJNY (REGRESJI)

Nie ma efektu przyczynowo - skutkowego. Możemy mówić tylko o współzmienności

Osoby |

Y |

1 |

2 |

|

1 |

|

|

|

|

2 |

|

|

|

|

… |

|

|

|

|

Wykład VI

Szukanie związku 2 zmiennych - model korelacyjny

Wersja I

Wersja II

Y.1234…..

Model, który ma 1 zmienną wyjaśnianą i …. Zmiennych wyjaśniających (tu np. 4 zmienne)

Postać geometryczna modelu:

Każda zmienna w modelu ( i zmienna wyjaśniająca i zmienna wyjaśniana) mogą być traktowane jako osobny wymiar.

Badacz szuka linii prostek która najlepiej by pasowała do punktów (linia dobrze wpasowana). Szukamy takiej linii do której wszystkie punkty będą najbliżej.

Kryterium (rozwiązanie) najmniejszych kwadratów:

d - odległość punktu od lini

Trzeba znaleźć takie położenie linii aby uzyskać jak najmniejszą sumę (d1+d2+d3…..=min)

Równanie regresji liniowej:

Y`=bX+a

Y` - wartości wyliczone z modelu

b - współczynnik prostej regresji b

a - stała regresji

a - w którym miejscu prosta przecina się z prostą Y

b - pokazuje nachylenie

Y`=0,6708X1

Y`=0,6708X1 - 11,25

Transformacja:

Y`=bX+a

Y`=βx - wersja standaryzowana

Y`= by1.2X1 + by2.1X2 + a

Z`= by1.2z1 + by2.1z2 + a - zapis standaryzowany

Zj = xj - xj

Sj

βy1.2 = by1.2 * S1/Sy

βy2.1 = by2.1 * S1/Sy

ta zmienna, która ma wyższą wartość β to ma większy wpływ na korelację.

r=β β:<-1,+1>

by1.2 + by2.1

2 ZMIENNE:

rk - Kendala i rs - Spearmana

Mówimy tu o płaszczyźnie najmniejszych kwadratów.

Płaszczyzna najmniejszych kwadratów - najprostszy model

By suma kwadratów odległości punktów od płaszczyzny dawała minimum

βy1.2 = by1.2 * S1/Sy

βy2.1 = by2.1 * S1/Sy

R2y.12= βy1.2ry1 + βy2.1ry2

k

R2y.1…k = Σ βj ryj wzór na współczynnik korelacji wielokrotnej

j=1

ry1 r2y1

Ry.123… R2y.123

Tylko gdy r12 = 0 można:

R2 - mówi nam jaka jest łączna wartość wyjaśniająca - ale nie mówi nam o czystym wkładzie jednej zmiennej i drugiej zmiennej do wariancji.

Współczynniki korelacji cząstkowej dzielą się na:

Można się nimi posłużyć aby sprawdzić jak jest czysty wpływ zmiennych na wariancje.

Badanie empiryczne

kontekst

teorii psychologicznej

kontekst

modelu statystycznego

II. (model losowy)

III. (model mieszany)

kontekst interakcji:

„badacz - OB”

kontekst modelu

pomiarowego

Y i X-ów

1. Skala pomiarowa Y i X-ów (nominalna, porządkowa, interwałowa, ilorazowa)

2. Model psychometryczny:

A - Gulliksen/Lord i Novick (wynik, który obserwujemy składa się z 2 części: wyniku nieobserwowalnego i części błędu)

B - SEM (błąd standardowy pomiaru)

C - Estymacja przedziałowa

D - Trafność teoretyczna (zgodność z teorią) przy pomocy:

Macierz WCWM

To daje nam wynik

obserwowalny

Nastawienie na współpracę z badaczem

Percepcja celu badania przez osobę badaną

Obraz instytucji zatrudniającej badacza

Doświadczenie badawcze osoby badanej

Właściwości psychiczne

osoby badanej

Czynniki modyfikujące wstępne oczekiwania

Źródła

wstępnych

oczekiwań

Otoczenie

społeczne

Osoba

badana

Cel

badania

Kompetencje profesjonalne

Właściwości psychiczne

Zachowanie osoby badanej

Lęk

przed oceną

Wskazówki sugerujące hipotezę

Status motywacyjny

Osoba

badana

Zachowanie badacza

Wydajność

badacza

Wkład

pracy

Klimat

emocjonalny

Sprzężenie

zwrotne

Ustalone oczekiwania

+ lub -

Modyfikacja wstępnych oczekiwań

Wstępne

oczekiwania

Badacz

trafna

(odrzucenie nietrafnej hipotezy)

Błąd B (pozostawienie nietrafnej hipotezy)

trafne

trafny

nietrafna

Hipoteza

trafna

I. Hipoteza

trafna

(akceptacja trafnej hipotezy)

BłĄd A

(odrzucenie trafnej hipotezy)

?

trafny

trafne

nietrafne

IV. Decyzja

II. Badanie

III. Rezultat badawczy (RB)

REZULTAT BADAWCZY

RB

PRÓBA

n

POPULACJA

N

n ြြ N

TRAFNOŚĆ

ZEWNĘTRZNA

TRAFNOŚĆ WEWNĘTRZNA

DOBÓR PRÓBY

generalizowanie

badanie naukowe

Poziom

próby

poziom

populacji

cola

redbull

kawa

00, 04, 12, 11, 14, 08, 05, 02, 03, 09, 10

?

nietrafne

B

Porównania międzygrupowe

Te różnice są wynikiem wariancji cząstkowej

Nie ma różnicy np. mleko łaciate vs niełaciate

Na to badacz ma wpływ

df = n1 + n2 - 2

_

yik = Yi - Yik (odchylenie każdego wyniku)

y - odchylenie od średniej każdego wyniku od średniej grupy

Gdy mianownik mniejszy to całość większa.

Kiedy suma się zmniejsza to zmniejsza się mianownik

Średnie grupy 1 i 2

Zróżnicowanie względem 1 grupy

Zróżnicowanie względem 2 grupy

varW

II

Grupy jednorodne

_

yik=Yi-Yik

y11=3,25-2=1,25

y12=3,25-1=2,25

y13=3,25-7=-4,25

y14=3,25-3=0,25

Yik - wartość wyniku osoby

yik - średnia grupy

i j k

A - grupa

B - grupa

K - osoba

2- grupa a2

2- grupa b2

1- osoba 1

2- pozycja a2

. - wszystkie b

2 - dla 2 osoby

teoria

praktyka

metoda

ANOVA

POPULACJA

Próba

N

n2

n1

Model ortogonalny - liczebność grup równa

n1 = n2

R - randomizacja

A -> Y

randomizacja

Test t dla studenta

a1

a2

F = M = B

W W

i k

_

Y - 5 wariancja całkowita

Y = 45

Tu mamy dwa stopnie swobody, jeden stopień swobody jest tu sztywno określony, narzucony przez te dwie dobrane wartości.

df wewnątrz = p(n-1)

P = 3 (3-1) = 6 (stopni swobody)

df między = p-1

df cała = PN - 1

SS

n

Σ y2ik -> Yik - Ўi MS = SS

k=1 df

n - 1 -> df

MS - wariancja, SS - suma kwadratów

Cała

SS całe

Między osobami Wewnątrz osób

SS między SS wewnątrz

F = MS między

MS wewnątrz

F = MS między

MS wewnątrz

ANOVA powinna dotyczyć tych wyników (po transformacji)

Będą tu duże odchylenia wewnątrzgrupowe

Sumy mieszane

Średnie kratkowe

Brzegowe kolumnowe

między

n = 3

N = 18

a2

i j k

Y.j.

średni

FA = MSA

MSe

FB = MSB

MSe

FAB = MSAB

MSe

Efekt 2

Efekt 1

β

α

Suma Y21

Y22

(..)

Y2n

MSwew

a1 a2 a3

9

8

7

6

5

4

3

2

1

b2

b1

b3

Jaki jest wpływ czynnika a na wyniki w teście gdy czynnik b przyjmuje wartość b1

Nie ma strzałki

Bo nie ma

ciągłości

Nie ma interakcji

7

6

5

4

3

2

1

b1 b2 b3 B

a1 a2 A

7

6

5

4

3

2

1

C1

C2

a1 a2

b1

b2

b1

b2

AB/C (AB w C)

Wariant II

Klasyczna odmiana (model 1+1)

Analiza kanoniczna My-kX - wariant III

Predykatory - umożliwiają przewidywanie

wariancja

A B

?

?

rAB2(100%) - współczynnik wariancji

rAB=0,60

rAB=36%

Zm. wyjaśniające

N

Σ d2k=min

K=1

Korelacja pełna

r=+1,0

Korelacja pełna

r=-1,0

Brak korelacji

r=0,0

r: <-1,+1>

r-Pearsona

η2

Wielomian (parabola) stopnia drugiego - szukamy tu dopasowania nie za pomoca współczynnika r-Perasona, ale za pomocą eta kwadrat (η2)

Współczynnik a

Współczynnik b

100%

68,26 % wyników mieści się w normie

Numer zm. Wyjaśniającej do której należy ta β

Pozostałe zmienne w modelu

-3α -2α -α η α

Współczynnik b do zmiennej drugiej

[Cz]

x2[IQ]

x2[SSE]

R2y.12 (100%)

Linie transformacyjne

R2 - współczynnik determinacji wielokrotnej

To jest korelacje zmiennej Y z liniową kombinacją zmiennych X1 i X2 (nie jest to korelacja 3 zmiennych!!!)

Współczynniki korelacji - jaka jest siła związku

Współczynniki determinacji - pokazują jaka jest wspólna wariancja

R2y.12 = r2y1 + r2y2

TAK!!! Można zsumować bo predykatory (x1, x2) nie korelują ze sobą a korelują osobno z Y

r12=0

NIE!!! Nie można zsumować reduktorów bo korelacją wyjdzie nam 2 razy większa (bo dwa razy weźmiemy pod uwagę ten sam kawałek)

r12 ≠ 0

a3

a1

Yij.

8

7

6

5

4

3

2

1

b2

b1

Profile efektów prostych:

B | a1, B | a2, B | a3

Yi..

średni

a3

b1

b2

a2

a1

Yij.

8

7

6

5

4

3

2

1

Profile efektów prostych:

A | b1, A | b2

Wyszukiwarka

Podobne podstrony:

Statystyka SUM w4

statystyka 3

Weryfikacja hipotez statystycznych

Zaj III Karta statystyczna NOT st

Metodologia SPSS Zastosowanie komputerów Brzezicka Rotkiewicz Podstawy statystyki

metody statystyczne w chemii 8

Metodologia SPSS Zastosowanie komputerów Golański Statystyki

Statystyka #9 Regresja i korelacja

06 Testowanie hipotez statystycznychid 6412 ppt

BHP STATYSTYKA

Statystyka #13 Podsumowanie

metody statystyczne w chemii 5

STATYSTYKA OPISOWA '

statystyka referat MPrzybyl

statystyka IF cz 5

więcej podobnych podstron