I. Metoda programowania nieliniowego PNL.

Celem Д‡wiczenia jest zapoznanie siД™ z podstawowД… metodД… rozwiД…zywania nieliniowego zadania optymalizacji bez ograniczeЕ„ na przykЕ‚adzie algorytmu optymalizacji lokalnej (algorytm Gauss'a - Seidla lub algorytm Fletchera - Powella - Dawidona) lub algorytmu optymalizacji globalnej (algorytm genetyczny lub algorytm ewolucyjny).

Algorytm optymalizacji lokalnej lub algorytm optymalizacji globalnej pozwala na wyliczenie takiego wektora zmiennych decyzyjnych x, dla ktГіrego funkcja celu osiД…ga minimum:

bez ograniczeЕ„:

--> WstД™p teoretyczny (na postawie informacji zawartych na stronie: http://pl.wikipedia.org)[Author:M]

Algorytm genetyczny to rodzaj algorytmu przeszukujД…cego przestrzeЕ„ alternatywnych rozwiД…zaЕ„ problemu w celu wyszukania rozwiД…zaЕ„ najlepszych. SposГіb dziaЕ‚ania algorytmГіw genetycznych nieprzypadkowo przypomina zjawisko ewolucji biologicznej, poniewaЕј ich twГіrca John Henry Holland wЕ‚aЕ›nie z biologii czerpaЕ‚ inspiracje do swoich prac.

NajczД™Е›ciej dziaЕ‚anie algorytmu przebiega nastД™pujД…co:

Losowana jest pewna populacja poczД…tkowa.

Populacja poddawana jest ocenie (selekcja). Najlepiej przystosowane osobniki biorД… udziaЕ‚ w procesie reprodukcji.

Genotypy wybranych osobnikГіw poddawane sД… operatorom ewolucyjnym:

sД… sobД… kojarzone poprzez zЕ‚Д…czanie genotypГіw rodzicГіw (krzyЕјowanie),

przeprowadzana jest mutacja, czyli wprowadzenie drobnych losowych zmian.

Rodzi siД™ drugie (kolejne) pokolenie i algorytm powraca do kroku drugiego, jeЕјeli nie znaleziono dostatecznie dobrego rozwiД…zania. W przeciwnym wypadku uzyskujemy wynik.

DziaЕ‚anie algorytmu genetycznego obejmuje kilka zagadnieЕ„ potrzebnych do ustalenia:

ustalenie genomu jako reprezentanta wyniku

ustalenie funkcji przystosowania/dopasowania

ustalenie operatorГіw przeszukiwania

--> II. Zadania do wykonania[Author:M]

II.1 Funkcje wypukЕ‚e

1. f(x) = (x1 - 2)2 + (x2 - 2)2

Punkt optymalny: x* = [2, 2]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 0

CzД™Е›Д‡ programowa:

OgГіlne zaЕ‚oЕјenia

Populacja poczД…tkowa: 40 osobnikГіw

WybГіr poczД…tkowej populacji: losowy

KrzyЕјowanie: 60% (przez uЕ›rednianie)

Mutacja: 12%

Zakres zmiennych: x1 = [-5, 5]

x2 = [-5, 5]

PorГіwnanie rodzajГіw selekcji

Selekcja: miД™kka

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 102 generacjach)

Punkt optymalny: x* = [2.035, 2.033]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 2,228 В· 10-3

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

1,384 |

2,114 |

0,393 |

2 |

1,744 |

2,172 |

9,48В·10-2 |

5 |

1,917 |

2,256 |

7,24В·10-2 |

10 |

1,809 |

1,859 |

5,62В·10-2 |

20 |

2,000 |

1,991 |

7,34В·10-3 |

>20 |

2,000 |

1,991 |

7,34В·10-3 |

Punkt optymalny: x* = [2, 1.991]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 7,34 В· 10-3

Selekcja: twarda

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 137 generacjach)

Punkt optymalny: x* = [2, 2]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 0

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

3,311 |

1,750 |

1,782 |

10 |

2,003 |

2,006 |

4,87В·10-5 |

20 |

2,003 |

1,998 |

1,09В·10-5 |

30 |

2,003 |

2,000 |

8,09В·10-6 |

>30 |

2,003 |

2,000 |

8,09В·10-6 |

Punkt optymalny: x* = [2.003, 2]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 8,09 В· 10-6

Selekcja: turniejowa

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 160 generacjach)

Punkt optymalny: x* = [2, 2]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 0

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

1,699 |

2,510 |

0,351 |

10 |

2,003 |

1,999 |

9,47В·10-6 |

20 |

2,000 |

2,000 |

1,22В·10-7 |

30 |

2,000 |

2,000 |

7,98В·10-8 |

40 |

2,000 |

2,000 |

5,81В·10-9 |

50 |

2,000 |

2,000 |

3,60В·10-11 |

>50 |

2,000 |

2,000 |

0 |

Punkt optymalny: x* = [2, 2]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 0

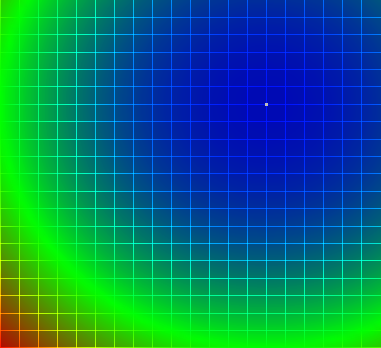

Wizualizacja rozwiД…zania:

CzД™Е›Д‡ analityczna:

f(x) = (x1 - 2)2 + (x2 - 2)2

2. f(x) = 2x12 - 2x1x2 + x22

Punkt optymalny: x* = [0, 0]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 0

CzД™Е›Д‡ programowa:

OgГіlne zaЕ‚oЕјenia

Populacja poczД…tkowa: 40 osobnikГіw

WybГіr poczД…tkowej populacji: losowy

KrzyЕјowanie: 60% (przez uЕ›rednianie)

Mutacja: 12%

Zakres zmiennych: x1 = [-2, 2]

x2 = [-2, 2]

PorГіwnanie rodzajГіw selekcji

Selekcja: miД™kka

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 104 generacjach)

Punkt optymalny: x* = [-1.177В·10-2, 1.159В·10-2]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 1.387 В· 10-4

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

0,266 |

0,582 |

0,171 |

10 |

0,050 |

0,083 |

3,60В·10-3 |

20 |

0,017 |

-0,022 |

1,80В·10-3 |

30 |

0,017 |

-0,022 |

1,80В·10-3 |

40 |

0,003 |

0,043 |

1,67В·10-3 |

70 |

0,011 |

0,023 |

2,71В·10-4 |

>70 |

0,011 |

0,023 |

2,71В·10-4 |

Punkt optymalny: x* = [0.011, 0.023]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 2,71 В· 10-4

Selekcja: twarda

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 137 generacjach)

Punkt optymalny: x* = [4.69В·10-7, 9.39В·10-7]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 4.397 В· 10-13

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

0,061 |

0,520 |

0,214 |

10 |

0,012 |

0,012 |

1,52В·10-4 |

>10 |

0,012 |

0,012 |

1,52В·10-4 |

Punkt optymalny: x* = [0.012, 0.012]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 1,52 В· 10-4

Selekcja: turniejowa

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 160 generacjach)

Punkt optymalny: x* = [1.242В·10-8, 1.425В·10-8]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 1.576 В· 10-16

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

0,064 |

0,429 |

0,137 |

10 |

0,197 |

0,429 |

9,24В·10-2 |

20 |

-0,039 |

-0,062 |

2,04В·10-3 |

30 |

-0,039 |

-0,039 |

1,51В·10-3 |

>30 |

-0,039 |

-0,039 |

1,51В·10-3 |

Punkt optymalny: x* = [-0,039, -0,039]

WartoЕ›Д‡ optymalna funkcji: f(x*) = 1,51 В· 10-3

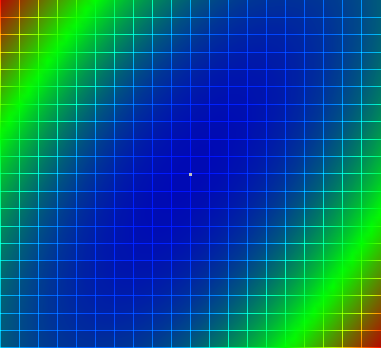

Wizualizacja rozwiД…zania:

CzД™Е›Д‡ analityczna:

f(x) = 2x12 - 2x1x2 + x22

3. f(x) = x12 + x1x2 + 0.5x22 - x1 - x2

Punkt optymalny: x* = [0, 1]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.5

CzД™Е›Д‡ programowa:

OgГіlne zaЕ‚oЕјenia

Populacja poczД…tkowa: 40 osobnikГіw

WybГіr poczД…tkowej populacji: losowy

KrzyЕјowanie: 60% (przez uЕ›rednianie)

Mutacja: 12%

Zakres zmiennych: x1 = [-2, 2]

x2 = [-2, 2]

PorГіwnanie rodzajГіw selekcji

Selekcja: miД™kka

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 89 generacjach)

Punkt optymalny: x* = [0.039, 0.945]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.499

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

0,133 |

0,922 |

-0,489 |

10 |

-1,36В·10-3 |

1,030 |

-0,499 |

20 |

-1,36В·10-3 |

1,030 |

-0,499 |

30 |

-1,36В·10-3 |

1,030 |

-0,499 |

40 |

-1,36В·10-3 |

1,030 |

-0,499 |

50 |

-1,36В·10-3 |

1,030 |

-0,499 |

60 |

1,29В·10-4 |

0,984 |

-0,5 |

70 |

1,29В·10-4 |

0,984 |

-0,5 |

80 |

7,62В·10-3 |

1,002 |

-0,5 |

>80 |

7,62В·10-3 |

1,002 |

-0,5 |

Punkt optymalny: x* = [7,62В·10-3, 1,002]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.5

Selekcja: twarda

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 93 generacjach)

Punkt optymalny: x* = [-2.22В·10-9, 1]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.5

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

0,112 |

0,603 |

-0,453 |

10 |

-0,010 |

1,008 |

-0,499 |

20 |

-9,44В·10-5 |

1 |

-0,5 |

30 |

-1,11В·10-6 |

1 |

-0,5 |

40 |

9,40В·10-9 |

1 |

-0,5 |

50 |

-3,44В·10-9 |

1 |

-0,5 |

>50 |

-3,44В·10-9 |

1 |

-0,5 |

Punkt optymalny: x* = [-3,44В·10-9, 1]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.5

Selekcja: turniejowa

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 134 generacjach)

Punkt optymalny: x* = [-2.22В·10-9, 1]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.5

Kryterium stopu: liczba generacji

generacja |

x1 |

x2 |

optimum |

1 |

8,40В·10-2 |

0,857 |

-0,495 |

10 |

2,11В·10-2 |

0,982 |

-0,499 |

20 |

2,49В·10-3 |

0,998 |

-0,5 |

30 |

4,35В·10-4 |

1 |

-0,5 |

40 |

4,36В·10-4 |

1 |

-0,5 |

>40 |

4,36В·10-4 |

1 |

-0,5 |

Punkt optymalny: x* = [4,36В·10-4, 1]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.5

Wizualizacja rozwiД…zania:

CzД™Е›Д‡ analityczna:

f(x) = x12 + x1x2 + 0.5x22 - x1 - x2

II.2 Funkcje nie wypukЕ‚e

1. f(x) = x14 + x24 - 0.62x12 - 0.62x22 // funkcja z czterema minimami lokalnymi

Punkty optymalne: 1) x* = [- 0.55672, - 0.55672]

2) x* = [- 0.55672, 0.55672]

3) x* = [ 0.55672, - 0.55672]

4) x* = [ 0.55672, 0.55672]

WartoЕ›Д‡ optymalna funkcji: f(x*) = - 0.19219 (dla wszystkich punktГіw)

CzД™Е›Д‡ programowa:

OgГіlne zaЕ‚oЕјenia

Populacja poczД…tkowa: 40 osobnikГіw

WybГіr poczД…tkowej populacji: losowy

KrzyЕјowanie: 60% (przez uЕ›rednianie)

Mutacja: 12%

Selekcja: turniejowa: twarda

Zakres zmiennych: x1 = [-1, 1]

x2 = [-1, 1]

Wizualizacja rozwiД…zania:

Poszukiwanie pierwszego punktu

Zakres zmiennych: x1 = [-1, 0]

x2 = [-1, 0]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 66 generacjach)

Punkt optymalny: x* = [-0.55678, -0.55677]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.1922

Wizualizacja rozwiД…zania:

Poszukiwanie drugiego punktu

Zakres zmiennych: x1 = [-1, 0]

x2 = [0, 1]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 89 generacjach)

Punkt optymalny: x* = [-0.55678, 0.55678]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.1922

Wizualizacja rozwiД…zania:

Poszukiwanie trzeciego punktu

Zakres zmiennych: x1 = [0, 1]

x2 = [-1, 0]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 94 generacjach)

Punkt optymalny: x* = [0.55678, -0.55678]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.1922

Wizualizacja rozwiД…zania:

Poszukiwanie czwartego punktu

Zakres zmiennych: x1 = [0, 1]

x2 = [0, 1]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 117 generacjach)

Punkt optymalny: x* = [0.55678, 0.55678]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -0.1922

Wizualizacja rozwiД…zania:

CzД™Е›Д‡ analityczna:

f(x) = x14 + x24 - 0.62x12 - 0.62x22

2. f(x) = x14 + x24 - 2x12x2 - 4x12 + 3 // funkcja Engwall'a

Punkt optymalny: x* = [1.3090, 0.9498]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -1.74109

CzД™Е›Д‡ programowa:

OgГіlne zaЕ‚oЕјenia

Populacja poczД…tkowa: 40 osobnikГіw

WybГіr poczД…tkowej populacji: losowy

KrzyЕјowanie: 60% (przez uЕ›rednianie)

Mutacja: 12%

Selekcja: twarda

Zakres zmiennych: x1 = [0, 2]

x2 = [0, 2]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 129 generacjach)

Punkt optymalny: x* = [1.30735, 0.94897]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -1.74107

Wizualizacja rozwiД…zania:

CzД™Е›Д‡ analityczna:

f(x) = x14 + x24 - 2x12x2 - 4x12 + 3

3. f(x) = (x12 + x2 - 11)2 + (x1 + x22 - 7)2 - 200 // funkcja Himmelblau'a

Punkty optymalne: cztery - brak danych

WartoЕ›Д‡ optymalna funkcji: f(x*) = - 200 (dla wszystkich punktГіw)

CzД™Е›Д‡ programowa:

OgГіlne zaЕ‚oЕјenia

Populacja poczД…tkowa: 40 osobnikГіw

WybГіr poczД…tkowej populacji: losowy

KrzyЕјowanie: 60% (przez uЕ›rednianie)

Mutacja: 12%

Selekcja: twarda

Zakres zmiennych: x1 = [-5, 5]

x2 = [-5, 5]

Wizualizacja rozwiД…zania:

Poszukiwanie pierwszego punktu

Zakres zmiennych: x1 = [-5, 0]

x2 = [-5, 0]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 85 generacjach)

Punkt optymalny: x* = [-3.7792, -3.2832]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -200

Wizualizacja rozwiД…zania:

Poszukiwanie drugiego punktu

Zakres zmiennych: x1 = [-5, 0]

x2 = [0, 5]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 88 generacjach)

Punkt optymalny: x* = [-2.8051, 3.1313]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -200

Wizualizacja rozwiД…zania:

Poszukiwanie trzeciego punktu

Zakres zmiennych: x1 = [0, 5]

x2 = [-5, 0]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 91 generacjach)

Punkt optymalny: x* = [3.5844, -1.8481]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -200

Wizualizacja rozwiД…zania:

Poszukiwanie czwartego punktu

Zakres zmiennych: x1 = [0, 5]

x2 = [0, 5]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 84 generacjach)

Punkt optymalny: x* = [3,2]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -200

Wizualizacja rozwiД…zania:

CzД™Е›Д‡ analityczna:

f(x) = (x12 + x2 - 11)2 + (x1 + x22 - 7)2 - 200

4. f(x) = x12 + x1x2 - 0.5x22 - x1 - x2

CzД™Е›Д‡ programowa:

OgГіlne zaЕ‚oЕјenia

Populacja poczД…tkowa: 40 osobnikГіw

WybГіr poczД…tkowej populacji: losowy

KrzyЕјowanie: 60% (przez uЕ›rednianie)

Mutacja: 12%

Selekcja: twarda

Pierwszy zakres

Zakres zmiennych: x1 = [-10, 10]

x2 = [-10, 10]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 91 generacjach)

Punkt optymalny: x* = [-4.5, 10]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -80,25

Wizualizacja rozwiД…zania:

Drugi zakres

Zakres zmiennych: x1 = [-100, 100]

x2 = [-100, 100]

Kryterium stopu: brak postД™pu (optymalne rozwiД…zanie uzyskano po 91 generacjach)

Punkt optymalny: x* = [-52,784, 100]

WartoЕ›Д‡ optymalna funkcji: f(x*) = -7539,466

Wizualizacja rozwiД…zania:

CzД™Е›Д‡ analityczna:

f(x) = x12 + x1x2 - 0.5x22 - x1 - x2

III. Wnioski

Efektywność i dokładność obliczeniowa algorytmu genetycznego zależy głównie od prawidłowego doboru zakresu wartości zmiennych. Nieprawidłowy dobór obszaru powoduje błędne wskazania wartości optymalnej. W przypadku zbyt dużego obszaru algorytm może idealnie nie trafić w punkt optymalny, zbyt mały obszar powoduje nie znalezienie optymalnego rozwiązania (punkt optymalny będzie znajdował się na brzegach badanego obszaru).

Kolejnym istotnym problemem jest dobór algorytmu selekcji, ponieważ od nich zależy dokładność odszukanego optimum. Po zbadaniu efektywności trzech algorytmów selekcji: miękkiego, twardego oraz turniejowego stwierdzamy, że najefektywniejszym algorytmem jest algorytm selekcji twardej. Dobrym algorytmem jest również algorytm selekcji turniejowej, ponieważ w tych selekcjach przeżywają najlepiej przystosowane osobniki (niewłaściwy dobór parametrów selekcji w przypadku selekcji turniejowej może do wpadnięcia w minimum lokalne i nie znalezienia minimum globalnego). Z kolei w selekcji miękkiej w dużej populacji słabsze osobniki mogą przeżywać i rozmnażać się, lecz przeżywają lub rozmnażają się z mniejszym prawdopodobieństwem niż osobniki lepiej przystosowane, dlatego ten algorytm selekcji nie jest tak efektywny jak powyższe.

Ważnym parametrem jest rozmiar populacji. W zadaniach opracowywanych w tym ćwiczeniu optymalna liczba osobników w populacji powinna mieścić się w granicach 30 - 50. Na szybkość i efektywność algorytmu genetycznego poza algorytmem selekcji ma wpływ jakość osobników w początkowej populacji. A więc dobre losowanie (w przypadku zastosowania takiej metody wyboru początkowej populacji) ma bardzo duży wpływ na osiągnięcie optymalnego rozwiązania.

Decydujący wpływ na końcowe rozwiązanie ma kryterium stopu, czyli warunek decydujący o zatrzymaniu pracy algorytmu. Zdecydowanie najlepszym wyborem (naszym zdaniem) jest kryterium na brak postępu, ponieważ w miarę szybko znajduje optymalne rozwiązanie. W przypadku wyboru kryterium na liczbę generacji musimy orientować się jak dobrać tą liczbę. Zbyt mała liczba spowoduje, że algorytm nie dojdzie do rozwiązania optymalnego, natomiast zbyt duża liczba znacznie wydłuży czas wyszukiwania optimum.

Laboratorium |

Technika optymalizacji |

Autorzy:

Kier.: EiT Spec.: ESA |

WrocЕ‚aw, dnia 6.11.2006

ProwadzД…cy: Dr inЕј.. Ewa Szlachcic |

Д†wiczenie IV Zadanie programowania nieliniowego bez ograniczeЕ„ |

Algorytmy optymalizacji lokalnej i algorytmy optymalizacji globalnej

|

2

MoЕјe przydaЕ‚by siД™ ambitniejszy wstep?

Dla jednej funkcji (najlepiej jakiejś prostej np. 1, 2, 3) policzyć analityczne wartości optymalną i punkty, w których ono się znajduje.

Jak to zrobić?

Policzyć pierwsze pochodne cząstkowe po funkcji. Przyrównać je do zera - mamy punkty, w których znajduje się optimum.

2. Policzyć drugie pochodne cząstkowe. Robimy z nich macierz i obliczamy hesjan.

Wyszukiwarka

Podobne podstrony:

Funkcje nieliniowe?z ograniczeЕ„

nieliniowe z ograniczeniami

Optymalizacja Cw 4 Programowanie nieliniowe z ograniczeniami

Zadanie programowania nieliniowego?z ograniczeЕ„ Optymalizacja lab3

Optymalizacja Cw 3 Zadanie programowania nieliniowego bez ograniczeЕ„ algorytmy optymalizacji lokaln

Optymalizacja nieliniowa bez ograniczeЕ„ sprawozdanie

Metoda podzialu i ograniczen

W 3 RCDS,RNC,SRCD ograniczenia RCDS,REJESTRACJA

MOO wyklad 2 ekstrema bez ograniczen

Ograniczenia wytrzymaЕ‚oЕ›ciowe pД™tli skonstruowanych z taЕ›m

82 Nw 07 Ogranicznik pradu

ogranicznik drzwi reanimacja

NAI Regresja Nieliniowa

Oddziaływanie ograniczników przepięć na inne urządzenia w instalacji elektrycznej w obiekcie bu

Jak ograniczyć zużycie tarcicy

Stacjonarny laptop, BHP - darmowy transfer bez ograniczeЕ„ !!!!, BHP, ergonomia, ERGONOMIA(1)

wiД™cej podobnych podstron